3.2 Fine Tuning

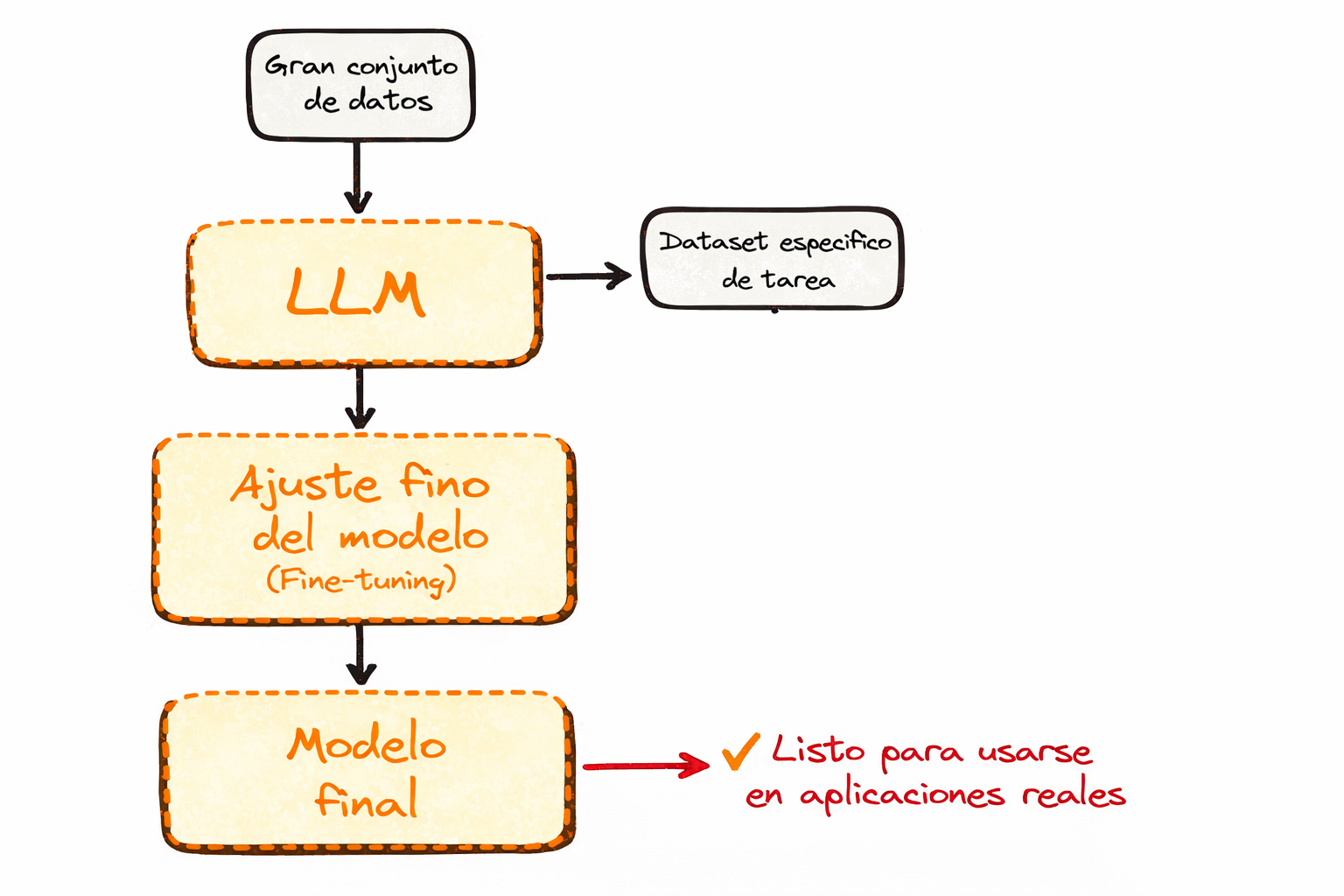

El Fine Tuning Es una técnica que permite adaptar un modelo de inteligencia artificial ya entrenado a una tarea concreta. En lugar de entrenar un modelo desde cero, se parte de un modelo grande que ya ha aprendido conocimientos generales y se le entrena un poco más con datos específicos para que se especialice en un tema determinado.

La idea es parecida a lo que ocurre en educación: un estudiante primero aprende conocimientos generales y después se especializa en una asignatura concreta. Los modelos de IA funcionan de forma similar. Primero se entrenan con grandes cantidades de información general (textos, imágenes, etc.) y después pueden refinarse con ejemplos específicos para mejorar su rendimiento en una tarea particular.

Esto permite aprovechar todo el conocimiento que el modelo ya tiene, y solo ajustar algunos aspectos para que funcione mejor en un contexto concreto. Además, requiere muchos menos datos y recursos que entrenar un modelo desde cero.

Por ejemplo, un modelo general puede adaptarse para:

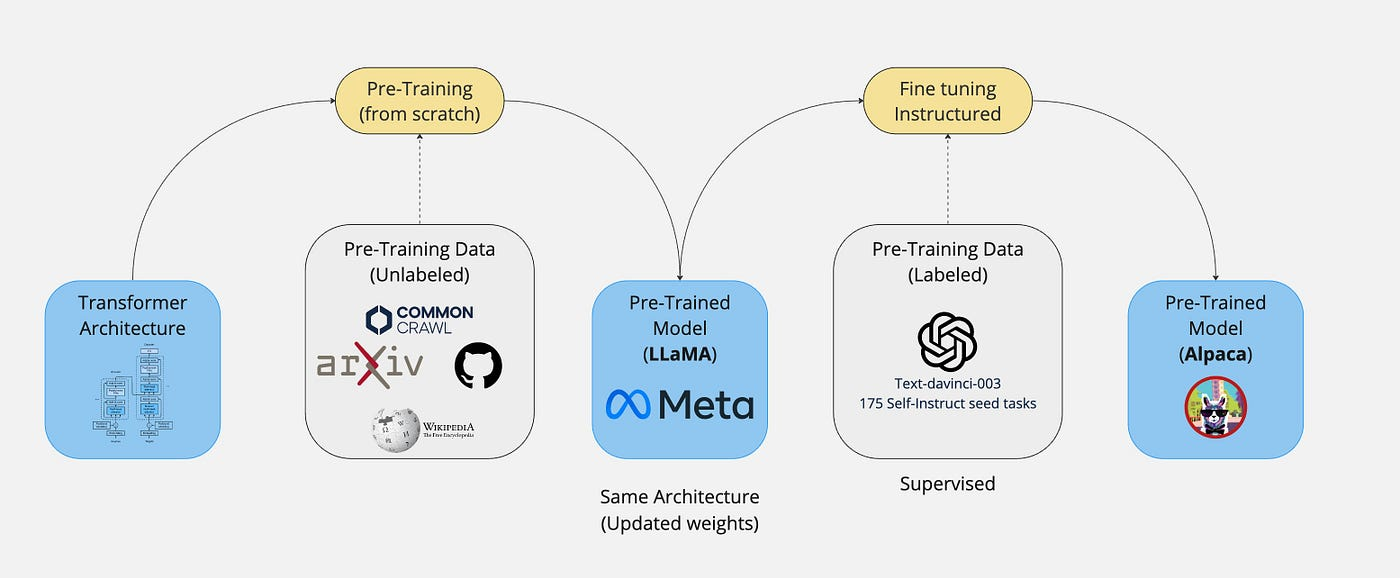

Proceso general de Fine Tuning, usando datos y modelos preentrenados obtenemos un nuevo modelos capaza de responder a nuevas preguntas

Ejemplo sencillo: entrenar un modelo para resolver problemas de álgebra

Imaginemos que queremos crear un pequeño asistente que ayude a los estudiantes a resolver problemas de álgebra de secundaria. El proceso sería algo así:

El dataset de entrenamiento podría tener una estructura muy simple como esta:

Ejemplo 1

Problema:

Resuelve la ecuación 2x + 3 = 11

Solución:

Restamos 3 a ambos lados:

2x = 8

Dividimos entre 2:

x = 4

Ejemplo 2

Problema:

Resuelve 3x − 5 = 10

Solución:

Sumamos 5 a ambos lados:

3x = 15

Dividimos entre 3:

x = 5

Ejemplo 3

Problema:

Resuelve 4x + 2 = 18

Solución:

Restamos 2:

4x = 16

Dividimos entre 4:

x = 4

Después de entrenarse con muchos ejemplos similares, el modelo empieza a reconocer el patrón de resolución de ecuaciones lineales. Esto hace que, cuando un estudiante le pregunte algo como:

“Resuelve 5x + 7 = 22”

el modelo sea capaz de responder siguiendo el mismo procedimiento paso a paso.

Este tipo de entrenamiento se utiliza realmente en investigación para mejorar la capacidad matemática de los modelos. Por ejemplo, existen datasets específicos de problemas matemáticos que se utilizan para ajustar modelos de lenguaje y mejorar su razonamiento matemático.

Ventajas del fine-tuning en educación

En el ámbito educativo, el fine-tuning permite crear modelos especializados que:

De esta forma, los modelos de IA pueden pasar de ser herramientas generales a convertirse en asistentes educativos especializados en una materia concreta.

Herramientas para realizar fine-tuning

Antes de aplicar el fine-tuning,fine-tuning, es necesario utilizar herramientas que permitan entrenar o ajustar los modelos con nuevos datos. Existen varias plataformas y bibliotecas que facilitan este proceso y que hoy en día se utilizan ampliamente en investigación, educación y desarrollo de aplicaciones de IA.

| Icono | Herramienta | Descripción | Nivel | Utilidad en educación |

|---|---|---|---|---|

| 🤗 | Hugging Face (Transformers) | Biblioteca |

Medio | Ideal para

|

| ⚙️ | PEFT | Permite

|

Medio | Adaptar modelos en |

| 🔧 | LoRA / QLoRA | Técnicas eficientes que añaden pequeñas capas entrenables sin modificar todo el modelo. |

Medio | Fine-tuning de

|

| 🧪 | Google Colab + notebooks | Entorno accesible para ejecutar código de |

Básico | Facilitar prácticas guiadas de fine-tuning para alumnado |

| 🧠 | Ollama + datasets propios | Permite trabajar con modelos |

Básico-Medio | Experimentar con IA local y privacidad en el aula |

| 🔵 | Google AI Studio / Vertex AI | Plataformas de Google para ajustar modelos mediante interfaces más visuales o semi-guiadas. | Básico | Introducir fine-tuning sin necesidad de |

| 📊 | OpenAI

|

Permiten ajustar modelos |

Básico-Medio |

Crear asistentes especializados sin gestionar infraestructura

|

Principales herramientas y entornos para adaptarhacer modelosfine grandes como LLaMA o Mistral porque permiten hacerlo con menos memoria y menor coste computacional.tuning

Ventajas del fine-tuning en educación

El fine-tuning permite adaptarofrece un modelogran de inteligencia artificial para que funcione mejorpotencial en unel contextoámbito concreto.educativo, Eny educación,resulta estoespecialmente significarelevante queen ciencias y matemáticas, donde la precisión, el modeloprocedimiento puedey ajustarseel auso una asignatura, a un tipo de ejercicios o al estilo pedagógicocorrecto del profesorado.

Entreson lasfundamentales. Sus principales ventajas principalesy destacanposibilidades las siguientes.son:

- Adaptación al

estilométododeldeprofesorresolución en matemáticas y física

El modelo puede aprenderlaaformaresolver problemas exactamente como se hace en clase.

Ejemplo: resolver ecuaciones deexplicarsegundo grado siguiendo siempre losconceptos,mismoselpasostono(identificar coeficientes, fórmula, sustitución y resultado), o problemas delascinemática indicando datos, fórmula, sustitución y unidades. - Consistencia en explicaciones científicas

Mantiene siempre la misma estructura en definiciones y desarrollos.

Ejemplo: explicar la fotosíntesis o laestructuraley delosOhmejerciciossiguiendoquesiempreutilizaunelesquemadocente.claro(definición → fórmula → ejemplo → aplicación).

ConsistenciaUso correcto del lenguaje técnico

En ciencias es clave no simplificar enlasexcesorespuestasni cometer errores conceptuales.UnaEjemplo:vezdiferenciarentrenadocorrectamenteconentreejemplosmasasimilares,yel modelo suele responder siguiendo un formato parecido. Esto permite que las explicacionespeso, osolucionesentremantengan una estructura claracalor yhomogénea.temperatura,utilizando unidades y definiciones precisas.

- Especialización en

unacontenidosdisciplinaconcretos

El modelo puedecomprender mejor la terminología y los conceptos de una materia concreta como física, matemáticas o biología.Automatización de contenidos educativosUn modelo ajustado a una asignatura puede generar ejercicios, ejemplos, explicaciones o actividades coherentesentrenarse con el temario real del curso.

Ejemplo:

trabajarLimitacionesúnicamente con los tipos de problemas de química (disoluciones, estequiometría) que se ven en clase, evitando enfoques distintos. - Resolución paso a paso (clave en ciencias)

No solo da el resultado, sino que muestra el proceso completo.

Ejemplo: en un problema de densidad, indicar datos → fórmula → sustitución → resultado con unidades, como se exige en examen. - Adaptación al nivel del

fine-tuningalumnado

Ajusta la complejidad según curso.

Ejemplo: explicar un átomo como “un sistema solar” en 1º ESO, o introducir orbitales y niveles energéticos en Bachillerato. - Generación automática de ejercicios coherentes

Permite crear múltiples problemas similares al estilo del profesor.

Ejemplo: generar 10 ejercicios de MRU con la misma estructura que los del examen, variando solo los datos. - Corrección y feedback alineado con criterios científicos

Puede corregir errores siguiendo los mismos criterios que el docente.

Ejemplo: indicar no solo que un resultado está mal, sino que falta unidad, planteamiento o despeje correcto. - Creación de tutores virtuales de ciencias y matemáticas

Asistentes que guían al alumnado en el razonamiento.

Ejemplo: un tutor que no da directamente la solución, sino que va guiando: “¿qué fórmula usarías aquí?” o “¿qué dato te falta?”. - Refuerzo del aprendizaje autónomo con rigor

El alumnado puede practicar sin perder coherencia con el aula.

Ejemplo: un estudiante repasa problemas de física en casa y recibe explicaciones exactamente iguales a las del profesor.

A pesar de sus ventajas, el fine-tuning también presenta algunasuna limitaciones.serie de limitaciones que conviene tener en cuenta, especialmente en el ámbito educativo y más aún en materias científicas, donde el rigor es fundamental.

- Requiere

prepararpreparación de datos

Paraentrenar correctamenteque el modelo funcione bien, es necesario recopilar ejemplosadecuadosde calidad y organizarlosencorrectamente.

Ejemplo: si se quiere entrenar unconjuntomodelo para resolver problemas deentrenamiento.física,hay que preparar muchos ejercicios bien resueltos, con pasos claros y sin errores, lo que implica tiempo y planificación docente.

- Necesita recursos computacionales

El entrenamiento demodelosmodelos,requiereinclusocapacidadcondetécnicascálculo,eficientes,normalmentesueleGPUs,requerirloGPUsqueo entornos como Google Colab.

Ejemplo: un centro educativo puedelimitarencontraralgunoslimitacionesproyectossieducativos.quierehacer fine-tuning con modelos grandes sin acceso a infraestructura adecuada.

NoMenoresflexibilidadtan flexible comoque RAGSiUnaaparecevezinformación nueva,entrenado, el modelo no puedeconsultarlaacceder a información nueva automáticamente.

Ejemplo:Parasiincorporarse actualiza el temario o se añaden nuevoscontenidos suele ser necesario volver a entrenarlo.Puede introducir sesgosSi los datostipos deentrenamientoejerciciosnodeestán bien seleccionados,química, el modelopuedeno los conocerá a menos que se vuelva a entrenar.- Riesgo de reproducir errores o sesgos

Elpresentesmodelo aprende exactamente de los datos que se le proporcionan.

Ejemplo: si los ejercicios de entrenamiento tienen errores de unidades o planteamiento, el modelo los repetirá de forma sistemática. - Rigidez en

esoseldatos.enfoque

Al

perderPorestarestamuyrazón,ajustadomuchasaaplicacionesunactualesestilocombinanconcreto,distintaspuedetécnicas:- capacidad

- de

adaptación.prompting

Ejemplo: un modelo entrenado con un único método para resolver ecuaciones puede tener dificultades para entender o generar soluciones alternativas. - Mayor

sistemascomplejidad técnica

A diferencia del prompting o el uso de RAG en - plataformas

sencillas, el fine-tuning

requiere ciertos conocimientos técnicos.

Ejemplo: preparar datasets, ajustar parámetros o evaluar modelos puede ser complejo para profesorado sin experiencia previa en IA.

Cada una aporta una función diferente dentro del sistema.Conclusión

El fine-tuning es una técnica fundamental para adaptar modelos de lenguaje a dominios específicos. En el ámbito educativo permite crear modelos especializados capaces de trabajar con contenidos científicos concretos y generar materiales didácticos coherentes con el estilo del profesorado.En asignaturas como biología, física, matemáticas o química, el fine-tuning puede utilizarse para entrenar modelos que expliquen conceptos con mayor claridad, generen ejercicios estructurados o ayuden a preparar materiales educativos.

Combinado con otras técnicas como el prompting avanzado y los sistemas RAG, el fine-tuning abre la puerta a una nueva generación de asistentes educativos inteligentes capaces de apoyar tanto al profesorado como al alumnado en el aprendizaje de las ciencias.

Esquema básico de fine tuning

Un símil para entenderlo todo

Para comprender mejor cómo funcionan los modelos de lenguaje (LLM) y las distintas formas de trabajar con ellos —prompting, RAG y fine-tuning— puede ser útil utilizar un símil cercano al mundo educativo: el desarrollo del cerebro humano y el proceso de aprendizaje a lo largo de la vida.

Podemos imaginar un modelo de lenguaje como un cerebro que ha pasado por una primera etapa de aprendizaje muy amplia. Durante ese proceso, el modelo se entrena con enormes cantidades de textos: libros, artículos, páginas web, conversaciones, documentación técnica, etc. Ese entrenamiento inicial sería comparable a los primeros años de vida de una persona, en los que adquirimos el lenguaje, la capacidad de interpretar el mundo y una base general de conocimiento. No aprendemos todo en detalle, pero sí desarrollamos una estructura mental que nos permite comprender, razonar y generar ideas.

A partir de esa base aparece el prompting, que podríamos comparar con el papel que juega la cultura, el contexto y la forma en que se nos plantea una tarea. Una misma persona puede responder de forma muy distinta según cómo se le formule una pregunta, qué información previa tenga o qué contexto se le proporcione. Lo mismo ocurre con los modelos de lenguaje: el modo en que se redacta una instrucción influye directamente en la calidad y el tipo de respuesta que generan. Desde una perspectiva educativa, aprender a formular buenos prompts se parece mucho a aprender a hacer buenas preguntas, algo que siempre ha sido una habilidad fundamental en el aula.

El siguiente concepto, RAG (Retrieval Augmented Generation), puede entenderse como cuando una persona consulta fuentes externas antes de responder. Un profesor, por ejemplo, no siempre responde únicamente con lo que recuerda; muchas veces consulta un libro, un artículo o una base de datos para asegurar que la información es correcta o está actualizada. El RAG funciona de forma parecida: el modelo accede a documentos o bases de conocimiento externas y utiliza esa información para generar respuestas más precisas y contextualizadas. En el ámbito educativo, esto permite trabajar con documentación propia del centro, apuntes, artículos científicos o materiales didácticos.

Finalmente, encontramos el fine-tuning, que podríamos comparar con la especialización o formación en nuevas materias a lo largo de la vida. Una persona que ya tiene una base educativa puede especializarse después en medicina, derecho o ingeniería. No empieza desde cero; simplemente adapta y refuerza su conocimiento para un ámbito concreto. Del mismo modo, el fine-tuning consiste en ajustar un modelo ya entrenado para una tarea específica, utilizando datos más especializados.

Desde la perspectiva del profesorado, este símil ayuda a entender algo importante: los modelos de IA no son simplemente herramientas automáticas que generan respuestas, sino sistemas que combinan aprendizaje previo, contexto, acceso a información y especialización. Comprender estas diferencias permite utilizarlos con mayor criterio en el aula.

Al final, la cuestión no es si la inteligencia artificial “piensa”, sino cómo podemos integrarla de forma inteligente en los procesos de aprendizaje. Igual que ocurre con cualquier otra herramienta educativa, su valor depende de cómo se utilice. Cuando se entiende su funcionamiento y sus límites, los modelos de lenguaje pueden convertirse en instrumentos para explorar ideas, plantear preguntas, analizar información y fomentar el pensamiento crítico.

Y quizá esa sea la clave desde el punto de vista pedagógico: no utilizar la IA para que piense por el alumnado, sino para ayudarles a pensar mejor.

- de