4.3 Ajustando Modelos, Fine-Tuning

El fine-tuning (ajuste fino) es una técnica que consiste en adaptar un modelo de lenguaje previamente entrenado a una tarea o dominio específico mediante un entrenamiento adicional con datos especializados.

Los modelos de lenguaje modernos han sido entrenados con enormes cantidades de datos generales procedentes de internet, libros, artículos y otras fuentes. Sin embargo, ese conocimiento general no siempre es suficiente cuando se necesita trabajar con contenidos muy específicos, como por ejemplo el temario de una asignatura concreta, el estilo de materiales de un profesor o el lenguaje técnico de una disciplina científica.

El fine-tuning permite que el modelo aprenda patrones específicos de un dominio determinado. En el ámbito educativo, esto significa que un modelo puede entrenarse para trabajar mejor con contenidos de biología, física, matemáticas o química, adaptándose al nivel de los estudiantes y al estilo pedagógico del docente.

Diferencia entre preentrenamiento y fine-tuning

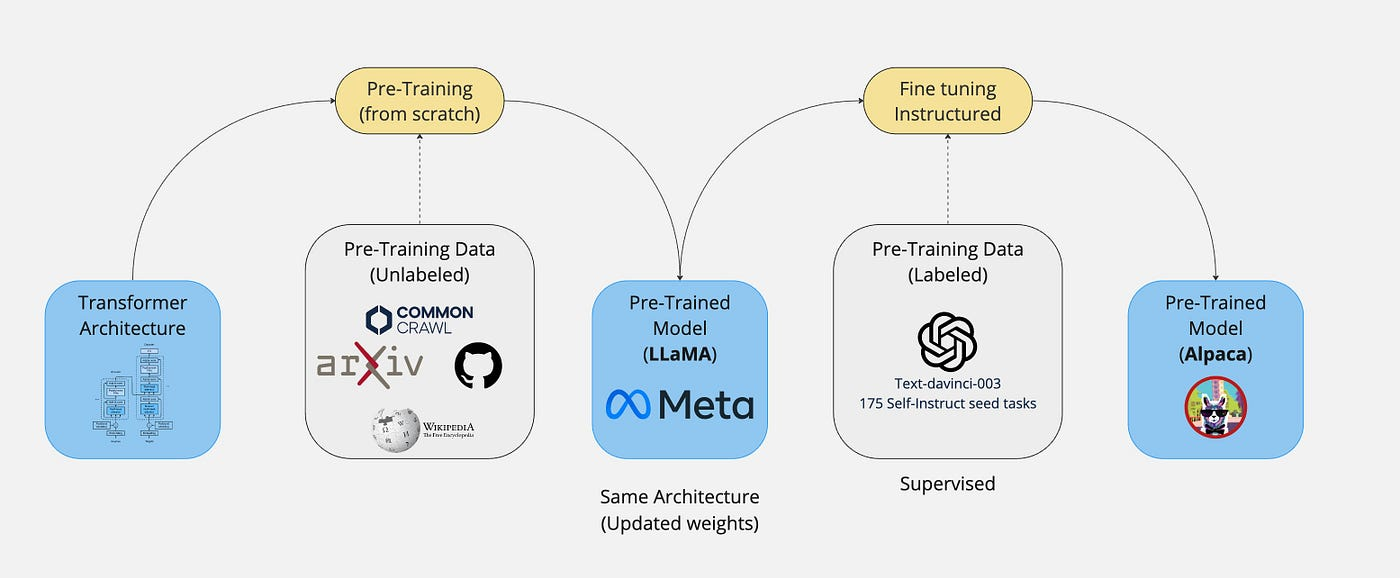

Para entender el fine-tuning es útil distinguir dos fases en el desarrollo de un modelo de lenguaje.

Preentrenamiento

En esta fase el modelo aprende patrones generales del lenguaje utilizando grandes volúmenes de datos. Aprende gramática, vocabulario, estructuras sintácticas y conocimientos generales.

Por ejemplo, un modelo preentrenado ya puede:

-

explicar qué es la gravedad

-

resolver ecuaciones simples

-

describir la fotosíntesis

-

resumir textos científicos

Pero este conocimiento es generalista.

Fine-tuning

El fine-tuning consiste en continuar el entrenamiento del modelo utilizando datos más específicos.

Por ejemplo:

-

ejercicios de matemáticas de un curso concreto

-

apuntes de biología de bachillerato

-

guías de laboratorio de química

-

problemas resueltos de física

De esta forma el modelo aprende:

-

terminología específica

-

estilo de explicación del profesor

-

tipo de ejercicios utilizados en clase

-

estructura habitual de las actividades

El resultado es un modelo más especializado.

Cuándo usar fine-tuning

El fine-tuning resulta útil cuando se necesita que un modelo:

-

adopte un estilo específico de respuesta

-

trabaje con un dominio técnico concreto

-

genere contenidos con estructura muy consistente

-

aprenda patrones que no se consiguen solo con prompting

Por ejemplo, si un profesor siempre diseña actividades con esta estructura:

-

explicación conceptual

-

ejemplo resuelto

-

ejercicio para el alumnado

-

reflexión final

el modelo puede aprender esa estructura mediante fine-tuning.

Diferencia entre RAG y fine-tuning

Aunque ambos métodos sirven para adaptar modelos a un dominio, funcionan de manera diferente.

RAG

-

el modelo consulta documentos externos

-

el conocimiento está en una base de datos

-

no se modifica el modelo

Fine-tuning

-

el modelo se reentrena con nuevos datos

-

el conocimiento queda integrado en el modelo

-

cambia el comportamiento del sistema

En educación, muchas aplicaciones utilizan ambas técnicas combinadas.

Proceso de fine-tuning

El proceso suele seguir varias etapas.

1. Recopilación de datos

Se recopilan ejemplos de entrenamiento.

Por ejemplo:

-

preguntas y respuestas de exámenes

-

ejercicios resueltos

-

explicaciones del profesor

-

materiales didácticos

2. Formato de entrenamiento

Los datos suelen organizarse como pares prompt-respuesta.

Ejemplo en física:

Prompt:

Explica la segunda ley de Newton con un ejemplo sencillo.

Respuesta:

La segunda ley de Newton establece que la fuerza aplicada a un objeto es igual al producto de su masa por su aceleración. Por ejemplo…

3. Entrenamiento adicional

El modelo se entrena con estos ejemplos para que aprenda ese patrón.

4. Evaluación

Después se comprueba si el modelo responde mejor en ese dominio.

Ejemplos científicos de datasets para fine-tuning

Biología

Un conjunto de entrenamiento podría incluir:

Prompt:

Explica la mitosis para estudiantes de 4º de ESO.

Respuesta:

La mitosis es el proceso mediante el cual una célula se divide en dos células hijas idénticas…

Prompt:

¿Qué función tienen las mitocondrias?

Respuesta:

Las mitocondrias son orgánulos celulares responsables de la producción de energía…

Física

Prompt:

Resuelve paso a paso el siguiente problema: un objeto de 3 kg acelera a 4 m/s².

Respuesta:

Aplicamos la segunda ley de Newton:

F = m · a

F = 3 × 4

F = 12 N

Matemáticas

Prompt:

Explica qué es una derivada usando un ejemplo gráfico sencillo.

Respuesta:

La derivada mide cómo cambia una función en un punto…

Química

Prompt:

Ajusta la reacción química:

H₂ + O₂ → H₂O

Respuesta:

Para equilibrar la reacción debemos igualar el número de átomos…

Ejemplo de modelo especializado en ejercicios

Un modelo afinado con ejercicios podría aprender este patrón.

Prompt:

Crea un problema de física sobre energía cinética.

Respuesta del modelo especializado:

-

Enunciado del problema

-

Datos del problema

-

Fórmula utilizada

-

Resolución paso a paso

-

Resultado final

Este comportamiento se aprende a partir de ejemplos.

Ejemplo de fine-tuning para simulaciones científicas

Un dataset también podría enseñar al modelo a generar simulaciones conceptuales.

Ejemplo de entrenamiento:

Prompt:

Simula qué ocurre con la presión de un gas cuando se reduce el volumen a temperatura constante.

Respuesta:

Según la ley de Boyle, la presión de un gas es inversamente proporcional al volumen…

Tras el entrenamiento, el modelo puede generar nuevas simulaciones.

Por ejemplo:

Simula qué ocurre con la energía cinética de un objeto cuando se duplica su velocidad.

Ejemplo de fine-tuning pedagógico

Un profesor podría entrenar un modelo para que genere siempre actividades con la misma estructura.

Dataset de ejemplo:

Prompt:

Diseña una actividad sobre la fotosíntesis.

Respuesta:

-

Introducción al concepto

-

Esquema del proceso

-

Pregunta de comprensión

-

Actividad de aplicación

Después del fine-tuning, el modelo reproducirá ese formato automáticamente.

Herramientas para fine-tuning

Actualmente existen varias plataformas que permiten realizar fine-tuning.

Entre las más utilizadas están:

-

HuggingFace

-

OpenAI fine-tuning

-

LoRA y QLoRA

-

Axolotl

-

PEFT

Estas herramientas permiten entrenar modelos especializados utilizando datasets relativamente pequeños.

Ejemplo conceptual de fine-tuning con datos educativos

Un proyecto educativo podría entrenar un modelo con:

-

500 ejercicios de matemáticas resueltos

-

200 explicaciones de conceptos de física

-

100 fichas de laboratorio de química

-

300 preguntas tipo test de biología

El modelo resultante podría convertirse en un asistente especializado en ciencias para estudiantes de secundaria.

Ventajas del fine-tuning en educación

Entre las principales ventajas destacan:

Adaptación al estilo del profesor

El modelo puede aprender el tono, estructura y metodología del docente.

Consistencia

Las respuestas siguen un formato homogéneo.

Especialización

El modelo trabaja mejor con conceptos de una disciplina concreta.

Automatización de contenidos

Puede generar ejercicios, explicaciones y actividades coherentes con el curso.

Limitaciones

El fine-tuning también tiene algunas limitaciones.

-

requiere preparación de datos

-

necesita recursos computacionales

-

no es tan flexible como RAG para consultar información nueva

-

puede introducir sesgos si los datos no están bien seleccionados

Por esta razón, muchas aplicaciones combinan:

-

prompting

-

RAG

-

fine-tuning

Conclusión

El fine-tuning es una técnica fundamental para adaptar modelos de lenguaje a dominios específicos. En el contexto educativo, permite crear modelos especializados capaces de trabajar con contenidos científicos concretos y generar materiales didácticos coherentes con el estilo de enseñanza del profesorado.

En asignaturas como biología, física, matemáticas y química, el fine-tuning puede utilizarse para entrenar modelos que expliquen conceptos con mayor claridad, generen ejercicios estructurados, simulen fenómenos científicos o ayuden a preparar materiales educativos.

Combinado con otras técnicas como el prompting avanzado y los sistemas RAG, el fine-tuning abre la puerta a una nueva generación de asistentes educativos inteligentes capaces de apoyar tanto al profesorado como al alumnado en el aprendizaje de las ciencias.

No comments to display

No comments to display