2.4 Medioambiente

Introducción

Las consecuencias medioambientales de la revolución inducida por la adopción masiva de la Inteligencia Artificial tienen dos vertientes.

Por un lado, la expansión de la infraestructura asociada a esta tecnología genera un coste medioambiental directo, primero en la construcción de instalaciones y en el entrenamiento (una sola vez) y, después, en los diferentes usos, el coste en inferencia.

EstosEsta huella medioambiental se concreta en términos de consumo energético, en términos de consumo de agua, en contaminación en uso de recursos naturales y en ocupación del territorio. Esto no es algo sorprendente pues es algo que sucede con todas las actividades económicas y lo que cada sociedad debe valorar es su punto de equilibrio en el balance entre todos los factores, incluyendo el desarrollo económico.

Por otra parte, el empleo de inteligencia artificial para transformar procesos productivos y logísticos puede de forma indirecta,indirecta, propiciar o favorecer un impacto ambiental positivo mediante el ahorro energético, de agua, de recursos, la mejora de los procesos de reciclaje o impulsando avances científicos y tecnológicos que aporten en estos y otros campos. Estos beneficios indirectos tienen que ser valorados en la balanza anteriormente citada.

Tenemos ante nosotros un nuevo dilema similar a los anteriormente presentados, esta vez en este campo. Por un lado, se presenta como una herramienta sin precedentes para la optimización de recursos y la mitigación del cambio climático. Por otro, su infraestructura subyacente impone una presión masiva sobre los sistemas energéticos e hídricos globales.

Análisis energético de la computación avanzada

La inteligencia artificial, especialmente cuando hablamos de aprendizaje profundo y de modelos generativos, posee un perfil energético que se diferencia cualitativamente de la informática tradicional.

Mientras que en las tareas de oficina o la navegación web convencional se basan en procesos deterministas con baja densidad de cómputo, la IA depende de la manipulación de miles de millones de parámetros en arquitecturas de redes neuronales que generan un calor residual masivo y requieren un alimentación energética constante y una permanente necesidad de refrigeración.

Del entrenamiento a la inferencia

Entrenar un gran modelo de lenguaje (LLM) requiere una cantidad grande de energía, sin embargo, es un consumo que se hace una sola vez. Por ejemplo, el entrenamiento de GPT-4 requirió aproximadamente 50 Gigavatios-hora (MWh). España consume anualmente en torno a 250 000 GWh, 5000 veces más, por lo que este entrenamiento, que recordemos que sólo se produce una vez para cada modelo, no parece un coste muy grande en comparación con nuestra capacidad de generación.

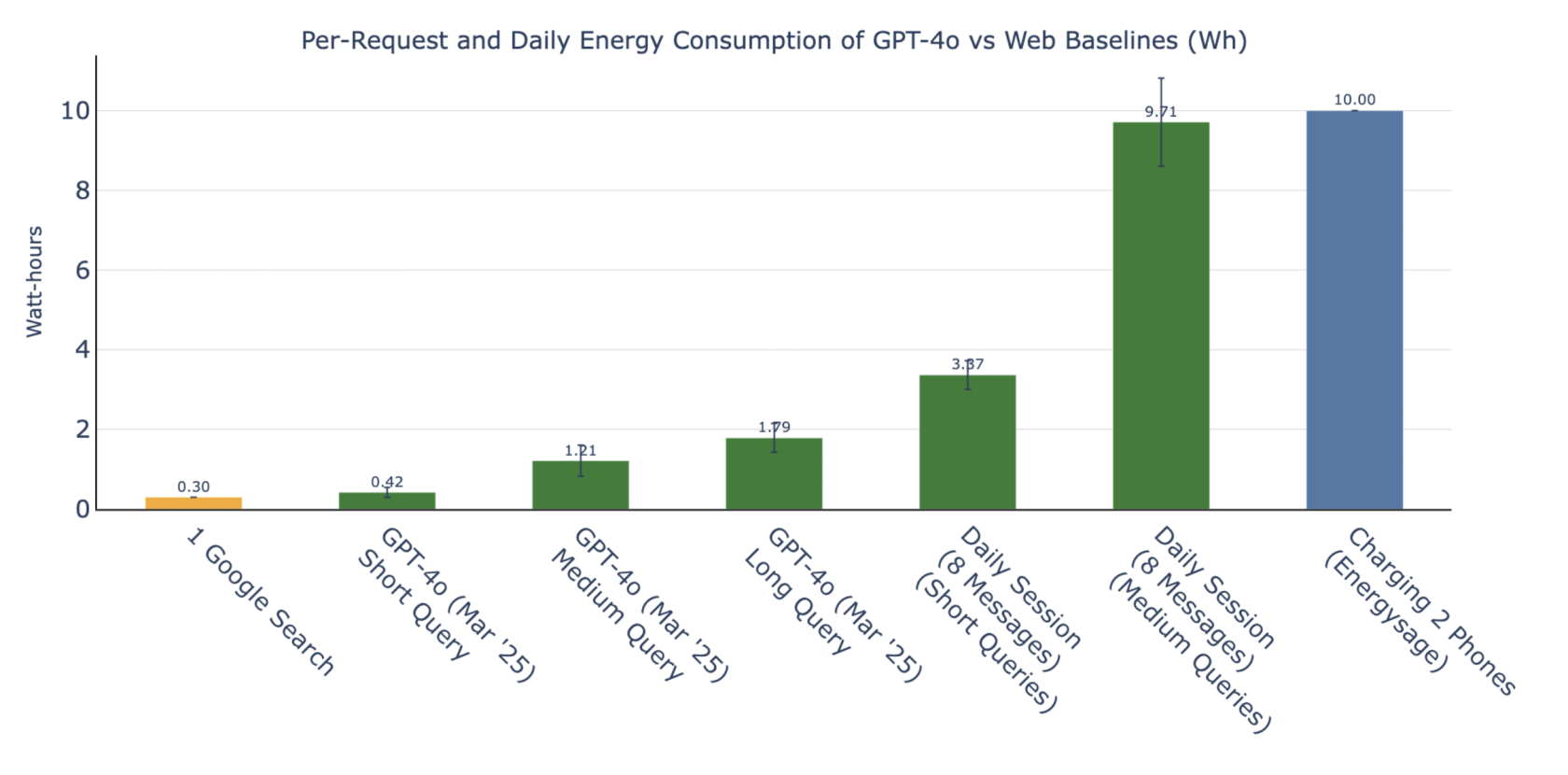

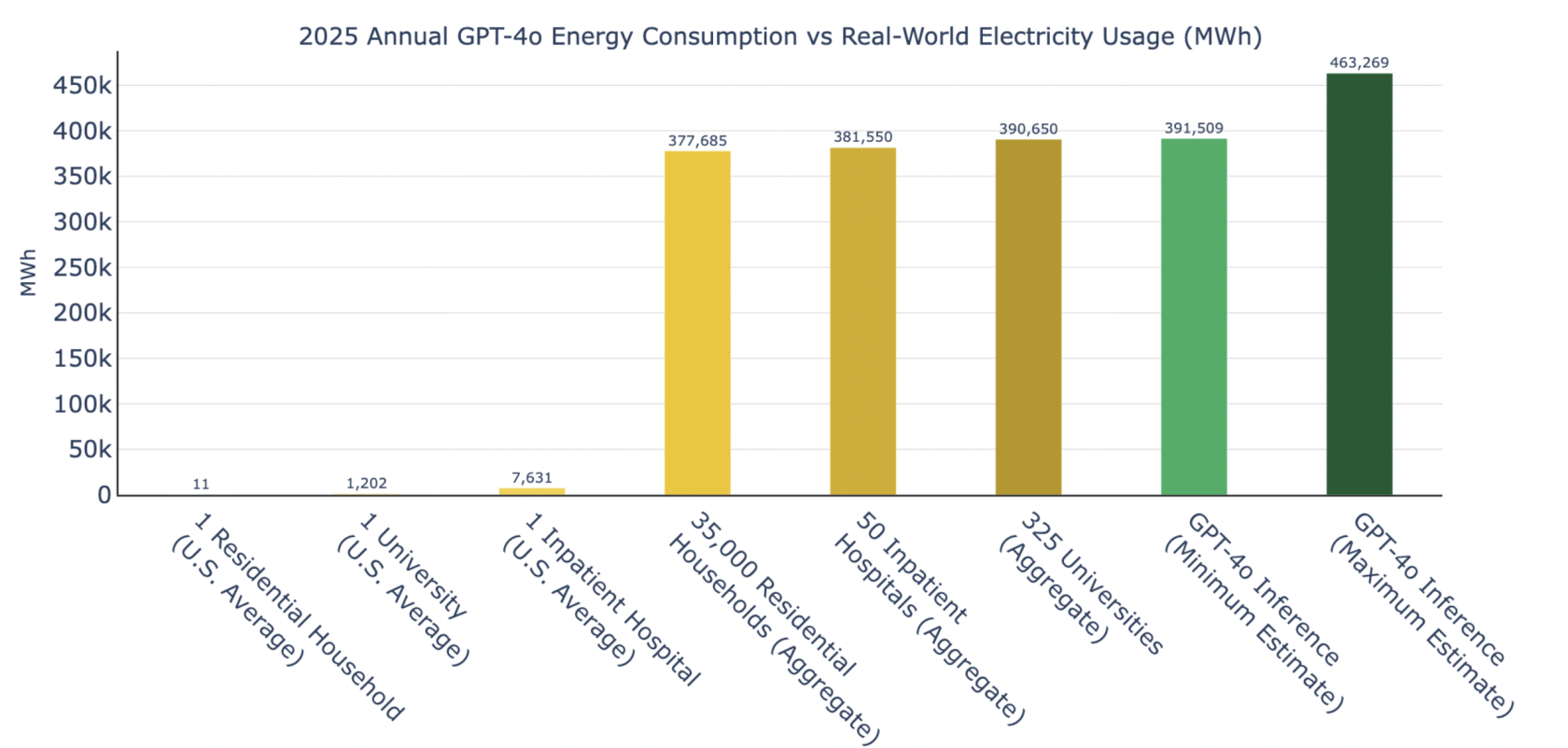

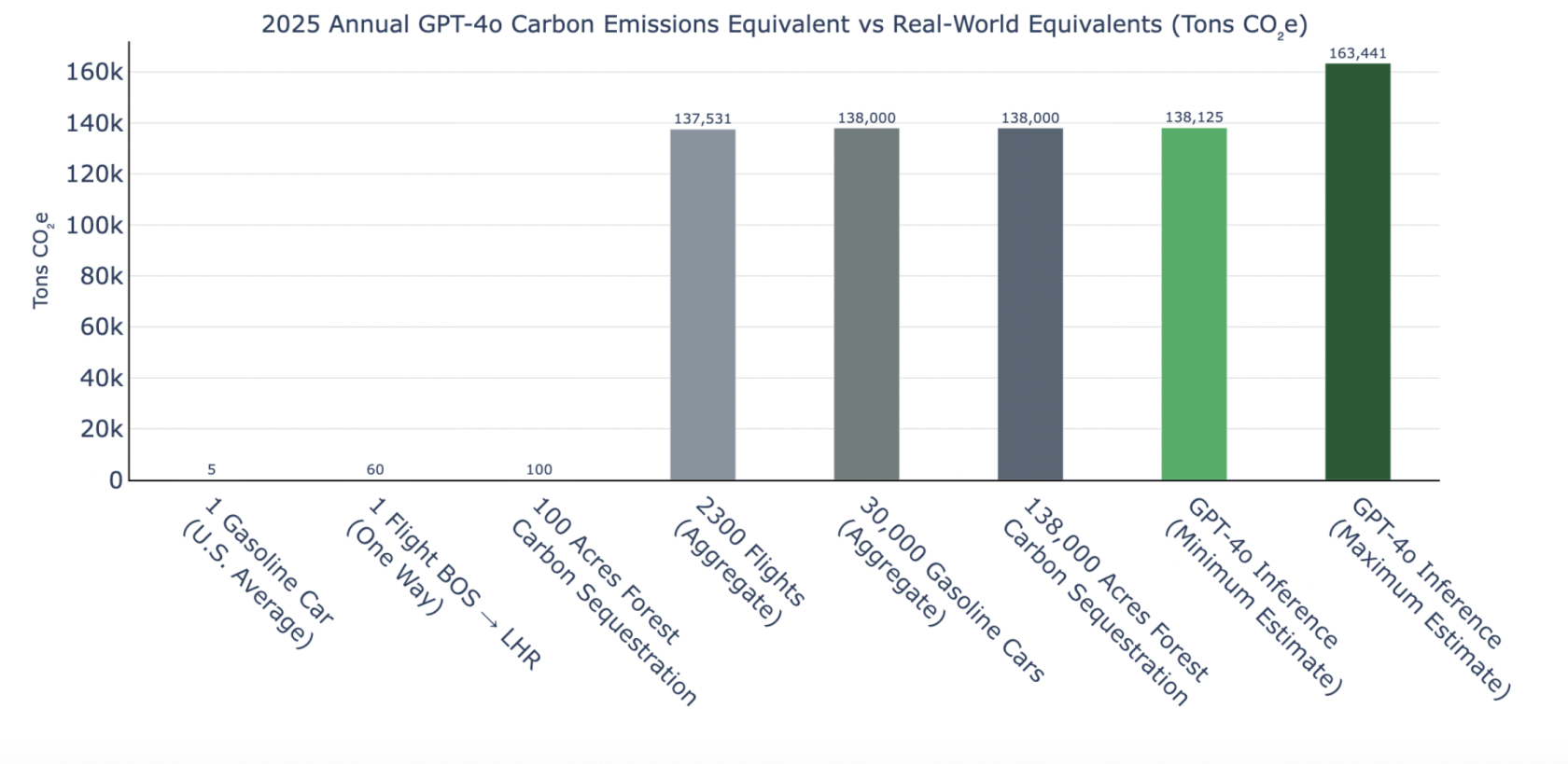

Una mayor huella energética está asociada al uso diario en inferencia, veamos en algunas tablas, procedentes de este estudio, algunos valores cotidianos comparados con los de GPT-4

Como vemos, el consumo global de todo GPT4 equivale a 35 000 viviendas en USA y su huella de carbono es la de 30 000 coches de gasolina.

Impacto en la infraestructura de red y precios locales de energía

La demanda de energía de los centros de datos está creciendo a un ritmo que supera la capacidad de expansión de las infraestructuras de transmisión. En Estados Unidos, las empresas de servicios públicos recibieron solicitudes de interconexión por más de 700 gigavatios (GW) en 2025, superando el consumo total del país en 2023. Cabe destacar que el tiempo necesario para ampliar estas infraestructuras es muy alto, pues incluye los tiempos administrativos de permisos de conexión, los análisis de impacto y un largo etc. Estos tiempos no permiten la adaptación con agilidad de las redes de distribución a la demanda de los centros de datos por lo que, si bien hemos visto que globalmente no parece un problema ahora el coste total, si puede ser un problema local la distribución de esta energía eléctrica.

El giro hacia la energía nuclear

Ante la necesidad de energía libre de carbono operativa las 24 horas (baseload) y generada en el mismo lugar que el consumo para evitar el cuello de botella de la distribución, las Big Tech han realizado apuestas multimillonarias por la energía nuclear :

-

Microsoft: Acordó pagar $16.000 millones para reactivar el reactor de Three Mile Island en Pensilvania, proyectado para 2028.

-

Amazon: Invirtió $20.000 millones para convertir el sitio de Susquehanna en un campus de datos alimentado por energía nuclear.

-

Google: Firmó el primer acuerdo corporativo para una flota de reactores modulares pequeños (SMR) con Kairos Power, apuntando a 500 MW para 2030-2035.

Esta tendencia, presente en USA y no en España, indica el nacimiento de una una incipente "soberanía energética privada" donde las empresas tecnológicas no solo consumen energía, sino que se convierten en actores fundamentales de la infraestructura energética nacional, influyendo en la política climática y en la viabilidad de las metas de descarbonización.

El consumo de agua: Refrigeración e impacto hídrico

El consumo de agua por parte de la IA es una de las consecuencias menos visibles pero más geográficamente sensibles. Los centros de datos de IA albergan racks de GPU que operan con densidades de potencia de 50 a 135 kW, muy por encima de los 10-20 kW de los servidores tradicionales. Disipar este calor requiere sistemas de gestión térmica que, en su mayoría, dependen de la evaporación de agua dulce. Es decir, el agua se consume para refrigerar estas "granjas de servidores". El consumo de agua de estos sistemas de refrigeración puede dividirse entre 3 con el empleo de sistemas de circuito cerrado con un coste un poco mayor, lo que mitiga mucho el impacto ambiental y social.

Efectividad y consumo directo

La industria utiliza el indicador de Efectividad del Uso del Agua (WUE), expresado en litros consumidos por kilovatio-hora de energía de cómputo. El promedio de la industria se sitúa entre 1,8 y 1,9 L/kWh. Para poner estas cifras en perspectiva, el entrenamiento de GPT-3 en los centros de datos de Microsoft evaporó directamente unos 700.000 litros de agua potable, cantidad suficiente para la fabricación de 370 coches BMW o 320 vehículos Tesla.

La inferencia es más costosa por sumar millones de interacciones en entre el sistema y el usuario. Una conversación típica de 20 a 50 preguntas con un sistema como ChatGPT-3 consumía aproximadamente medio litro de agua dulce. Si se considera que OpenAI cuenta con aproximadamente 400 millones de usuarios semanales, el impacto hídrico agregado en 2023 fue este.

|

Empresa |

Consumo Hídrico Total (2023) |

Crecimiento Anual |

|---|---|---|

|

|

24.227 millones de litros |

+17% |

|

Microsoft |

7.844 millones de litros |

+34% |

|

Proyección Global IA (2027) |

4,2 - 6,6 billones de litros |

N/A |

Para hacer una comparación, ese consumo mundial de Google de 2,4 × 1010 litros de agua, equivale a menos de un 0,1% del consumo anual de agua en España Localización y estrés hídrico. Sin embargo, las previsiones de crecimiento sede esta demanda pueden presionar los sistemas hídricos y económicos

El impacto no es uniforme, como no lo es la distribución de estos consumos, sino localizado en lugares concretos. En Arizona, las instalaciones de Microsoft operan con un WUE de 1,52 L/kWh debido al clima árido, mientras que en Singapur se reduce a 0,02 L/kWh. La proliferación de centros de datos en comunidades que ya sufren estrés hídrico genera conflictos de uso con la agricultura y el consumo residencial. Por ejemplo, en The Dalles, Oregón, los centros de datos de Google consumen más de una cuarta parte de toda el agua utilizada por la ciudad.

La transición hacia sistemas de refrigeración de circuito cerrado (closed-loop) representa una vía de mitigación, permitiendo ahorros de hasta un 70% del consumo de agua.

-------------

. Redes de abastecimiento de energía como factor limitante a la expansión de los data centers. Expansión de la demanda y presión de los precios locales de un bien de interés público como la energía eléctrica.

Gasto de agua: Diferenciar en entrenamiento y en inferencia. Coste en agua en inferencia por uso de LLM, por uso de generacion de imagenes y de video. Circuitos cerrados

Mejoras de la eficiencia en usos de agua y energia debido a procesos controlados por Inteligencia artificial.

Contaminación: El aumento de la eficiencia de procesos agrícolas e industriales como factor beneficioso ecológicamente. Contaminación asociada a la electrificación, a la generación eléctrica. Uso de energía nuclear como abastecimiento a los centros de datos y de procesamiento.

Distribución. Disminución de los bienes no utilizados por mejoras en la cadena de distribución por uso de IA

Reciclaje. Mejora en los procesos de recilcaje debido al uso de IA