4.1 Reglamento Europeo IA

Introducción

El pilar central de la normativa europea es el Reglamento (UE) 2024/1689, conocido como la Ley de Inteligencia Artificial (AI Act). Este documento, publicado en el Diario Oficial de la Unión Europea el 12 de julio de 2024, representa la primera ley integral sobre IA en el mundo y establece las reglas de juego para cualquier sistema que se comercialice o utilice en territorio comunitario.

Tiene por objeto fomentar el desarrollo y la adopción de sistemas de IA seguros y fiables en todo el mercado único de la Unión Europea, tanto en el sector privado como en el público, garantizando al mismo tiempo la salud y la seguridad de los ciudadanos de la UE y el respeto de los derechos fundamentales.

Aunque ya ha ido apareciendo a lo largo de los capítulos de este curso, es necesario hacer zoom out y conocer al menos algunas cuestiones clave sobre el mismo.

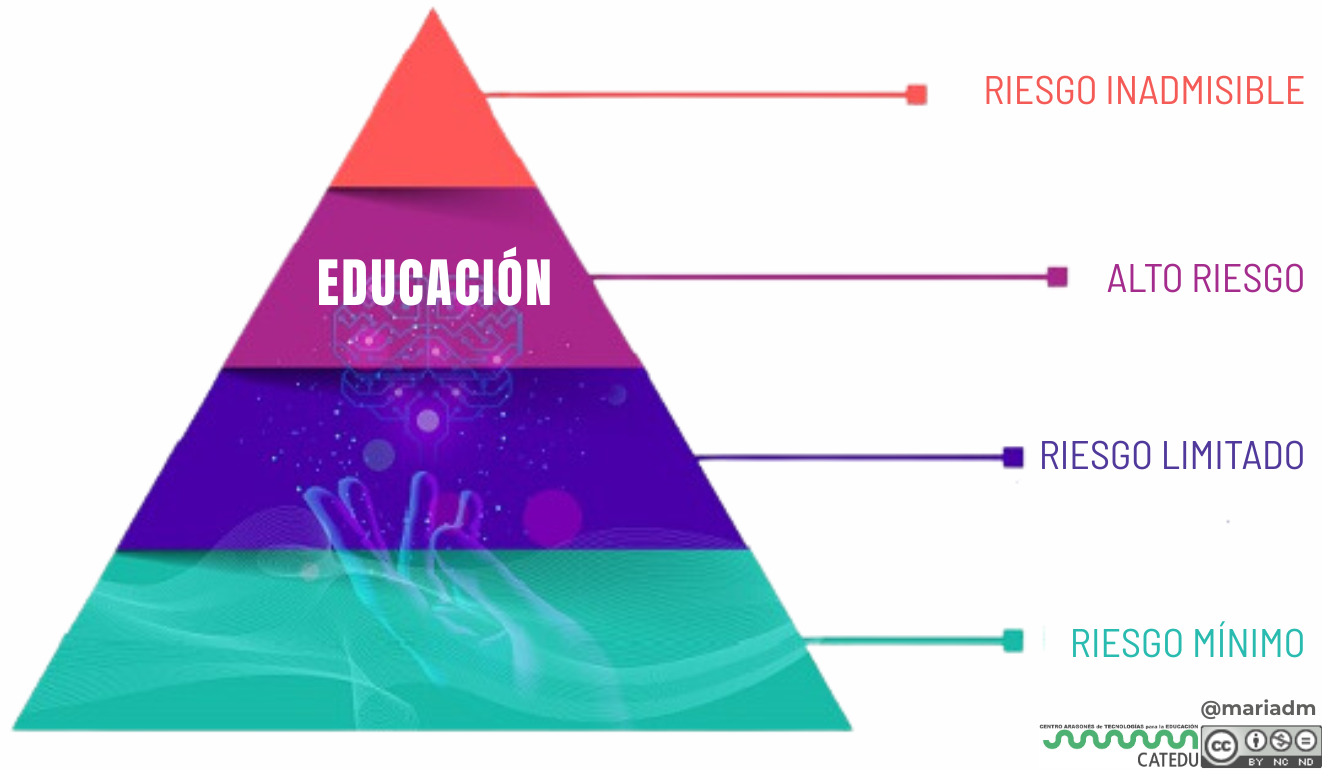

Niveles de Riesgo

En este Reglamento se establece una clasificación de los sistemas de IA en función del riesgo que suponen para la sociedad. Para la formación docente, es imperativo desglosar cómo este reglamento clasifica los sistemas de IA, ya que la educación ha sido designada como un ámbito de "alto riesgo" en algunos de sus puntos. Cuanto mayor sea el riesgo de causar daños a la sociedad, más estrictas serán las normas, culminando con la prohibición en aquellos casos que hayan sido clasificados como riesgo inadmisible o inaceptable.

Pirámide AI Act - Niveles de riesgo

Prácticas prohibidas - Riesgo inadmisible

Todos los sistemas de IA considerados una clara amenaza para la seguridad, los medios de subsistencia y los derechos de las personas son clasificados como Riesgo inadmisible y están prohibidos. El Reglamento prohíbe las siguientes prácticas de IA con un nivel de riesgo inaceptable:

- Técnicas subliminales o engañosas para manipular el comportamiento de individuos o grupos, mermando su capacidad para tomar decisiones con conocimiento de causa y causando un daño potencial.

- Explotación de vulnerabilidades basadas en la edad, la discapacidad o las situaciones socioeconómicas para manipular a individuos o grupos, con el consiguiente perjuicio potencial.

- Puntuación social, evaluando o clasificando a las personas en función de su comportamiento o características, lo que da lugar a un trato injusto no relacionado con el contexto en el que se recogieron los datos o de manera desproporcionada a la gravedad del comportamiento.

- Evaluación del riesgo criminal, predicción de la probabilidad de cometer un delito basándose únicamente en perfiles o rasgos de personalidad, excepto en investigaciones criminales objetivas y basadas en hechos.

- Obtención de bases de datos de reconocimiento facial a partir de Internet o de cámaras de seguridad sin un objetivo específico.

- Inferencia de emociones en áreas sensibles, como lugares de trabajo o instituciones educativas, a menos que se utilice con fines médicos o de seguridad.

- Categorización biométrica basada en datos para inferir atributos sensibles como raza, religión u opiniones políticas, excepto para su uso legal en el cumplimiento de la ley.

- Identificación biométrica en tiempo real en público por parte de las fuerzas de seguridad, a menos que sea estrictamente necesario para situaciones concretas (por ejemplo, encontrar a personas desaparecidas, prevenir amenazas inminentes o identificar a sospechosos de delitos graves). Esto debe seguir procedimientos legales estrictos, incluida la autorización previa, un alcance limitado y salvaguardias para proteger los derechos y libertades.

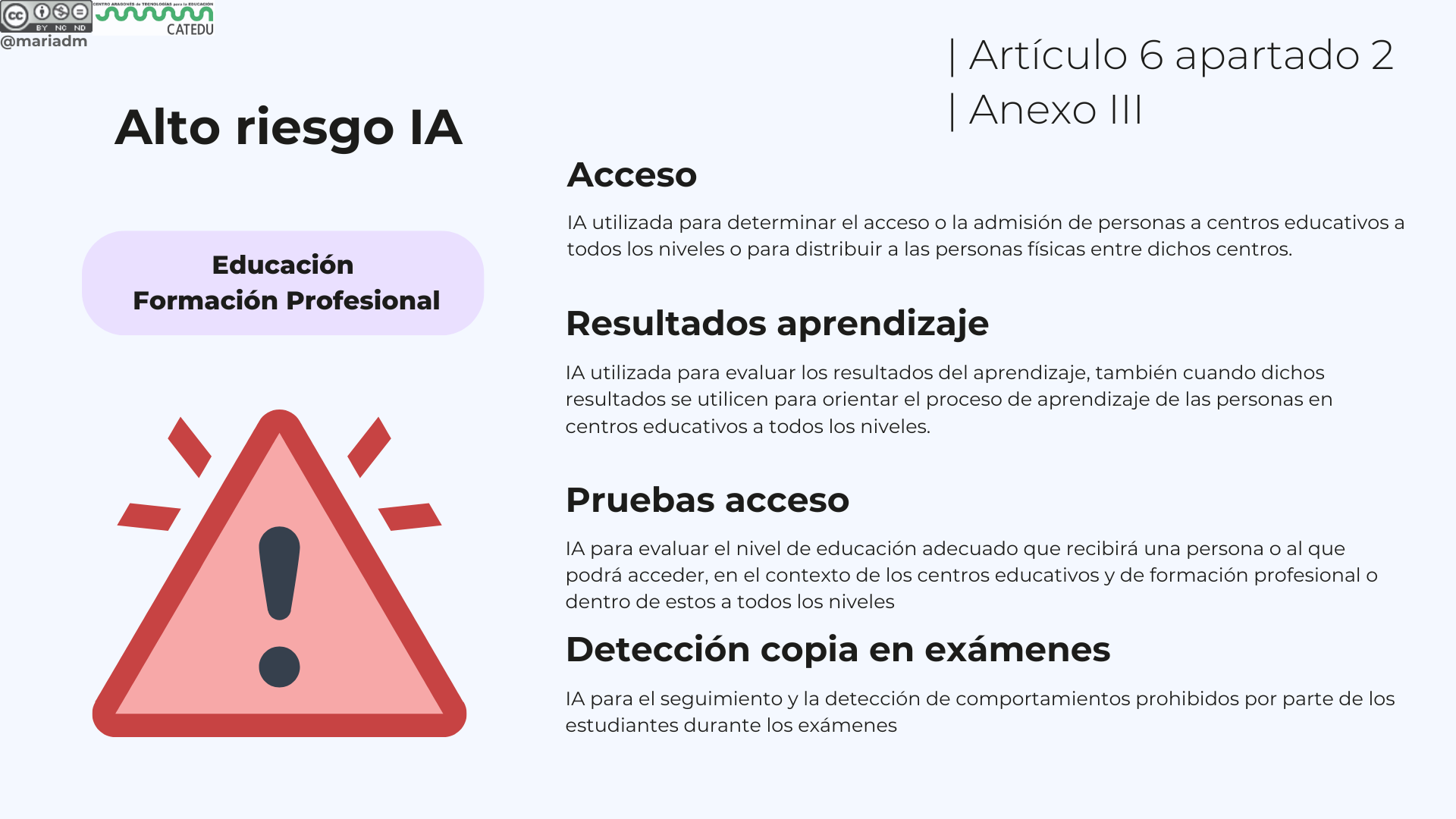

Educación - Alto riesgo

La designación de la educación como sector de alto riesgo se debe a que las decisiones tomadas por una IA en este ámbito pueden determinar el curso de la vida académica, profesional y personal de una persona. No obstante, no todos los usos de la IA en educación se clasifican como de alto riesgo, ya que esta categoría se aplica principalmente a aquellos sistemas que intervienen en decisiones relevantes como la admisión o la evaluación del alumnado.

Son considerados de alto riesgo los sistemas de IA utilizados para determinar el acceso o admisión a centros, evaluar resultados del aprendizaje, valorar el nivel educativo adecuado o supervisar comportamientos prohibidos durante los exámenes.

Estos sistemas de IA deben cumplir con los requisitos estipulados en los artículos 8 al 17 de la ley, es decir, están sujetos a obligaciones estrictas antes de que puedan comercializarse:

- Sistemas adecuados de evaluación y mitigación de riesgos

- Alta calidad de los conjuntos de datos que alimentan el sistema para minimizar los riesgos de resultados discriminatorios

- Registro de la actividad para garantizar la trazabilidad de los resultados

- Documentación detallada que proporcione toda la información necesaria sobre el sistema y su finalidad para que las autoridades evalúen su cumplimiento

- Información clara y adecuada al implementador

- Medidas adecuadas de supervisión humana

- Alto nivel de robustez, ciberseguridad y precisión

Casos alto riesgo en Educación y FP

En cuanto a la protección de los derechos fundamentales y el uso de sistemas de IA de alto riesgo, la Ley IA dice que:

Antes de que un sistema de IA de alto riesgo sea desplegado por entidades que prestan servicios públicos, debe evaluarse su impacto sobre los derechos fundamentales.fundamentales (art.27). Los sistemas de IA de alto riesgo y las entidades que los utilicen deben registrarse en una base de datos de la UE (agosto 2027).

Además de los proveedores y distribuidores de sistemas de IA y de las entidades, los centros educativos y docentes podemos ser identificados como responsables del despliegue bajo el Reglamento Europeo de IA, por lo que también adquirimos responsabilidades si utilizamos sistemas de IA en los casos mencionados anteriormente, clasificados como de alto riesgo.

Algunas de las principales responsabilidades a la hora de desplegar estos sistemas son:

- Uso conforme a las instrucciones: adoptar medidas técnicas y organizativas adecuadas para garantizar que utilizan los sistemas siguiendo las instrucciones de uso facilitadas por el proveedor.

- Supervisión humana: obligación de encomendar la supervisión de estos sistemas a personas físicas que posean la competencia, formación y autoridad necesarias para vigilar su funcionamiento y prevenir riesgos.

- Vigilancia y reporte: vigilar el funcionamiento del sistema y, en caso de considerar que presenta un riesgo o detectar un incidente grave, deben informar inmediatamente al proveedor o distribuidor y a la autoridad de vigilancia del mercado, suspendiendo el uso del sistema si es necesario.

- Calidad de los datos de entrada: asegurarse de que los datos que introducen en el sistema sean pertinentes y suficientemente representativos, en la medida en que tengan control sobre ellos.

- Conservación de registros: obligación de conservar los archivos de registro (logs) generados automáticamente por el sistema durante al menos seis meses, para permitir la trazabilidad del funcionamiento si fuera necesario.

- Deber de información: si toman decisiones o ayudan a tomarlas basándose en estos sistemas, deben informar a las personas físicas, de que están siendo objeto del uso de una IA de alto riesgo.

- Evaluación de impacto: En el caso de centros que sean organismos de Derecho público o entidades privadas que presten servicios públicos, deben realizar una evaluación de impacto relativa a los derechos fundamentales antes de poner el sistema en funcionamiento.

Además, el reglamento subraya la importancia de la alfabetización en materia de IA, instando a que los responsables del despliegue garanticen que su personal tenga un nivel de conocimientos suficiente para operar estos sistemas de forma informada y segura.

Riesgo limitado y mínimo

Se considera que todos los demás sistemas de IA presentan un riesgo limitado, por lo que el Reglamento no introduce más normas.

Evaluación y revisión

La Comisión evalúa cada año la necesidad de modificar la lista de usos de alto riesgo de la IA y la lista de prácticas prohibidas. Antes del , y cada cuatro años a partir de entonces, la Comisión evaluará e informará sobre lo siguiente:

- la adición o ampliación de la lista de categorías de alto riesgo.

- las modificaciones de la lista de sistemas de IA que requieren medidas de transparencia adicional.

- las modificaciones para mejorar la supervisión y la gobernanza.

Entrada en vigor

La Ley Europea de Inteligencia Artificial (AI Act) tiene una entrada en vigor gradual. Las fechas clave son:

-

1 de agosto de 2024: la ley entra formalmente en vigor tras su publicación en el Diario Oficial de la UE.

-

2 de febrero de 2025: empiezan a aplicarse las prohibiciones de ciertos usos de IA y las obligaciones de alfabetización en IA.

-

2 de agosto de 2025: entran en aplicación las normas para modelos de IA de propósito general (GPAI) y parte del sistema de gobernanza.

-

2 de agosto de 2026: la mayor parte de las obligaciones del AI Act empieza a aplicarse y comienza su aplicación general en los Estados miembros.

-

2 de agosto de 2027: se aplican los requisitos para algunos sistemas de IA de alto riesgo integrados en productos regulados (por ejemplo, ciertos dispositivos o maquinaria).

TIMELINE

A modo recordatorio, destacamos otros puntos de este Reglamento que hemos mencionado en capítulos y páginas anteriores:

- Prohibición del reconocimiento de emociones en el trabajo y en las escuelas.

- Respetar la legislación de la UE sobre derechos de autor.

- Imágenes, audio o vídeo artificiales o manipuladas con IA, como los deepfakes, deberán etiquetarse como tales.

En la Plataforma única de información sobre la ley de IA dispones de herramientas para consultar y navegar fácilmente por la ley además de realizar consultas. Para acceder pincha aquí.

Aquí puedes consultar también un resumen general de la ley.

Sin embargo, en el ámbito de la protección de datos, la ley ha de complementarse con el Reglamento General de Protección de Datos del que hablaremos a continuación.