1.5 Modelos de Lenguaje, tipos y aplicaciones

1.5 Entender y trabajar con el lenguaje

Procesamiento del Lenguaje Natural (NLP): del conteo de palabras a los modelos de lenguaje

El lenguaje como dato: un reto central de la IA

El lenguaje humano es, probablemente, el tipo de información más complejo con el que trabajamos en educación. No solo transmite información, sino también intención, matices, emociones, ironía y contexto cultural. Durante mucho tiempo, esta complejidad hizo que el lenguaje fuera un terreno especialmente difícil para la Inteligencia Artificial.

El Procesamiento del Lenguaje Natural (NLP) surge precisamente para abordar este reto: permitir que las máquinas analicen, clasifiquen, comparen, transformen o generen textos de forma automática. Como ya hemos visto en capítulos anteriores, la clave está en aceptar una idea fundamental:

las máquinas no entienden el lenguaje, pero pueden trabajar con él si lo transformamos adecuadamente.

Antes de “entender”, hay que contar: el lenguaje convertido en números

El primer paso en cualquier sistema de NLP es siempre el mismo: convertir el texto en números.

Una máquina no ve frases ni ideas; ve vectores numéricos. La historia del NLP es, en buena medida, la historia de cómo representar el lenguaje de forma numérica.

Durante muchos años, los enfoques más eficaces no fueron modelos complejos, sino métodos relativamente sencillos basados en una idea muy intuitiva:

las palabras que aparecen muchas veces en un texto nos dicen algo sobre ese texto.

Aquí es donde entran en juego técnicas clásicas como Bag of Words y, sobre todo, TF-IDF.

TF-IDF: una idea simple con un impacto enorme

TF-IDF (Term Frequency – Inverse Document Frequency) es uno de los conceptos más importantes del NLP clásico y sigue siendo muy útil hoy en día, incluso en sistemas modernos.

La idea es sorprendentemente sencilla:

-

TF (frecuencia del término) mide cuántas veces aparece una palabra en un texto.

-

IDF (frecuencia inversa en documentos) reduce la importancia de las palabras que aparecen en muchos textos distintos.

El resultado es que:

-

palabras muy frecuentes pero poco informativas (“el”, “de”, “y”) pesan poco,

-

palabras menos frecuentes pero más específicas pesan mucho.

En lugar de preguntarse “¿qué significa esta palabra?”, el sistema se pregunta:

“¿qué palabras distinguen este texto de los demás?”

Un ejemplo educativo muy claro

Imaginemos que tenemos redacciones de alumnado sobre distintos temas: cambio climático, redes sociales y deporte.

La palabra “clima” aparecerá muchas veces en textos sobre medioambiente, pero muy poco en los demás.

TF-IDF asignará a esa palabra un peso alto en esos textos, porque ayuda a distinguir el tema.

En cambio, palabras como “persona” o “importante” aparecerán en casi todos los textos y, aunque sean frecuentes, no ayudan a diferenciar. TF-IDF les asignará un peso bajo.

Así, cada texto se convierte en un vector numérico que representa su contenido de forma aproximada, pero útil.

Aplicaciones reales de TF-IDF en educación

Aunque hoy hablemos mucho de modelos profundos y LLMs, técnicas como TF-IDF siguen teniendo aplicaciones muy prácticas en contextos educativos.

Algunos ejemplos no triviales:

-

Detección de temas predominantes en documentos largos

Analizar qué conceptos aparecen con mayor peso en un proyecto o memoria. -

Análisis de encuestas abiertas

Extraer palabras clave y tendencias en respuestas abiertas de alumnado o familias. -

Búsqueda inteligente en repositorios educativos

Encontrar documentos relevantes no solo por coincidencia literal, sino por peso semántico aproximado. -

Primer filtrado previo a modelos más complejos

Reducir ruido y volumen de datos antes de aplicar Deep Learning.

Desde el punto de vista docente, TF-IDF tiene una ventaja clara: es interpretable.

Podemos explicar por qué una palabra pesa más que otra, algo mucho más difícil en modelos profundos.

Del conteo a la relación: el salto conceptual del NLP moderno

Las técnicas clásicas como TF-IDF no capturan relaciones profundas entre palabras. No saben que “profesor” y “docente” están relacionados, ni que “aprender” y “estudiar” se parecen en significado.

Aquí es donde el NLP moderno da el salto gracias al Deep Learning. En lugar de representar palabras solo por su frecuencia, los modelos aprenden representaciones distribuidas que capturan relaciones de contexto. Palabras que aparecen en contextos similares acaban teniendo representaciones numéricas similares.

Sin embargo —y esto es importante para el aula—, el NLP moderno no sustituye completamente a técnicas como TF-IDF. En muchos casos:

-

TF-IDF es suficiente,

-

es más rápido,

-

más transparente,

-

y más fácil de justificar pedagógicamente.

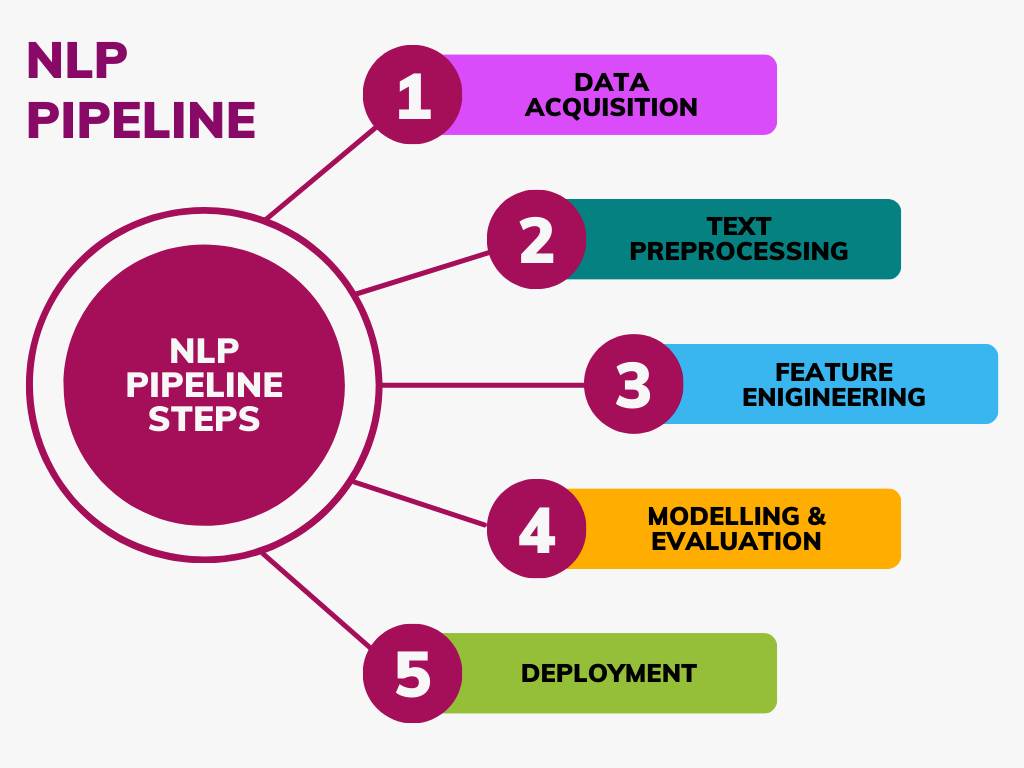

NLP clásico y NLP profundo: una convivencia necesaria

Desde una perspectiva educativa, es útil entender el NLP como una evolución, no como una ruptura.

-

Primero, contamos palabras (frecuencia).

-

Luego, ponderamos su importancia (TF-IDF).

-

Después, aprendemos relaciones entre palabras (modelos profundos).

-

Finalmente, generamos lenguaje (LLMs).

Cada nivel añade potencia, pero también complejidad y opacidad. En educación, no siempre interesa llegar al último nivel.

NLP y evaluación educativa

El NLP permite analizar grandes volúmenes de texto, algo impensable manualmente. Pero esto no significa que pueda “evaluar” como una persona. Un sistema puede detectar temas, estructuras o similitudes, pero no juzga comprensión profunda.

Por ejemplo:

TF-IDF puede detectar si un alumno usa vocabulario relevante.Un modelo profundo puede detectar coherencia global.Ninguno puede saber si el alumnoha entendidoel contenido como lo haría un docente.

Esto obliga a usar el NLP como herramienta de apoyo, no como sustituto de la evaluación pedagógica.

NLP y aprendizaje humano: un espejo imperfecto

Resulta interesante comparar el NLP con cómo aprendemos lenguaje las personas. Un niño empieza reconociendo palabras, luego relaciones simples y, con el tiempo, significados complejos. El NLP recorre un camino parecido, pero sin intención ni comprensión.

TF-IDF se parece a una fase muy temprana: reconocer qué palabras importan más.

Los modelos profundos se parecen a una fase avanzada: captar contexto y relaciones.

Pero falta algo esencial: la experiencia humana del significado.

Herramientas donde aparecen técnicas NLP clásicas y modernas (solo referencia)

En contextos educativos y formativos, el NLP —desde TF-IDF hasta modelos profundos— aparece en herramientas y entornos como:

-

scikit-learn

-

spaCy

-

NLTK

-

Hugging Face

-

Orange Data Mining

-

Weka

-

Google Colab

Muchas de estas herramientas combinan técnicas clásicas (como TF-IDF) con modelos modernos, lo que las hace especialmente útiles para la enseñanza.

Conclusión

El Procesamiento del Lenguaje Natural nos enseña una lección muy valiosa para la educación:

no todo aprendizaje complejo empieza siendo profundo.

A veces, contar bien es más útil que intentar comprenderlo todo.

TF-IDF, con su aparente simplicidad, sigue siendo una herramienta poderosa porque es comprensible, explicable y pedagógicamente honesta.

Las máquinas pueden analizar palabras; el profesorado ayuda a construir significado.