1.5 Modelos de Lenguaje, tipos y aplicaciones

1.5

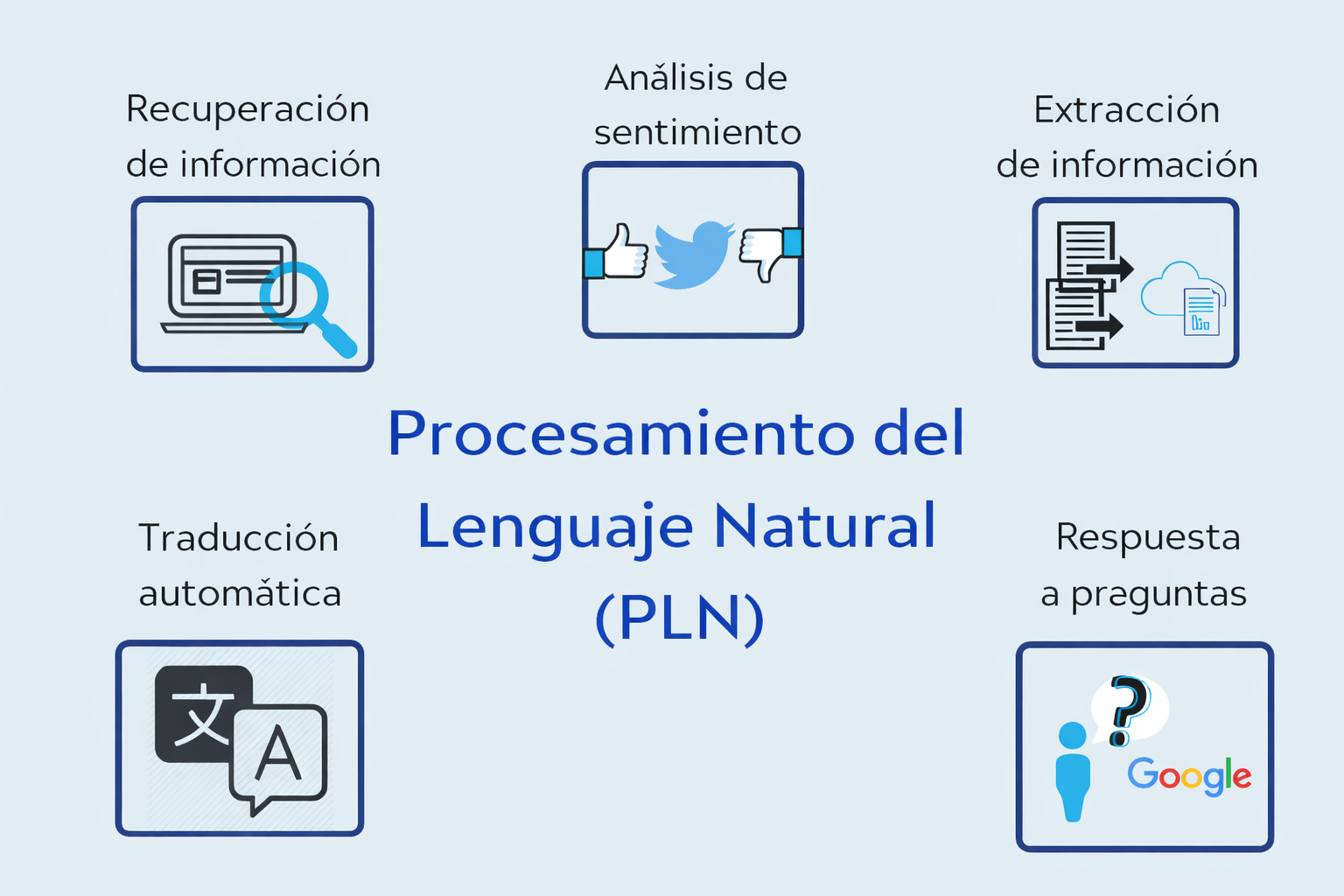

En Entenderlos yúltimos años, una de las áreas de la Inteligencia Artificial que más ha avanzado es la relacionada con el lenguaje humano. Los sistemas actuales son capaces de leer textos, resumir información, traducir entre idiomas o responder preguntas de forma bastante natural. Este conjunto de tecnologías se conoce como Procesamiento del Lenguaje Natural, o Natural Language Processing (NLP).

Para entenderlo de forma sencilla, podemos pensar en estos sistemas como lectores muy rápidos que han leído millones de textos. A partir de ese entrenamiento, aprenden cómo suelen aparecer las palabras juntas, qué estructuras tienen las frases o cómo se organizan las ideas en un texto.

Un símil útil para explicarlo es el de un estudiante que ha leído muchos libros. Con el tiempo, ese estudiante empieza a reconocer patrones: sabe cómo se construyen las frases, cómo se explican ciertos conceptos o qué palabras suelen aparecer en determinados contextos. Los modelos de lenguaje funcionan de una forma similar, aunque a una escala mucho mayor.

Por ejemplo, cuando utilizamos un sistema como ChatGPT para pedir un resumen de un texto o para generar una explicación de un concepto, el modelo no está “pensando” en el sentido humano. Lo que hace es predecir qué palabras tienen más probabilidad de aparecer a continuación en una frase, basándose en los patrones que aprendió durante su entrenamiento.

Este tipo de modelos se conocen como modelos de lenguaje porque están diseñados precisamente para trabajar con lenguaje. Su tarea básica consiste en predecir la siguiente palabra dentro de una secuencia de texto, pero a partir de esta capacidad básica se pueden construir muchas aplicaciones diferentes: traducción automática, asistentes conversacionales, análisis de textos o generación de contenido.

En el ámbito educativo, estas herramientas pueden utilizarse para explicar conceptos, generar ejemplos, resumir textos o apoyar la elaboración de materiales didácticos. Sin embargo, también es importante recordar que los modelos de lenguaje no comprenden el mundo como lo hace una persona. Su conocimiento se basa en patrones estadísticos aprendidos a partir de grandes cantidades de datos.

Por ello, una buena forma de trabajar con estas herramientas en el aula es entenderlas como un asistente que ayuda a explorar el lenguaje y la información

, pero cuyo resultado siempre debe ser revisado críticamente por el usuario. De esta manera, los modelos de lenguaje pueden convertirse en una herramienta interesante para apoyar el aprendizaje y al mismo tiempo reflexionar sobre cómo funcionan los sistemas actuales de Inteligencia Artificial.

Procesamiento del Lenguaje Natural (NLP): del conteo de palabras a los modelos de lenguaje

El lenguaje como dato: un reto central de la IA

El lenguaje humano es, probablemente, el tipo de información más complejo con el que trabajamos en educación. No solo transmite información, sino también intención, matices, emociones, ironía y contexto cultural. Durante mucho tiempo, esta complejidad hizo que el lenguaje fuera un terreno especialmente difícil para la Inteligencia Artificial.

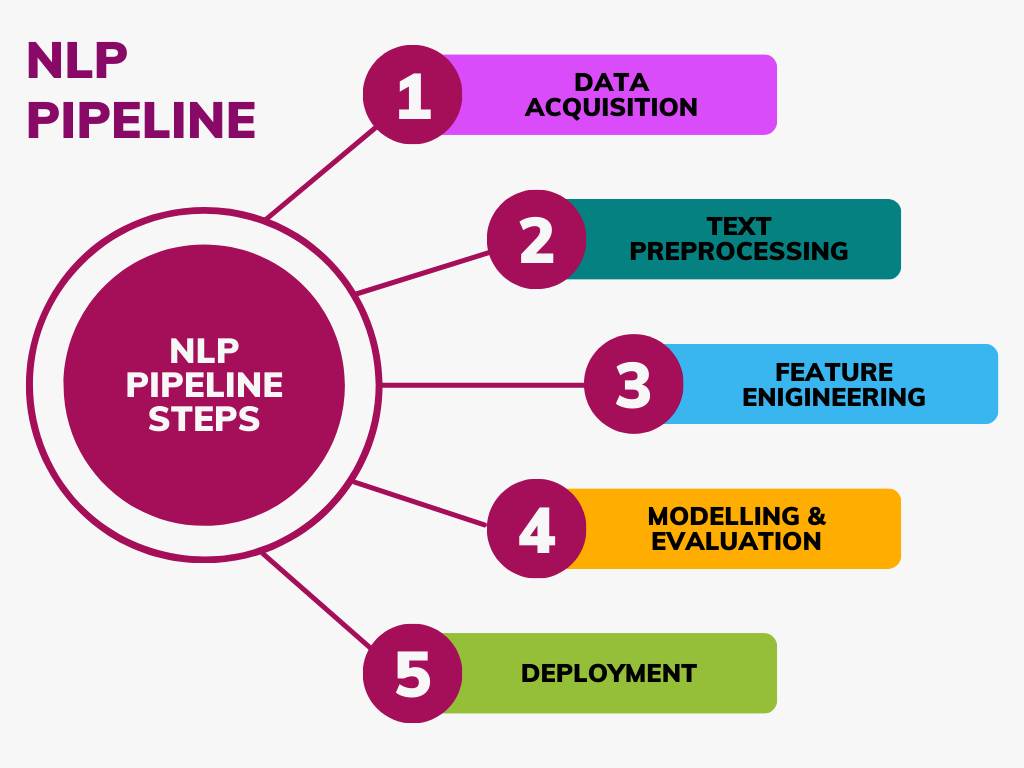

El Procesamiento del Lenguaje Natural, conocido habitualmente como NLP (NLP)Natural Language Processing), surgees precisamentela rama de la Inteligencia Artificial que se ocupa de que los ordenadores puedan analizar, comprender y trabajar con textos escritos o hablados en lenguaje humano.

Podemos imaginarlo como el conjunto de técnicas que permiten a una máquina hacer tareas que normalmente asociamos a la lectura o al análisis del lenguaje. Por ejemplo, identificar las palabras importantes de un texto, clasificar documentos, detectar el tema principal de un artículo o responder preguntas.

Un símil útil para abordarentenderlo esteen reto:el permitiraula es el de un profesor que lascorrige máquinasmuchos analicen,exámenes. clasifiquen,Con comparen,el transformentiempo, el profesor aprende a reconocer rápidamente ciertas palabras clave o generenestructuras textosque indican si el alumno ha entendido el tema. Los sistemas de formaNLP automática.hacen Comoalgo yaparecido: hemosanalizan vistolos textos buscando patrones que permitan interpretar su contenido.

Algunas técnicas clásicas de NLP

Antes de la aparición de los modelos actuales, muchas aplicaciones de procesamiento del lenguaje se basaban en capítulosmétodos anteriores,estadísticos larelativamente clave está en aceptar una idea fundamental:las máquinas no entienden el lenguajesimples, pero puedenmuy trabajar con él si lo transformamos adecuadamente.útiles.

Antes

Uno de “entender”, hay que contar: el lenguaje convertido en números

El primer paso en cualquier sistema de NLP es siempre el mismo: convertir el texto en números.Una máquina no ve frases ni ideas; ve vectores numéricos. La historia del NLP es, en buena medida, la historia de cómo representar el lenguaje de forma numérica.

Durante muchos años, los enfoquesalgoritmos más eficaces no fueron modelos complejos, sino métodos relativamente sencillos basados en una idea muy intuitiva:

las palabras que aparecen muchas veces en un texto nos dicen algo sobre ese texto.

Aquíconocidos es donde entran en juego técnicas clásicas como Bag of Words y, sobre todo, TF-IDF.

TF-IDF: una idea simple con un impacto enorme

TF-IDF (Term Frequency – Inverse Document Frequency)Frequency). esEsta unotécnica dese losutiliza conceptospara identificar las palabras más importantes deldentro NLPde clásicoun y sigue siendo muy útil hoy en día, incluso en sistemas modernos.documento.

La idea es sorprendentementebastante sencilla:intuitiva. Si una palabra aparece muchas veces en un texto, probablemente sea relevante para ese documento. Pero si esa misma palabra aparece en todos los documentos de una colección (por ejemplo “el”, “la” o “de”), entonces su valor informativo es menor.

TF-IDF combina estas dos ideas para calcular qué palabras son realmente significativas dentro de un texto. Este tipo de técnica se ha utilizado durante años en aplicaciones como:

En el ámbito educativo, este tipo de algoritmos se pueden explicar fácilmente con ejemplos sencillos, como analizar qué palabras caracterizan un artículo científico o un texto periodístico.

Otras tareas habituales del NLP

A partir de estas técnicas se desarrollaron muchas aplicaciones prácticas. Algunas de las más conocidas son:

palabrasDurante muymuchos frecuentesaños, peroestas poco informativas (“el”, “de”, “y”) pesan poco,

palabras menos frecuentes pero más específicas pesan mucho.

En lugar de preguntarse “¿qué significa esta palabra?”, el sistematareas se pregunta:

resolvieron combinando “¿quéestadística, palabraslingüística distingueny estereglas textoprogramadas manualmente.

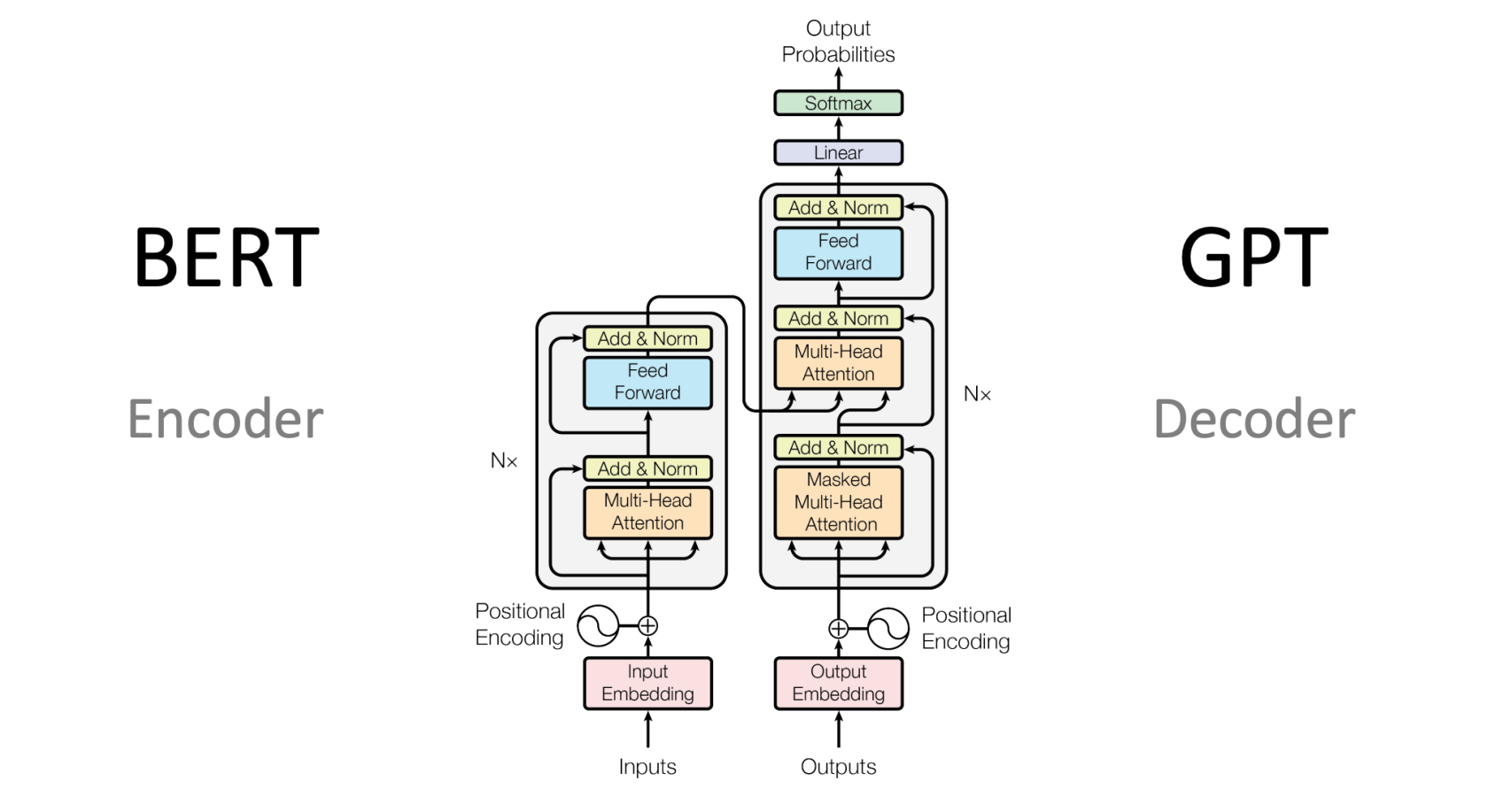

La revolución de los demás?”modelos Transformers

Sin

Unembargo, ejemploel educativocampo muydel claro

NLP ha experimentado una auténtica revolución desde la aparición de una nueva arquitectura de modelos llamada Transformers, presentada en 2017 en el famoso artículo “Attention is All You Need”.

ImaginemosLos modelos basados en transformers son capaces de analizar el contexto completo de una frase y comprender mejor las relaciones entre palabras. Gracias a esta arquitectura se han desarrollado los actuales modelos de lenguaje de gran tamaño (LLM), como GPT, Gemini o Claude.

Esto ha permitido que tenemosmuchas redaccionestareas de alumnadoprocesamiento sobredel distintoslenguaje temas:que cambioantes climático,requerían redessistemas socialescomplejos y deporte.Laespecíficos palabraahora “clima”puedan apareceráresolverse muchascon veces en textos sobre medioambiente, pero muy poco en los demás.TF-IDF asignará a esa palabra un pesoúnico altomodelo encapaz esosde textos,realizar porquemúltiples ayudatareas: atraducir, distinguirresumir, elresponder tema.preguntas o generar texto.

En cambio,otras palabras como “persona” o “importante” aparecerán en casi todos los textos y, aunque sean frecuentes, no ayudan a diferenciar. TF-IDF les asignará un peso bajo.

Así, cada texto se convierte en un vector numérico que representa su contenido de forma aproximada, pero útil.

Aplicaciones reales de TF-IDF en educación

Aunque hoy hablemos mucho de modelos profundos y LLMs,palabras, técnicas clásicas como TF-IDF o los modelos estadísticos tradicionales siguen teniendosiendo aplicacionesimportantes muypara prácticasentender los fundamentos del NLP, pero los modelos actuales basados en contextostransformers educativos.

Algunosampliado ejemplosenormemente nolas triviales:

Deteccióncapacidades detemaslospredominantes en documentos largosAnalizar qué conceptos aparecen con mayor peso en un proyecto o memoria.Análisissistemas deencuestas abiertasExtraer palabras clave y tendencias en respuestas abiertas de alumnado o familias.lenguaje.-

solo por coincidencia literal, sino por peso semántico aproximado. Primer filtrado previo a modelos más complejosReducir ruido y volumen de datos antes de aplicar Deep Learning.TF-IDF es suficiente,es más rápido,más transparente,y más fácil de justificar pedagógicamente.Primero, contamos palabras (frecuencia).Luego, ponderamos su importancia (TF-IDF).Después, aprendemos relaciones entre palabras (modelos profundos).

humanoFinalmente, generamoslenguaje(LLMs).puede

Desde el punto de vista docente, TF-IDF tiene una ventaja clara: es interpretable.Podemos explicar por qué una palabra pesa más que otra, algo mucho más difícil en modelos profundos.

Del conteo a la relación: el salto conceptual del NLP moderno

Las técnicas clásicas como TF-IDF no capturan relaciones profundas entre palabras. No saben que “profesor” y “docente” están relacionados, ni que “aprender” y “estudiar” se parecen en significado.

Aquí es dondeeducativo, el NLP modernopuede daentenderse el salto gracias alcomo Deepun Learningconjunto de herramientas para analizar grandes cantidades de texto. En lugarun mundo donde cada día se generan millones de representardocumentos, palabrasartículos soloy pormensajes, suestas frecuencia,técnicas lospermiten modelosorganizar aprendenla representacionesinformación, distribuidasdetectar quepatrones capturany relacionesextraer conocimiento.

Para el profesorado de contexto.asignaturas Palabrascientíficas queo aparecentecnológicas, en contextos similares acaban teniendo representaciones numéricas similares.

Sin embargo —y esto es importante para el aula—,explicar el NLP modernotambién puede ser una buena oportunidad para conectar nolingüística, sustituye completamente a técnicas como TF-IDF. En muchos casos:

NLP clásicoestadística y NLPcomputación, profundo:mostrando una convivencia necesaria

Desde una perspectiva educativa, es útil entendercómo el NLP como una evolución, no como una ruptura.

Cada nivel añade potencia, pero también complejidadestudiarse y opacidad.analizarse Enmediante educación,modelos no siempre interesa llegar al último nivel.

NLPmatemáticos y aprendizaje humano: un espejo imperfecto

Resulta interesante comparar el NLP con cómo aprendemos lenguaje las personas. Un niño empieza reconociendo palabras, luego relaciones simples y, con el tiempo, significados complejos. El NLP recorre un camino parecido, pero sin intención ni comprensión.algoritmos.

TF-IDF

Herramientas donde aparecen técnicas NLP clásicas y modernas (solo referencia)

En contextos educativos y formativos, el NLP —desde TF-IDF hasta modelos profundos— aparece en herramientas y entornos como:

scikit-learnspaCyNLTKHugging FaceOrange Data MiningWekaGoogle Colab

Muchas de estas herramientas combinan técnicas clásicas (como TF-IDF) con modelos modernos, lo que las hace especialmente útiles para la enseñanza.

Conclusión

El Procesamiento del Lenguaje Natural nos enseña una lección muy valiosa para la educación:no todo aprendizaje complejo empieza siendo profundo.

A veces, contar bien es más útil que intentar comprenderlo todo.TF-IDF, con su aparente simplicidad, sigue siendo una herramienta poderosa porque es comprensible, explicable y pedagógicamente honesta.

Las máquinas pueden analizar palabras; el profesorado ayuda a construir significado.