IA HAT+ y AI Camera

Este proyecto nace de la intención de montar en mi centro una herramienta de IA de uso local que no dependa (y no envíe) datos a internet. Spoiler: No sale bien.

IA HAT+

xxx

AI Camera

xxx

Proyectos

Enumeración de los diferentes proyectos probados

Creación de un LLM de uso local sin dependencia de internet

Como ya se adelantó anteriormente, la idea

Algún proyecto con la cámara

xxx

---------------- Reordenar lo de abajo

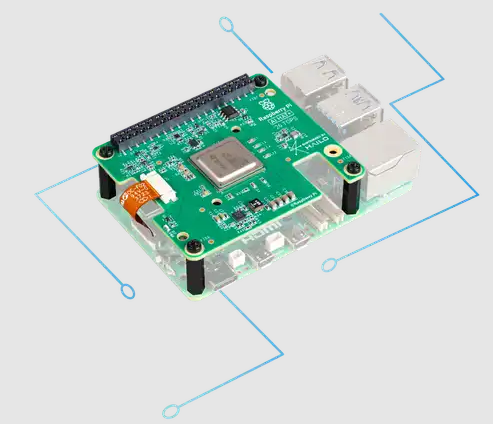

Raspberry nos presenta lo que llama un "sombrero" para su Raspberry Pi 5. Se trata de una placa que se conecta a la Raspberry Pi con un hardware específico que dota a la Raspebrry Pi de capacidad de trabajo real con IA.

Toda la documentación de esta placa podemos encontrarla en:

- https://www.raspberrypi.com/products/ai-hat/

- https://www.raspberrypi.com/documentation/accessories/ai-hat-plus.html

- https://pip-assets.raspberrypi.com/categories/1081-raspberry-pi-ai-hat/documents/RP-008133-DS-1-raspberry-pi-ai-hat-plus-product-brief.pdf?disposition=inline

- La nueva versión está en https://www.raspberrypi.com/products/ai-hat-plus-2/

Raspberry Pi completa este "lote IA" con una cámara especialmente enfocada a IA. Toda la documentación podemos encontrarla en https://www.raspberrypi.com/documentation/accessories/ai-camera.html

Para la elaboración de estos materiales voy a trabajar con:

- Raspberry Pi 5 de 16 GB de RAM

- Cargador oficial de Raspberry Pi 5

- Tarjeta microSD oficial de 128 GB (en previsión de descarga de modelo IA de gran tamaño)

- Raspberry Pi IA HAT+ en su versión de 26 TOPs

-

el término TOPs es una unidad de medida que se utiliza para cuantificar el rendimiento de los procesadores diseñados para ejecutar tareas de IA. Sus siglas significan Tera Operations Per Second (Billones de operaciones por segundo)

- No nos ha sido posible encontrar en el mercado la versión AI HAT+2 (40 TOPs y memoria dedicada). Probablemente llevándose el desarrollo de esta práctica a ese hardware si que sería exitosa la parte de montar una IA local.

-

- Raspberry Pi IA Camera

Todo ensablado queda como se ve en la siguiente imagen:

(TO DO)

Comenzamos:

- Con Raspberry Pi imager cargo en la SD la imagen del sistema operativo para la raspberry pi 5

- Actualizamos sistema y borramos paquetes innecesarios

- Ejecutamos en terminal

sudo apt update && sudo apt upgrade -y && sudo apt autoremove -y && sudo apt clean

- Ejecutamos en terminal

- Instalamos Ollama

- Nos va a permitir gestionar modelos de lenguaje

- Web de Ollama con información https://ollama.com/

- Ejecutamos en terminal

curl -fsSL https://ollama.com/install.sh | sh - Tras instalarlo merece la pena fijarse en 3 líneas que arroja el instalador:

The Ollama API is now available at 127.0.0.1:11434Nos indica dónde ha montado por defecto un servidor al cual lanzarle peticionesInstall complete. Run "ollama" from the command line.Nos indica cual es el comando que deberamos usar para trabajar con OllamaWARNING: No NVIDIA/AMD GPU detected. Ollama will run in CPU-only mode.Aquí ya nos advierte de que el funcionamiento de Ollama no va a ser óptimo

- Descargamos un modelo para trabajar con él

- Enumero los que en este momento (abril de 2026) corren en el hw con el que contamos:

- llama3.2:3b (rápido y ligero)

- mistral:7b (más capaz, mas lento)

- phi3:mini (muy eficiente para su tamaño)

- gemma2:2b (excelente relación calidad/velocidad)

- Instalamos 1 de ellos. Los demás se haría de modo análogo

- Ejecutamos en el terminal

ollama pull phi3:mini

- Ejecutamos en el terminal

- Enumero los que en este momento (abril de 2026) corren en el hw con el que contamos:

- Lo probamos a través de una llamada al API REST

- Escribimos en el terminal:

curl http://127.0.0.1:11434/api/generate -d '{ "model": "phi3:mini", "prompt": "Explica qué es una raspberry pi", "stream": false }'- Y esperamos por aproximadamete 3-4 minutos para ver el resultado. Luego con este modelo, no es funcional

- Vamos a descargar otro modelo mas ligero y repetir la consulta:

- Vamos a preparar una interfaz web para quienes no quieran usar el terminal