2.2 Tipos de aprendizaje, Machine Learning y Deep Learning

Cuando hablamos de Inteligencia Artificial, uno de los conceptos fundamentales es el Machine Learning o aprendizaje automático. De forma sencilla, el Machine Learning es una forma de programación en la que, en lugar de escribir todas las reglas de forma explícita, enseñamos al ordenador a aprender a partir de datos.

Un buen símil para entenderlo es el proceso de aprendizaje de un estudiante. En una clase tradicional, el profesor explica una regla y el alumno la aplica o ejecuta, en cambio, en el aprendizaje automático se le muestran muchos ejemplos de manera que le permitan inducir la regla a partir de los mismos asi que descubre por sí mismo los patrones que hay detrás.

En el caso de las máquinas, el proceso es similar, si queremos que un ordenador aprenda a reconocer por ejemplo gatos en imágenes, podríamos intentar programar reglas como “tiene orejas puntiagudas”, “tiene bigotes” o “tiene cuatro patas”. Sin embargo, esto sería extremadamente complicado, porque hay muchas variaciones posibles. En cambio, con Machine Learning lo que hacemos es mostrar al sistema miles de imágenes de gatos y de otros animales, obteniendo un modelo que es capaz de reconocer las características que diferencian unos de otros. Así, cuando le mostremos un nuevo ejemplar que no ha visto nunca, será capaz de distinguirlo.

Cómo aprende un modelo de Machine Learning

Una forma sencilla de entender el funcionamiento del Machine Learning es pensar en él como en un proceso de ajuste de un modelo a partir de datos.

Podemos imaginarlo como cuando en matemáticas intentamos encontrar la función que mejor se ajusta a una nube de puntos en un gráfico. El modelo comienza con una hipótesis inicial y va modificando sus parámetros hasta que el error entre sus predicciones y los datos reales se reduce.

Por ejemplo, si queremos predecir la relación entre la temperatura y el consumo eléctrico, podríamos introducir datos históricos de temperatura y consumo. El modelo analiza esos datos y trata de encontrar patrones que permitan predecir el consumo a partir de la temperatura.

Este proceso es similar al que realizan los científicos cuando elaboran modelos para explicar fenómenos naturales: se observan datos, se propone un modelo y se ajusta hasta que explica razonablemente bien las observaciones.

Tipos básicos de aprendizaje automático

En términos generales, el Machine Learning suele clasificarse en tres grandes tipos.

El aprendizaje supervisado es el más habitual. En este caso el modelo aprende a partir de ejemplos que ya tienen una respuesta conocida. Por ejemplo, un conjunto de imágenes etiquetadas como “gato” o “perro”.

El aprendizaje no supervisado se utiliza cuando los datos no están etiquetados. El modelo intenta encontrar patrones o agrupaciones dentro de los datos. Esto se utiliza, por ejemplo, para analizar grandes conjuntos de información y detectar estructuras ocultas.

El aprendizaje por refuerzo se basa en un sistema de prueba y error. El modelo toma decisiones y recibe recompensas o penalizaciones en función de sus resultados. Este tipo de aprendizaje se utiliza, por ejemplo, en sistemas que aprenden a jugar videojuegos o a controlar robots.

Deep Learning hoy: redes neuronales profundas y modelos modernos

El Deep Learning (aprendizaje profundo) es actualmente una de las técnicas más importantes dentro del Machine Learning. Su idea central consiste en utilizar redes neuronales artificiales con muchas capas capaces de aprender directamente a partir de grandes cantidades de datos. Estas redes procesan la información de forma progresiva, transformando los datos en representaciones cada vez más complejas hasta llegar a una predicción o decisión final.

En términos simples, una red profunda funciona como una cadena de procesamiento de información. Cada capa de la red aprende a reconocer determinados patrones y pasa el resultado a la siguiente capa. De esta forma se construyen representaciones cada vez más abstractas. Por ejemplo, en un sistema que analiza imágenes, las primeras capas pueden detectar bordes o colores, las siguientes formas o texturas, y las capas finales objetos completos como coches, animales o personas.

Tipos de modelos en Deep Learning

Dentro del Deep Learning existen diferentes arquitecturas de redes neuronales, cada una diseñada para tipos concretos de problemas.

Redes neuronales convolucionales (CNN)

Uno de los modelos más conocidos son las Convolutional Neural Networks (CNN). Estas redes están diseñadas especialmente para trabajar con imágenes o datos visuales. Utilizan filtros que recorren la imagen para detectar patrones como bordes, texturas o formas, lo que permite identificar objetos dentro de una fotografía.

Las CNN se han convertido durante años en el estándar en visión artificial, con aplicaciones como:

-

reconocimiento facial

-

detección de objetos en imágenes

-

diagnóstico médico mediante radiografías

-

vehículos autónomos

-

análisis de vídeo

Modelos famosos como AlexNet, VGG, ResNet o Inception han demostrado que las redes profundas pueden superar ampliamente a los métodos tradicionales de visión por computador.

Redes para secuencias y lenguaje

Otro tipo de redes neuronales se diseñaron para trabajar con secuencias de datos, como texto o audio. Durante años se utilizaron modelos como las Recurrent Neural Networks (RNN) o las LSTM, capaces de analizar información que depende del contexto anterior, como frases o series temporales.

Sin embargo, estos modelos tenían limitaciones para procesar grandes volúmenes de información y dependencias muy largas dentro de un texto.

Transformers: el gran salto reciente

El gran avance reciente en Deep Learning llegó con los transformers, una arquitectura presentada en 2017 que cambió profundamente el procesamiento del lenguaje natural. Estos modelos utilizan un mecanismo llamado self-attention, que permite analizar las relaciones entre todos los elementos de una secuencia al mismo tiempo.

Gracias a esta arquitectura, los modelos pueden comprender mejor el contexto de un texto o una conversación, identificando qué palabras o elementos son más importantes dentro de una frase. Además, los transformers pueden procesar datos en paralelo, lo que los hace mucho más eficientes que los modelos anteriores.

Hoy en día los transformers se utilizan en muchos ámbitos:

-

procesamiento del lenguaje natural

-

traducción automática

-

generación de texto

-

reconocimiento de voz

-

visión artificial

-

análisis de series temporales

Incluso han surgido variantes como los Vision Transformers, que aplican esta arquitectura al análisis de imágenes dividiéndolas en pequeños fragmentos que se procesan como si fueran tokens de texto

La base de los modelos actuales de IA

Estas arquitecturas de Deep Learning son las que han permitido desarrollar muchos de los sistemas actuales de inteligencia artificial. Sobre ellas se construyen tecnologías como:

-

modelos de lenguaje de gran tamaño (LLM)

-

sistemas de reconocimiento de voz

-

generadores de imágenes

-

asistentes virtuales

-

sistemas de recomendación

-

aplicaciones de IA generativa

En todos estos casos, el principio es el mismo: el sistema aprende patrones complejos en grandes conjuntos de datos y utiliza ese conocimiento para realizar predicciones o generar nuevas respuestas

El Deep Learning sigue evolucionando rápidamente. Nuevas arquitecturas, modelos híbridos (como combinaciones de CNN y transformers) y técnicas de entrenamiento aparecen constantemente.

Lo que comenzó como una idea inspirada en redes neuronales simples se ha convertido en el motor de muchas de las tecnologías más avanzadas de la actualidad. Comprender el Deep Learning permite entender cómo funcionan muchos de los sistemas de inteligencia artificial que hoy forman parte de nuestra vida cotidiana: desde los asistentes de voz hasta los modelos generativos que producen texto, imágenes o código.

Relación con las asignaturas científicas

La IA en general, y las técnicas de ML tiene una relación muy estrecha con muchas disciplinas científicas. En realidad, gran parte de sus fundamentos se basan en conceptos que ya aparecen en materias como matemáticas, estadística, física o informática.

Por ejemplo, muchos algoritmos de aprendizaje automático utilizan técnicas de optimización matemática, cálculo diferencial o álgebra lineal. Desde esta perspectiva, el ML puede entenderse como una extensión moderna de métodos estadísticos que ya se utilizaban para analizar datos.

En física o en ciencias experimentales, los modelos de aprendizaje automático se utilizan cada vez más para analizar grandes conjuntos de datos, identificar patrones o realizar predicciones

Un ejemplo sencillo para el aula

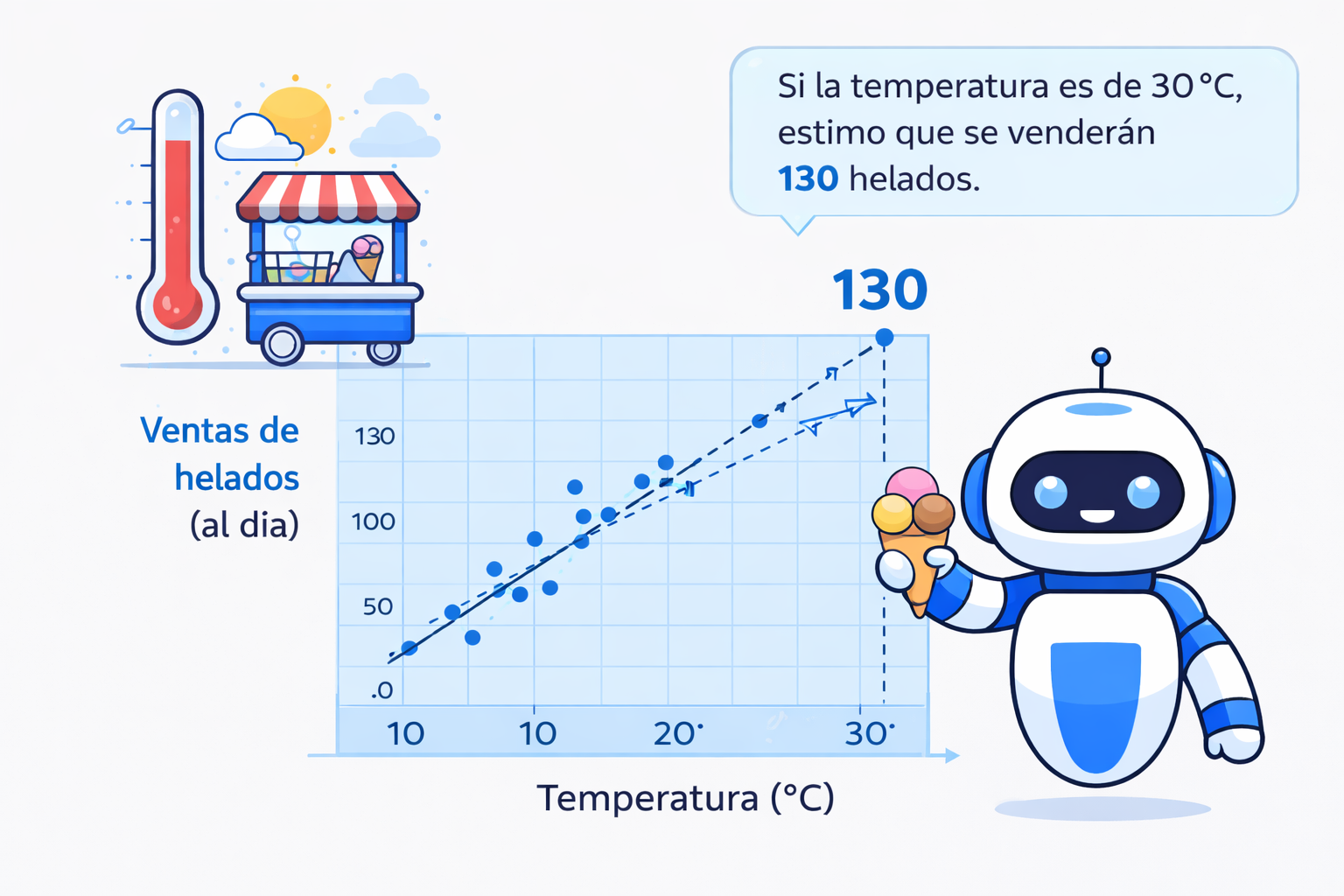

Un ejemplo muy accesible para explicar el ML consiste en trabajar con datos de temperatura y ventas de helados. Si representamos ambos valores en un gráfico, observaremos que existe cierta relación: cuando aumenta la temperatura, suelen aumentar las ventas.

Un modelo de aprendizaje automático puede utilizar esos datos para aprender esa relación y hacer predicciones. Por ejemplo, podría estimar cuántos helados se venderán si la temperatura alcanza los 30 grados.

El gráfico refleja los puntos reales a partir de los cuales obtenemos la línea que nos predice los siguientes

Este tipo de ejemplos permite mostrar al alumnado que el ML no es magia, sino un proceso de análisis de datos y construcción de modelos, muy relacionado con los métodos científicos tradicionales y sobre todo con métodos estadísticos.

El papel del científico o del ingeniero sigue siendo fundamental: elegir los datos adecuados, interpretar los resultados y comprender los límites del modelo.

En este sentido, el ML no sustituye al pensamiento científico, sino que se convierte en una herramienta más para explorar, analizar y comprender fenómenos complejos.

Aplicaciones del Machine Learning en la vida cotidiana

Aunque a veces se presenta como una tecnología muy avanzada o futurista, lo cierto es que el Machine Learning ya está integrado en muchas de las herramientas digitales que utilizamos a diario, a menudo sin que nos demos cuenta. En esencia, estos sistemas aprenden a partir de datos para detectar patrones y mejorar sus decisiones con el tiempo.

Un ejemplo muy claro lo encontramos en las plataformas de contenido digital. Cuando abrimos Netflix o Spotify, no vemos el mismo catálogo que cualquier otra persona. Los sistemas de recomendación analizan lo que hemos visto o escuchado anteriormente, cuánto tiempo pasamos con cada contenido, qué tipo de género preferimos o incluso a qué hora solemos usar la plataforma. A partir de esos datos, el sistema aprende patrones y sugiere nuevas películas, series o canciones que probablemente nos gusten. No se trata de una selección aleatoria: es una predicción basada en comportamientos similares de millones de usuarios.

Otro caso cotidiano aparece en el correo electrónico. Servicios como Gmail utilizan modelos de Machine Learning para detectar correos no deseados o spam. El sistema analiza miles de características de los mensajes: palabras frecuentes en correos fraudulentos, estructura del texto, enlaces sospechosos o comportamiento del remitente. Con el tiempo, el sistema aprende a distinguir qué mensajes son legítimos y cuáles no.

También encontramos Machine Learning en algo tan habitual como desbloquear el teléfono móvil. Sistemas como Face ID utilizan modelos de aprendizaje automático para reconocer el rostro del usuario. El sistema aprende las características de la cara —forma, distancias entre puntos clave, iluminación— y es capaz de identificarla incluso si cambian pequeños detalles como la expresión, el peinado o el uso de gafas.

Otro ejemplo muy visible es la traducción automática. Herramientas como Google Translate utilizan modelos de aprendizaje automático para traducir textos entre distintos idiomas. En lugar de aplicar únicamente reglas lingüísticas tradicionales, estos sistemas han aprendido a partir de enormes colecciones de textos traducidos, lo que les permite generar traducciones cada vez más naturales.

En el comercio digital también encontramos múltiples aplicaciones. Cuando navegamos por tiendas online como Amazon, el sistema analiza lo que hemos buscado, los productos que hemos consultado y las compras de otros usuarios con intereses similares. A partir de esos datos, sugiere nuevos productos que podrían interesarnos. De nuevo, el modelo está aprendiendo relaciones entre comportamiento y preferencias.

En el ámbito educativo, el Machine Learning también empieza a tener aplicaciones interesantes. Algunas plataformas de aprendizaje analizan el progreso del alumnado: cuánto tiempo dedica a cada actividad, qué preguntas falla con mayor frecuencia o en qué temas muestra más dificultad. A partir de esa información, el sistema puede sugerir ejercicios de refuerzo o adaptar el ritmo de aprendizaje.

En otros casos, el análisis de datos educativos permite detectar patrones que ayudan a los docentes. Por ejemplo, se pueden identificar conceptos que generan más dificultades en una clase, predecir posibles abandonos o recomendar materiales de apoyo para determinados estudiantes.

Desde una perspectiva educativa, comprender estos ejemplos cotidianos es importante porque ayuda a desmitificar la tecnología. El Machine Learning no es magia ni ciencia ficción: es, en gran medida, una forma de aprender a partir de datos para mejorar decisiones y predicciones. Y cada vez más forma parte de las herramientas con las que convivimos diariamente.

El papel del profesor de ciencias en la era de la IA Generativa

La expansión del ML, y por ende, de la IA Generativa está teniendo un impacto especialmente interesante en las asignaturas científicas. Matemáticas, Física, Química, Tecnología o Informática son áreas donde estas herramientas no solo pueden utilizarse como apoyo, sino también como objeto de estudio y experimentación dentro del aula.

En este contexto, el papel del profesor adquiere una dimensión nueva. No se trata únicamente de explicar qué es la inteligencia artificial, sino de mostrar cómo funciona y cómo se construye, utilizando ejemplos accesibles y experimentos sencillos con datos. Para el profesorado de áreas científicas, esto abre una oportunidad muy valiosa: trabajar con el alumnado para crear pequeños modelos de ML a partir de datos reales.

Por ejemplo, los estudiantes pueden trabajar con conjuntos de datos simples —temperaturas, resultados deportivos, consumo energético, ventas de productos o datos meteorológicos— y construir modelos básicos que permitan hacer predicciones. Este tipo de actividades ayuda a comprender que detrás de la inteligencia artificial no hay magia ni pensamiento consciente, sino procesos que identifican patrones estadísticos en grandes cantidades de datos.

De hecho, uno de los aprendizajes más importantes que el alumnado puede obtener es entender que la llamada “inteligencia” de estos sistemas es esencialmente estadística. Los modelos no entienden el mundo como lo hace una persona; simplemente calculan probabilidades a partir de los datos con los que han sido entrenados. Comprender este aspecto es fundamental para desarrollar una visión crítica y realista de la tecnología.

Además, las herramientas actuales permiten ir más allá de la simple explicación teórica. Hoy es posible utilizar modelos de inteligencia artificial en el aula para explorar fenómenos científicos, crear simulaciones o generar experimentos virtuales. Por ejemplo, se pueden generar simulaciones de movimiento físico, visualizar modelos matemáticos, representar funciones o experimentar con distintos parámetros para observar cómo cambian los resultados.

También existen muchas aplicaciones basadas en IA generativa que pueden ayudar a diseñar actividades educativas más dinámicas. Los docentes pueden crear cuestionarios interactivos, simuladores de decisiones, pequeños juegos educativos o actividades gamificadas que permitan trabajar contenidos científicos de una manera más participativa. En este sentido, la IA puede convertirse en una herramienta útil para fomentar aprendizajes más activos y experimentales.

Por otro lado, estas herramientas también facilitan tareas habituales del profesorado, como la generación de materiales didácticos, presentaciones, ejemplos prácticos o actividades de evaluación. Un modelo de lenguaje puede ayudar a diseñar problemas matemáticos, generar explicaciones adaptadas a distintos niveles o proponer ejercicios de repaso. Del mismo modo, puede servir como apoyo para analizar resultados académicos o generar nuevas preguntas para evaluaciones.

Sin embargo, el elemento clave sigue siendo el papel del docente. La inteligencia artificial puede generar contenidos o analizar datos, pero no puede sustituir la función pedagógica del profesor. Es el profesorado quien decide qué herramientas utilizar, cómo integrarlas en el currículo y cómo orientar su uso para que contribuyan realmente al aprendizaje.

En las asignaturas científicas, esta situación abre una oportunidad especialmente interesante: utilizar la inteligencia artificial no solo como herramienta, sino también como laboratorio para comprender cómo funcionan los sistemas tecnológicos actuales. De este modo, el alumnado no solo utiliza la tecnología, sino que también aprende a entenderla, cuestionarla y analizarla críticamente.

En definitiva, el reto para el profesorado en la era del ML no es competir con la inteligencia artificial, sino aprovecharla como recurso educativo. Cuando se integra con sentido pedagógico, puede ayudar a desarrollar habilidades clave como el pensamiento crítico, la interpretación de datos, la experimentación científica y la comprensión de los sistemas tecnológicos que cada vez tienen más presencia en nuestra sociedad.

No comments to display

No comments to display