2.4 Medioambiente

Introducción

LasComo consecuenciastoda medioambientalesactividad dehumana, la revolución inducida por la adopción masiva de la Inteligencia Artificial tienen una huella medioambiental que tiene dos vertientes.polos opuestos, pues tiene un coste directo por su funcionamiento y construcción y unos beneficios indirectos por influir aumentando la eficiencia de otras actividades económicas.

Por un lado, la expansión de la infraestructura asociada a esta tecnología genera un coste medioambiental directo, primero en la construcción de instalaciones y en el entrenamiento (una sola vez) y, después, en los diferentes usos, el llamado coste en inferencia.

Esta huella medioambiental se concreta en términos de consumo energético, en términos de consumo de agua, en contaminación en uso de recursos naturales y en ocupación del territorio. Esto no es algo sorprendente pues es algo que sucede con todas las actividades económicas y lo que cada sociedad debe valorar es su punto de equilibrio en el balance entre todos los factores, incluyendo el desarrollo económico.

Por otra parte, el empleo de inteligencia artificial para transformar procesos productivos y logísticos puede de forma indirecta, propiciar o favorecer un impacto ambiental positivo mediante el ahorro energético, de agua, de recursos, la mejora de los procesos de reciclaje o impulsando avances científicos y tecnológicos que aporten en estos y otros campos. Estos beneficios indirectos tienen que ser valorados en la balanza anteriormente citada.

Tenemos ante nosotros un nuevo dilema similar a los anteriormente presentados, esta vez en este campo. Por un lado, se presenta como una herramienta sin precedentes para la optimización de recursos y la mitigación del cambio climático. Por otro, su infraestructura subyacente impone una presión masiva sobre los sistemas energéticos e hídricos globales.

Análisis energético de la computación avanzada

La inteligencia artificial, especialmente cuando hablamos de aprendizaje profundo y de modelos generativos, posee un perfil energético que se diferencia cualitativamente de la informática tradicional.

Mientras que en las tareas de oficina o la navegación web convencional se basan en procesos deterministas con baja densidad de cómputo, la IA depende de la manipulación de miles de millones de parámetros en arquitecturas de redes neuronales que generan un calor residual masivo y requieren un alimentación energética constante y una permanente necesidad de refrigeración.

La infraestructura del centro de datos moderno

Los centros de datos han evolucionado para albergar unidades de procesamiento gráfico (GPU) y unidades de procesamiento tensorial (TPU), que son el hardware mas eficiente para la IA. A diferencia de las unidades centrales de procesamiento (CPU) tradicionales, las GPUs están diseñadas para el cálculo paralelo masivo, lo que genera una densidad térmica extremadamente alta. Un rack de servidores convencional suele operar a una potencia de 7 a 10 kW, pero los racks dedicados a la IA están alcanzando densidades de 30 a 100 kW, e incluso se proyectan sistemas de hasta 600 kW para finales de la década.

| Componente o Sistema | Consumo de Potencia o Densidad | Implicación Energética |

| CPU (Propósito general) | 150 - 300 W por chip |

Cómputo secuencial estándar |

| GPU NVIDIA A100 | 400 W por chip |

Cómputo paralelo para IA |

| GPU NVIDIA H100 | 700 W por chip |

Estándar actual de alto rendimiento |

| Rack de Servidores IA | 30 - 100+ kW$por rack |

Requiere refrigeración avanzada |

| Centro de Datos Hyperscale | > 100 MW de carga total |

Equivalente a una pequeña ciudad |

Potencia necesaria1

La eficiencia de estas instalaciones se mide a través del PUE (Power Usage Effectiveness), que es la relación entre la energía total consumida por el edificio y la energía que realmente llega a los equipos informáticos. La PUE siempre es mayor que 1, cuando más próxima a 1 es, mas eficiente es la instalación. Un PUE de 1.1 significa que por cada vatio dedicado a procesar datos, se necesitan 0.1 vatios adicionales para refrigeración e iluminación. Aunque las grandes tecnológicas han logrado reducir el PUE a niveles cercanos a 1.1 en sus instalaciones más modernas, el crecimiento exponencial del volumen de datos anula estas ganancias de eficiencia marginal. 1

Del entrenamiento a la inferencia

Entrenar un gran modelo de lenguaje (LLM) requiere una cantidad grande de energía, sin embargo, es un consumo que se hace una sola vez. Por ejemplo, el entrenamiento de GPT-4 requirió aproximadamente 50 Gigavatios-hora (MWh). España consume anualmente en torno a 250 000 GWh, 5000 veces más, por lo que este entrenamiento, que recordemos que sólo se produce una vez para cada modelo, no parece un coste muy grande en comparación con nuestra capacidad de generación.

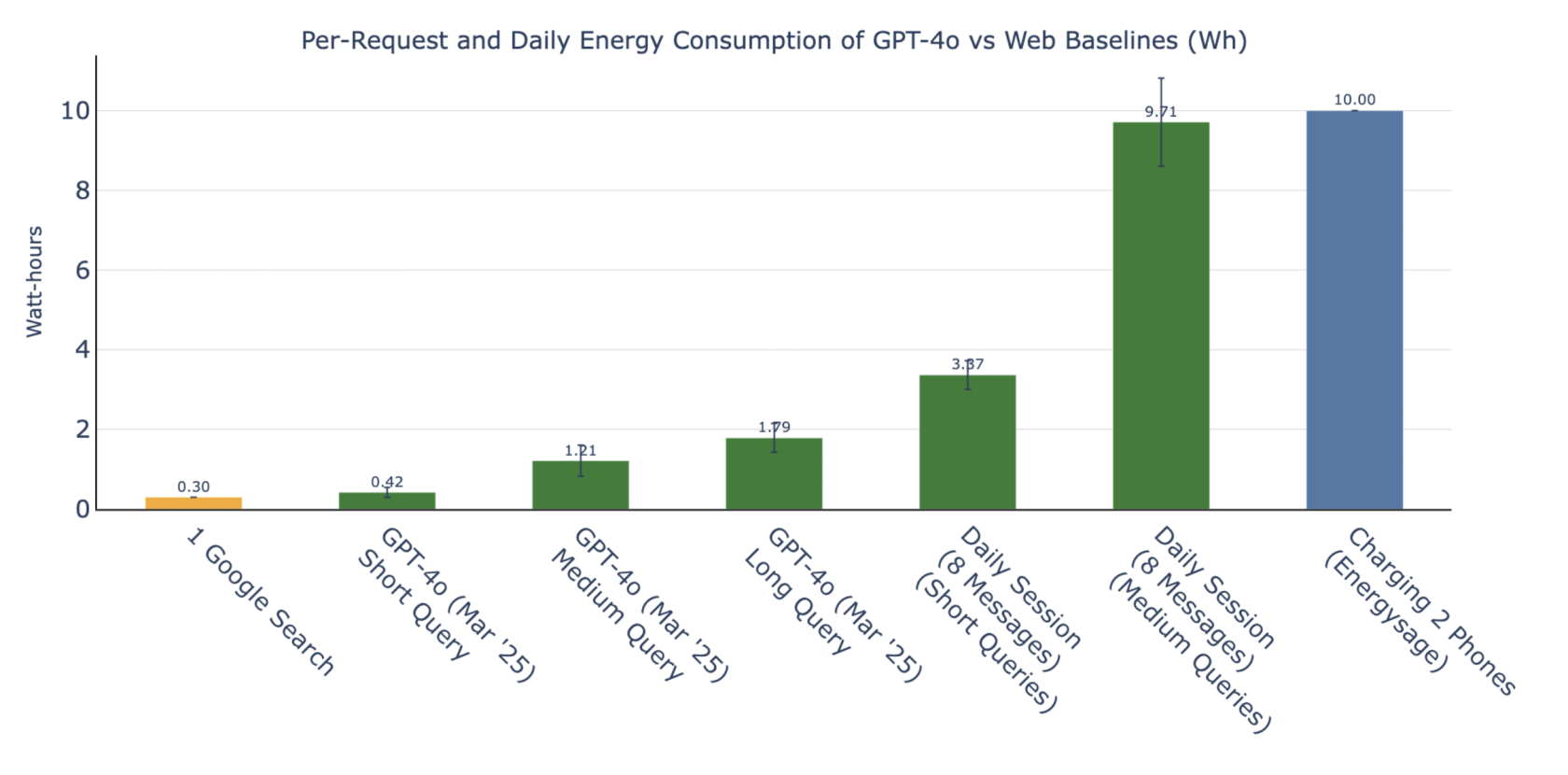

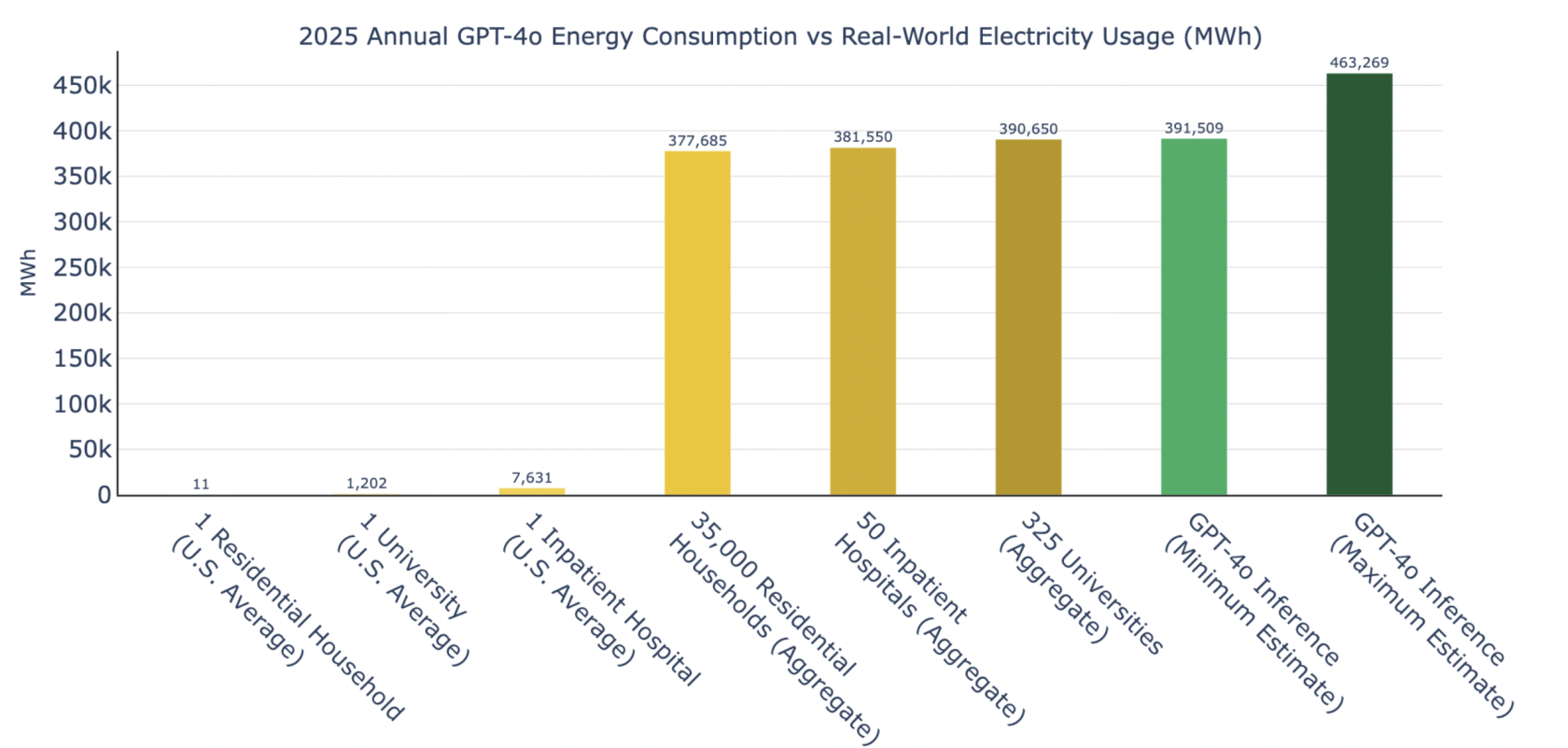

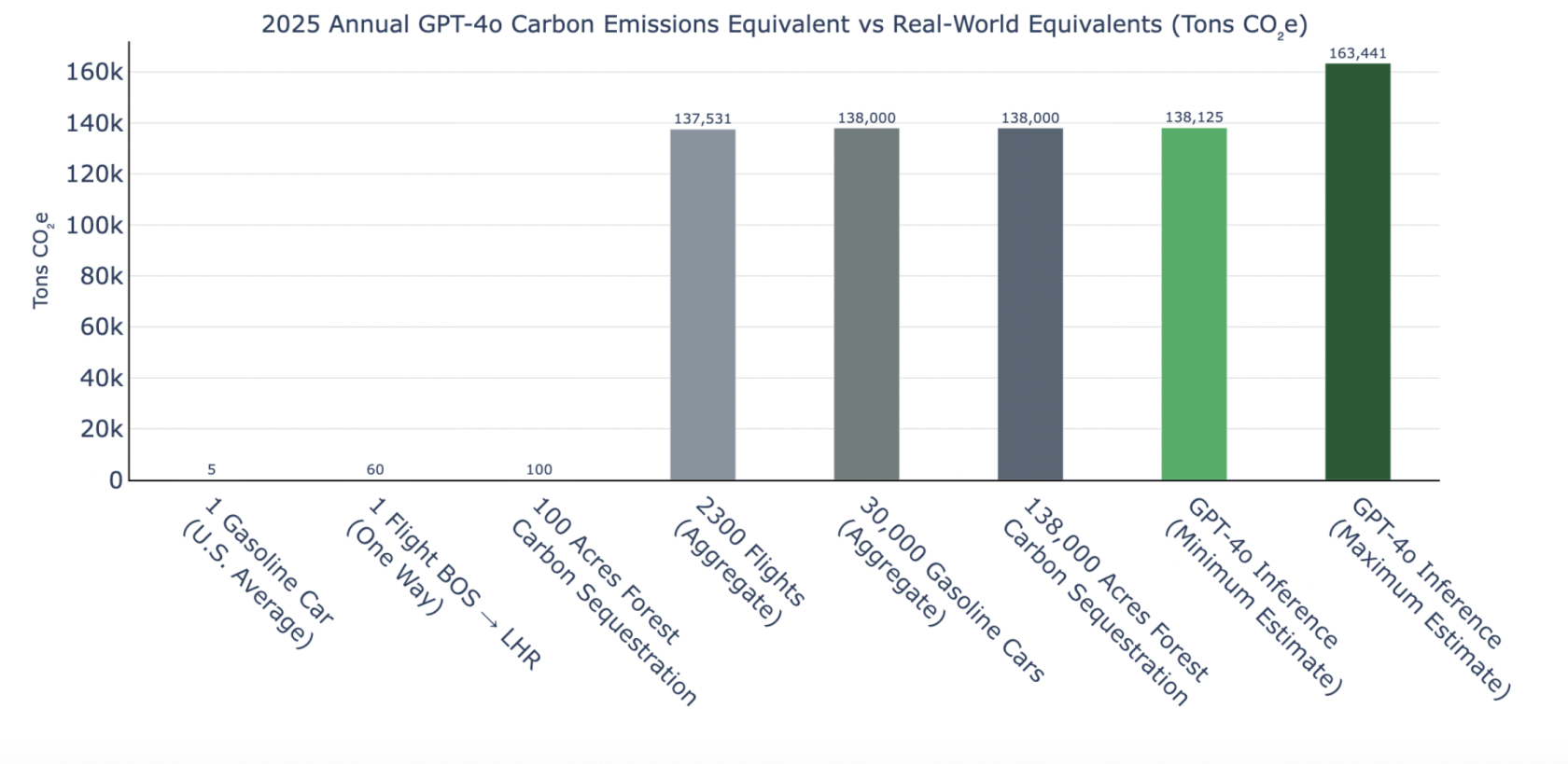

Una mayor huella energética está asociada al uso diario en inferencia, veamos en algunas tablas, procedentes de este estudio, algunos valores cotidianos comparados con los de GPT-42

Fuente: How Hungry is AI? Benchmarking Energy, Water, and Carbon Footprint of LLM Inference

Como vemos, el consumo global anual de todo GPT4 equivale a 35 000 viviendas en USA y su huella de carbono es la de 30 000 coches de gasolina.

Impacto en la infraestructura de red y precios locales de energía

La demanda de energía de los centros de datos está creciendo a un ritmo que supera la capacidad de expansión de las infraestructuras de transmisión. En Estados Unidos, las empresas de servicios públicos recibieron solicitudes de interconexión por más de 700 gigavatios (GW) en 2025, superando el consumo total del país en 2023. Cabe destacar que el tiempo necesario para ampliar estas infraestructuras es muy alto, pues incluye los tiempos administrativos de permisos de conexión, los análisis de impacto y un largo etc. Estos tiempos no permiten la adaptación con agilidad de las redes de distribución a la demanda de los centros de datos por lo que, si bien hemos visto que globalmente no parece un problema ahora el coste total, si puede ser un problema local la distribución de esta energía eléctrica.

Elpudiendo giroafectar haciaal coste de la energía nuclear

doméstica, Ante la necesidad de energía libre de carbono operativa las 24 horas (baseload) y generadasiempre en el mismo lugar que el consumo para evitar el cuello de botellafunción de la distribución,normativa lasque Big Tech han realizado apuestas multimillonarias por la energía nuclear :

Microsoft: Acordó pagar $16.000 millones para reactivarregule elreactorpreciodefinalThreedelMile Island en Pensilvania, proyectado para 2028.Amazon: Invirtió $20.000 millones para convertir el sitio de Susquehanna en un campus de datos alimentado por energía nuclear.Google: Firmó el primer acuerdo corporativo para una flota de reactores modulares pequeños (SMR) con Kairos Power, apuntando a 500 MW para 2030-2035.

Esta tendencia, presente en USA y no en España, indica el nacimiento de una una incipente "soberanía energética privada" donde las empresas tecnológicas no solo consumen energía, sino que se convierten en actores fundamentales de la infraestructura energética nacional, influyendo en la política climática y en la viabilidad de las metas de descarbonización.consumidor.

El consumo de agua: Refrigeración e impacto hídrico

La IA no solo consume electricidad, sino que también consume agua. El calor generado por los procesadores de alta densidad debe ser extraído para evitar fallos catastróficos. El agua es el medio de transporte de calor más eficiente económicamente, pero su uso genera una competencia directa con el consumo humano industrial y agrícola.

Huella hídrica directa e indirecta

La huella hídrica de la IA se divide en dos:

-

Uso directo: El agua evaporada en las torres de refrigeración de los propios centros de datos.

-

Uso indirecto: El agua consumida por las centrales eléctricas para enfriar sus propios procesos de generación de energía. Este volumen es mucho mayor, pudiendo suponer el 90% del gasto de agua.

Este consumo de agua por parte de la IA es una de las consecuencias menos visibles pero más geográficamente sensibles. LosComo hemos visto, los centros de datos de IA albergan racks de GPU que operan con densidades de potencia de 50 a 135 kW, muy por encima de los 10-20 kW de los servidores tradicionales. Disipar este calor requiere sistemas de gestión térmica que, en su mayoría, dependen de la evaporación de agua dulce. Es decir, el agua se consume para refrigerar estas "granjas de servidores". El consumo de agua de estos sistemas de refrigeración puede dividirse entre 3 con el empleo de sistemas de circuito cerrado con un coste un poco mayor, lo que mitiga mucho el impacto ambiental y social.

Medidas para paliar el consumo: Efectividad y consumo directoeficiencia

LaAnte este panorama, la industria utilizatecnológica no es indiferente. Se están implementando estrategias para mitigar estos efectos, aunque su eficacia a menudo se ve superada por el indicadorcrecimiento de Efectividad del Uso del Agua (WUE), expresado en litros consumidos por kilovatio-hora de energía de cómputo. El promedioneto de la industriademanda y de los servicios.

Innovaciones tecnológicas en infraestructura para el ahorro de agua

-

Refrigeración Líquida Directa (DLC): En lugar de enfriar el aire de la sala, se

sitúacirculanentrelíquidos1,8refrigerantes directamente sobre los chips. Esto permite que los procesadores operen a temperaturas más altas de forma segura y1,9reduceL/kWh.laParanecesidadponerdeestasevaporarcifrasagua enperspectiva,torreselexternas.entrenamiento -

GPT-3Aprovechamiento

endellosCalor Residual: Algunos centros de datosdeenMicrosoftEuropaevaporóestándirectamentecomenzandounosa700.000inyectarlitrosel calor excedente deaguasuspotable,servidorescantidadensuficientelaspara la fabricaciónredes de370calefaccióncoches BMW o 320 vehículos Tesla.La inferencia es más costosa por sumar millonesurbana deinteraccioneslas ciudades cercanas, transformando un residuo ambiental enentreunelrecursosistemacomunitario,y el usuario. Una conversación típica de 20 a 50 preguntas conen un sistemacomosimilarChatGPT-3aconsumíalasaproximadamente medio litrocentrales deagua dulce. Si se considera que OpenAI cuenta con aproximadamente 400 millones de usuarios semanales, el impacto hídrico agregado en 2023 fue este.cogeneración.EmpresaConsumo Hídrico Total (2023)Crecimiento AnualGoogle24.227 millones de litros+17%Microsoft7.844 millones de litros+34%Proyección Global IA (2027)4,2 - 6,6 billones de litrosN/APara hacer una comparación, ese consumo mundial de Google de 2,4 × 1010litros de agua, equivale a menos de un 0,1% del consumo anual de agua en EspañaLocalizacióny estrés hídrico. Sin embargo, las previsiones de crecimiento de esta demanda pueden presionar los sistemas hídricos y económicosEl impacto no es uniforme, como no lo es la distribución de estos consumos, sino localizado en lugares concretos. En Arizona, las instalaciones de Microsoft operan con un WUE de 1,52 L/kWh debido al clima árido, mientras que en Singapur se reduce a 0,02 L/kWh.Inteligente: Laproliferaciónrelocalización de centros de datos hacia regiones con climas más fríos (como los países nórdicos o el norte de España) y con redes eléctricas descarbonizadas (zonas eólicas como Aragón) puede reducir el impacto tanto encomunidadeshuella.dequecarbonoyaensufrenunestrés73% como el hídricogeneradirectoconflictosede uso con la agricultura y el consumo residencial. Por ejemplo, en The Dalles, Oregón, los centros de datos de Google consumen más de una cuarta parte de toda el agua utilizada por la ciudad.indirecto.La

-------------

. Redes de abastecimiento de energía como factor limitante a la expansión de los data centers. Expansión de la demanda y presión de los precios locales de un bien de interés público como la energía eléctrica.

Gasto de agua: Diferenciar en entrenamiento y en inferencia. Coste en agua en inferencia por uso de LLM, por uso de generacion de imagenes y de video. Circuitos cerrados

Mejoras de la eficiencia en usos de agua y energia debido a procesos controladosmejorados por InteligenciaIA

A pesar de su coste directo, la IA tiene una cualidad, es lo que los economistas llaman una "tecnología de utilidad general". Al igual que la electricidad en el siglo XIX, la IA puede optimizar otros sistemas de tal manera que el ahorro neto de recursos en la economía global supere su propio coste energético.

Las Tecnologías de utilidad general (GPT, por sus siglas en inglés de General purpose technologies) son tecnologías que pueden afectar una economía entera (normalmente a nivel nacional o global). Las GPT tienen el potencial de alterar drásticamente las sociedades a través de su impacto en las estructuras económicas y sociales preexistentes. Ejemplos de GPT son la máquina de vapor, el ferrocarril, la electricidad, la electrónica, los mecanizados, el automóvil, la informática e Internet.

Contaminación:Wikipedia.ElTecnologíaaumentode utilidad general

Eficiencia energética

Existe un consenso creciente sobre la capacidad de la eficienciaIA para acelerar la descarbonización de procesosotros agrícolassectores. La IA puede, por ejemplo, diseñar nuevos materiales para paneles solares más eficientes, predecir con exactitud fallos en turbinas eólicas o mejorar los sistemas de control de las redes eléctricas, permitiendo una mayor participación de las energías renovables en el pool.

Es fácil imaginar sistemas de control de iluminación o de calefacción gestionados con IA que dirijan la energía solo donde es necesaria con un potencial de ahorro enorme.

Contaminación: Eficiencia agrícola e industrialesindustrial como factor beneficioso

La ContaminaciónIA asociadaestá transformando los sectores más pesados de la economía en sistemas más delgados y precisos, reduciendo la contaminación química y biológica.

Agricultura de precisión y soberanía alimentaria. En el sector agrícola, la IA permite transitar de un modelo de "rociado masivo" a uno de "intervención precisa", reduciendo el uso de químicos tóxicos en porcentajes significativos y disminuyendo la electrificación,contaminación de los acuíferos por escorrentía. Puede verse un ejemplo en este video

-

Reducción de Insumos: La IA puede reducir el uso de fertilizantes y pesticidas al analizar la salud del suelo a

la generación eléctrica. Usonivel deenergíametronuclearcuadrado,comonoabastecimientode hectárea. -

Optimización Hídrica: Sensores inteligentes conectados a

los centrosmodelos de IA pueden mejorar el rendimiento de los cultivos mientras reducen el desperdicio de agua mediante un riego basado en datos meteorológicos y deprocesamiento.humedad real.

Distribución.En la manufactura, la IA facilita la transición hacia la economía circular. Las empresas pueden ahora simular procesos para minimizar el desperdicio de materiales antes de producir una sola pieza física. La adopción de IA generativa en la cadena de suministro ha demostrado reducciones de hasta el 15% en los costes logísticos y una disminución del 35% en los niveles de inventario innecesario, lo que significa menos productos fabricados que terminan en vertederos.

Disminución de los bienes no utilizados por mejoras en la cadena de distribución

Uno usode los beneficios ecológicos más potentes de la IA es la reducción del "sobrestock" y el desperdicio en la distribución global. La ineficiencia logística es responsable de una gran parte de las emisiones de transporte y de la acumulación de productos que nunca llegan a venderse.

El caso del desperdicio alimentario. Aproximadamente un tercio de todos los alimentos producidos a nivel mundial se pierde o se desperdicia. La IA está atacando este problema mediante analítica predictiva avanzada.

-

Previsión de la demanda: Los supermercados que utilizan IA han logrado reducir el desperdicio de alimentos frescos eal ajustar sus pedidos a la demanda real del vecindario, teniendo en cuenta incluso el clima o eventos locales.

-

Optimización de rutas: Los algoritmos de IA reducen los costes de transporte entre un 15% y un 20% al diseñar rutas de entrega más cortas, lo que se traduce directamente en menos emisiones por cada kilo de mercancía distribuido.

Reciclaje.

Reciclaje: Mejora en los procesos de recilcaje debido al uso de IA

El reciclaje es quizás el área donde la IA ofrece los beneficios ecológicos más visibles y directos. El sistema tradicional de reciclaje es "sucio y peligroso", lo que dificulta la retención de trabajadores y genera altas tasas de error.

Clasificación robótica inteligente

Los sistemas de visión artificial están revolucionando las plantas de tratamiento de residuos (MRF). Mientras un humano puede clasificar con suerte un objeto por segundo, los robots impulsados por IA pueden identificar y separar materiales con una precisión del 99% a una velocidad de 1,000 objetos por hora.

La IA permite separar plásticos de difícil reciclaje y extraer metales valiosos de los residuos electrónicos (e-waste). Empresas como Greyparrot han desarrollado sistemas que clasifican residuos en 111 categorías diferentes, identificando incluso la marca del envase para que las empresas puedan hacerse responsables de sus residuos mediante sistemas de Responsabilidad Ampliada del Productor (EPR). En el ámbito de la medicina, la IA está ayudando a hospitales a gestionar de forma segura los residuos biológicos, asegurando que los materiales reciclables no se mezclen con desechos peligrosos.