2.1 Introducción al prompting

Introducción

Como hemos visto en el capítulo anterior, los sistemas de IA generativa (IAGen) se basan en modelos entrenados con grandes cantidades de datos para identificar patrones lingüísticos y producir respuestas coherentes. Aunque su funcionamiento interno se apoya en complejos procesos matemáticos y computacionales, desde el punto de vista del usuario la interacción se realiza principalmente a través del lenguaje. Es decir, la persona formula una instrucción o pregunta y el sistema genera una respuesta a partir de ella. Este principio conecta directamente los fundamentos técnicos de la IA con la práctica cotidiana de su uso: la calidad de los resultados depende en gran medida de cómo se plantea esa instrucción inicial.

En este contexto surge la llamada ingeniería de prompting, que puede entenderse como el arte de comunicarse eficazmente con un sistema de IA mediante indicaciones claras, estructuradas y progresivas. En lugar de realizar una única petición cerrada, el proceso suele adoptar la forma de una conversación en la que el usuario orienta, corrige o amplía las instrucciones para afinar la respuesta.

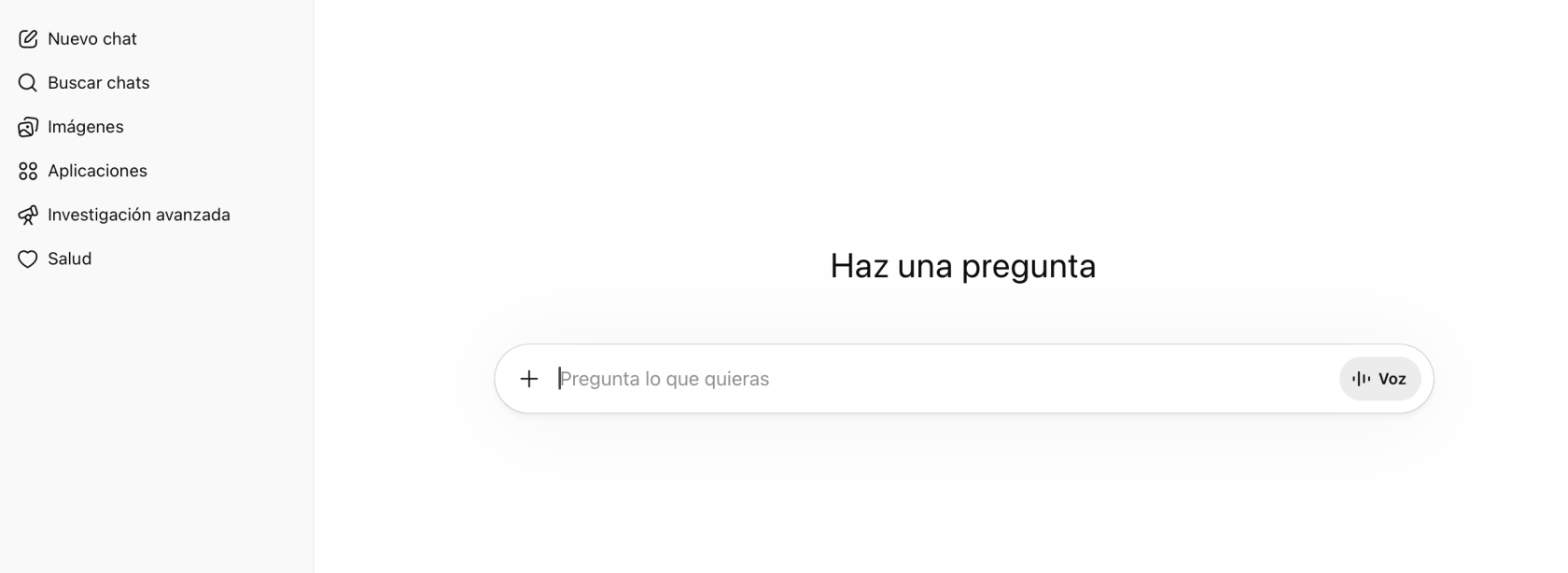

Por ejemplo, los asistentes y herramientas de IAGenerativa suelen estructurarse en torno a varios elementos básicos que facilitan la interacción con el usuario. En primer lugar, cuentan con una interfaz conversacional, normalmente en forma de chat, donde el usuario introduce instrucciones o preguntas (prompts). A partir de ahí interviene el modelo de lenguaje entrenado con grandes volúmenes de datos, que interpreta el significado de la instrucción y genera una respuesta coherente. Estos sistemas suelen incorporar además mecanismos de memoria contextual, que permiten tener en cuenta los mensajes anteriores de la conversación para mantener la continuidad del diálogo. Junto a ello aparecen funciones complementarias como herramientas integradas (búsqueda en la web, análisis de documentos, generación de código o imágenes) y opciones de edición o refinamiento de respuestas, que permiten al usuario ajustar el resultado mediante nuevas indicaciones. En conjunto, estos componentes convierten la interacción con la IA en un proceso iterativo basado en instrucciones y diálogo.

Interfaz de ChatGPT (2026)

De este modo, interactuar con la inteligencia artificial implica aprender a dialogar con ella a través de instrucciones, guiando paso a paso la generación de contenido para obtener resultados más precisos, útiles y adecuados al contexto.

Ingeniería de prompts

La ingeniería de prompts es una disciplina relativamente reciente que se centra en diseñar, formular y optimizar las instrucciones que damos a los modelos de lenguaje para obtener respuestas más útiles, precisas y ajustadas a nuestras necesidades. En lugar de limitarse a “hacer preguntas”, el prompting consiste en aprender a comunicarse eficazmente con la IA, entendiendo cómo interpreta el lenguaje y cómo responde a distintos tipos de instrucciones.

Esta disciplina resulta clave para comprender tanto las capacidades como las limitaciones de los grandes modelos de lenguaje (LLMs). Saber escribir buenos prompts permite aprovechar mejor su potencial, pero también entender cuándo pueden fallar, inventar información o responder de forma ambigua.

En el ámbito de la investigación, la ingeniería de prompts se utiliza para mejorar el rendimiento de los LLMs en tareas muy diversas, desde la respuesta a preguntas complejas hasta el razonamiento lógico o aritmético. En el ámbito del desarrollo, se emplea para diseñar interacciones robustas y repetibles, capaces de integrarse en aplicaciones reales junto con otras herramientas y sistemas.

Sin embargo, la ingeniería de prompts no se limita a escribir una instrucción inicial. Incluye un conjunto amplio de técnicas y habilidades que permiten guiar el comportamiento del modelo: asignarle roles, proporcionar contexto, introducir ejemplos, estructurar el formato de salida o limitar explícitamente lo que puede y no puede hacer. En este sentido, el prompting se convierte en una competencia clave para interactuar de forma consciente, crítica y eficaz con los modelos de lenguaje.

Además, un buen prompting contribuye a mejorar la seguridad y fiabilidad de los LLMs, ayudando a reducir respuestas inapropiadas, ambiguas o fuera de contexto. También permite ampliar sus capacidades mediante la incorporación de conocimiento específico de un dominio concreto o el uso combinado con herramientas externas.

El creciente interés por los modelos de lenguaje ha motivado la creación de guías, recursos y marcos de trabajo centrados en la ingeniería de prompts, que recopilan buenas prácticas, ejemplos, técnicas avanzadas y aplicaciones reales. En el contexto educativo, el prompting no solo es una habilidad técnica, sino también una competencia comunicativa y cognitiva, muy relacionada con saber formular buenas preguntas, dar instrucciones claras y reflexionar sobre el tipo de respuestas que buscamos.

Ventajas de un buen prompting

Un uso adecuado de la ingeniería de prompts aporta múltiples beneficios, tanto en contextos educativos como profesionales:

-

Respuestas de mayor calidad

Instrucciones claras y bien estructuradas reducen ambigüedades y aumentan la precisión de las respuestas. -

Mayor coherencia y control

Permite guiar el tono, el nivel de profundidad y el enfoque de la respuesta, evitando salidas genéricas o irrelevantes. -

Fomento de respuestas creativas (cuando interesa)

Un buen prompt puede estimular la creatividad del modelo, proponiendo enfoques originales, analogías o ejemplos novedosos. -

Uso de ejemplos como guía

Incluir ejemplos en el prompt ayuda al modelo a entender mejor el tipo de respuesta esperada (learning by example). -

Restricción y delimitación de respuestas

Es posible limitar el formato, la extensión, el vocabulario o incluso prohibir ciertos tipos de contenido. -

Adaptación al contexto educativo o profesional

Permite ajustar las respuestas a un nivel concreto (ESO, FP, universidad) o a un ámbito específico (técnico, humanístico, divulgativo). -

Mejor aprovechamiento del tiempo

Reduce la necesidad de correcciones posteriores y de múltiples intentos. -

Mayor fiabilidad y seguridad

Ayuda a minimizar errores, alucinaciones y respuestas fuera de contexto. -

Comprensión crítica de la IA

Enseña a interactuar con los modelos de forma consciente, entendiendo que la calidad de la salida depende en gran parte de la calidad de la instrucción.

Puedes consultar La gúia de prompt de IBM y la Guía Social de Promptin

No comments to display

No comments to display