3.4 Recursos audiovisuales

En los últimos años la Inteligencia Artificial generativa ha ampliado las posibilidades educativas más allá del texto. Hoy existen herramientas capaces de generar imágenes, vídeos, avatares parlantes y música a partir de instrucciones escritas, lo que permite crear recursos multimedia de forma rápida y flexible.

Este tipo de tecnologías forman parte de lo que se conoce como IA multimodal, es decir, sistemas capaces de trabajar con distintos tipos de información como texto, imagen, vídeo o sonido. En el contexto educativo, esto significa que un docente puede describir una idea, un concepto o una escena y la IA puede transformarla en un recurso visual o audiovisual que ayude a comprender mejor el contenido.

La generación de imágenes es una de las aplicaciones más extendidas. A partir de una descripción escrita, las herramientas de IA pueden crear ilustraciones, diagramas o escenas que representen un contenido educativo. Esto puede resultar útil para ilustrar explicaciones de historia, ciencias o geografía, así como para crear material visual adaptado a una actividad concreta.

A partir de esta tecnología han surgido también modelos capaces de generar vídeos a partir de texto. Estos sistemas permiten crear pequeñas escenas o secuencias audiovisuales que representan una situación descrita previamente. Aunque todavía se trata de una tecnología en evolución, abre nuevas posibilidades para generar recursos visuales que acompañen explicaciones o proyectos educativos.

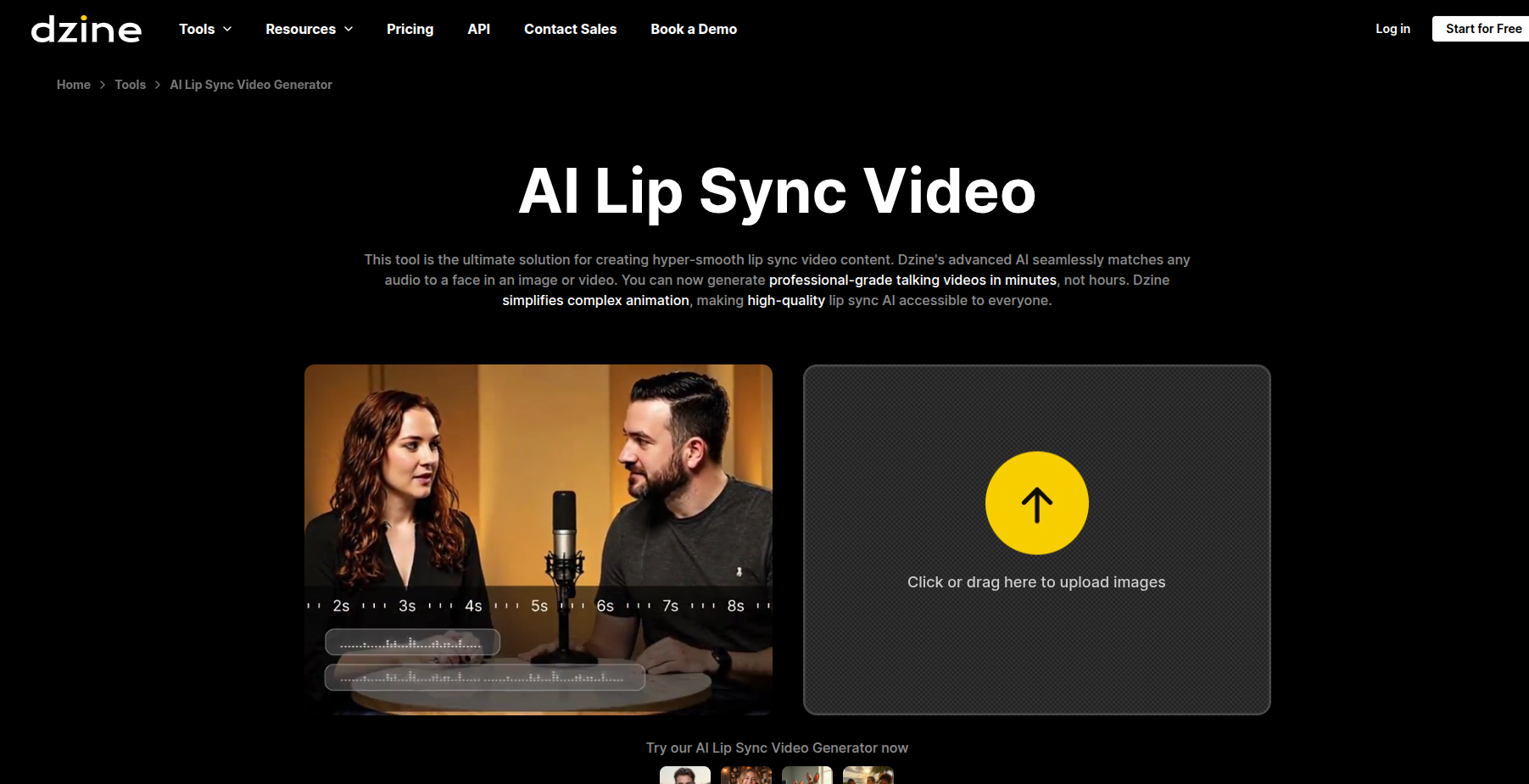

Otra aplicación interesante es la creación de avatares digitales que hablan. Estas herramientas permiten generar vídeos en los que aparece un personaje virtual que explica un contenido a partir de un guion escrito. En el ámbito educativo pueden utilizarse para presentar información, introducir un tema o acompañar materiales didácticos en formato audiovisual. Los modelos actuales permiten incluso adaptar el movimiento labial al idioma que se desee.

Esta herramienta permite adaptar el video al idioma elegido sincronizando el movimiento de los labios

Por último, la IA también permite generar audio, efectos sonoros o música, lo que facilita la creación de contenidos multimedia más completos. Por ejemplo, una presentación o un vídeo educativo puede incluir narraciones sintetizadas que acompañen la explicación.

En conjunto, estas tecnologías permiten combinar imagen y audio para crear materiales educativos más ricos y visuales. Esto puede facilitar la comprensión de determinados contenidos y ofrecer nuevas formas de presentar la información en el aula haciéndola más accesible.

Sin embargo, el uso educativo de estas herramientas no debe centrarse únicamente en producir contenidos automáticamente. También es una oportunidad para que el alumnado comprenda cómo funcionan estos sistemas, reflexione sobre sus límites y desarrolle una actitud crítica frente a los contenidos generados por IA. Aspectos como la fiabilidad de las imágenes, la manipulación audiovisual o los derechos de autor forman parte de los debates actuales sobre el uso responsable de estas tecnologías.

Te recomendamos la lectura de esta página sobre Derechos de Autor y Propiedad Intelectual del curso 1 de este itinerario.

Generación de video e imágenes con IA

La generación de imágenes mediante Inteligencia Artificial es una de las áreas que más ha evolucionado en los últimos años dentro del campo de la IA generativa. Estas tecnologías permiten crear imágenes nuevas a partir de descripciones escritas en lenguaje natural. Es decir, el usuario puede escribir una instrucción describiendo una escena, un objeto o un estilo visual, y el sistema genera automáticamente una imagen que representa esa descripción.

Este proceso se conoce como text-to-image y se basa en modelos de aprendizaje profundo entrenados con grandes conjuntos de imágenes. Gracias a este entrenamiento, los modelos aprenden patrones relacionados con formas, estilos, iluminación o composición visual. Como resultado, pueden producir ilustraciones, escenas históricas, diagramas o representaciones visuales complejas en pocos segundos.

En los últimos años han aparecido modelos cada vez más avanzados que amplían las posibilidades de esta tecnología, incluyendo no solo imágenes estáticas sino también animaciones y vídeos generados por IA.

Además podemos generar subtítulos de vídeos. Podemos utilizar la IA para transcribir audios y subtitutlar vídeos en otros idiomas o incluso vídeos creados por los alumnos sobre cualquier temática. Para ello herramientas con veed o descript pueden ser muy útiles.

Herramientas de generación visual con IA

Hoy en día la mayoría de asistentes generalistas como Gemini, ya son multimodo permitiendo la generación de imágenes y toda clase de contenidos. No obstante citamos a continuación los más específicos.

Ejemplo de imagen generada por Sora con el siguiente prompt

"A single floating cube, surface textured world map, muted saturated colors, image square shape, neutral lighter environment"

Posibilidades en el aula

- Creación de material visual para explicar contenidos

- Representación visual de conceptos abstractos

- Apoyo a proyectos y trabajos del alumnado

- Actividades creativas y experimentación con prompts. La generación de imágenes también puede utilizarse como actividad didáctica para trabajar la relación entre lenguaje e imagen. Los estudiantes pueden experimentar escribiendo diferentes descripciones (prompts) y observar cómo cambia el resultado visual. Este tipo de actividades permite reflexionar sobre cómo se construyen las instrucciones y cómo la IA interpreta el lenguaje.

¡Atención a la edad mínima de uso de las herramientas!

Coste de uso de herramientas de generación de video e imágenes con IA

El uso de herramientas de generación visual como Runway, Sora, Midjourney o Stable Diffusion implica un coste computacional considerable, ya que estos sistemas se basan en modelos de aprendizaje profundo con millones o miles de millones de parámetros. Para generar una sola imagen o un vídeo corto, el sistema debe realizar una gran cantidad de cálculos matemáticos en paralelo, normalmente ejecutados en tarjetas gráficas especializadas (GPU) o en grandes centros de datos.

Desde el punto de vista del hardware, estos modelos requieren equipos con gran capacidad de cálculo. En entornos profesionales o en la nube se utilizan GPU avanzadas como las NVIDIA A100 o equivalentes, cuyo uso puede costar más de 30 dólares por hora en servicios cloud de alto rendimiento, dependiendo de la configuración.

En el caso de modelos abiertos como Stable Diffusion, es posible ejecutarlos en un ordenador personal, pero aun así suele ser necesario disponer de una tarjeta gráfica con al menos 8 GB de memoria de vídeo, lo que implica un hardware relativamente potente comparado con aplicaciones informáticas convencionales.

Además del hardware, existe también un coste energético asociado al cálculo. Los sistemas de IA generativa realizan millones de operaciones matemáticas para cada imagen generada. Algunas estimaciones indican que crear una sola imagen puede consumir aproximadamente entre 0,01 y 0,29 kWh de electricidad, dependiendo del modelo y del hardware utilizado.

El coste es aún mayor cuando hablamos del entrenamiento de los modelos, que es el proceso mediante el cual aprenden a generar imágenes. Entrenar modelos de gran escala puede requerir miles de horas de GPU y enormes cantidades de energía. Por ejemplo, se estima que entrenar un gran modelo de lenguaje comparable a GPT-3 requirió más de 1.200 MWh de electricidad, equivalente al consumo anual de cientos de hogares.

Desde el punto de vista económico, estos requisitos de hardware, energía y mantenimiento de centros de datos explican por qué muchas herramientas de IA generativa funcionan mediante suscripciones o sistemas de créditos. El usuario no paga solo por el software, sino por el acceso a la infraestructura computacional necesaria para ejecutar estos modelos.

En resumen, aunque para el usuario final generar una imagen puede parecer un proceso instantáneo y sencillo, detrás de estas herramientas existe una infraestructura tecnológica compleja y costosa, basada en hardware especializado, consumo energético elevado y grandes centros de datos. Comprender este aspecto también es importante en el ámbito educativo, ya que ayuda a entender por qué estos servicios tienen coste económico y cuál es el impacto tecnológico y energético de la IA generativa.

Advertencia ética y legal

El uso de herramientas de generación de imágenes con IA debe acompañarse de una reflexión sobre sus implicaciones éticas y legales.

Es especialmente importante evitar generar o difundir imágenes que representen personas reales sin su consentimiento, ya que esto puede vulnerar derechos relacionados con la imagen, la privacidad o la reputación. La creación de imágenes falsas de personas reales puede dar lugar a situaciones problemáticas si no se utilizan con responsabilidad.

Asimismo, conviene enseñar al alumnado a respetar los derechos de autor y las condiciones de uso de las plataformas. Aunque una imagen haya sido generada por IA, su utilización puede estar sujeta a determinadas licencias o normas de uso.

Trabajar estas cuestiones en el aula permite fomentar una alfabetización digital crítica, ayudando al alumnado a comprender tanto las posibilidades como las responsabilidades asociadas al uso de estas tecnologías.

Modelos abiertos y plataformas

Para los que quieran profundizar existen webs que permiten usar estos modelos de forma gratuita pero con altos requisitos en cuanto a hardware. Nombramos las más populares:

-

Hugging Face → Repositorio de modelos abiertos (Stable Diffusion, SDXL, Flux, etc.).

-

Stable Diffusion → Modelo abierto ampliamente usado.

-

Leonardo AI → Generación avanzada con control de estilo.

-

Playground AI → Interfaz sencilla sobre modelos abiertos.

Generación de avatares con IA

Una de las aplicaciones más interesantes de la IA generativa en el ámbito educativo es la creación de avatares digitales que pueden hablar, explicar contenidos o presentar información. Estas herramientas permiten generar vídeos en los que aparece un personaje virtual que pronuncia un texto introducido previamente por el usuario. De esta forma, un simple guion puede convertirse en una explicación audiovisual en pocos minutos.

Los sistemas de avatares con IA combinan varias tecnologías: generación de vídeo, síntesis de voz y sincronización labial. A partir de estos elementos, el modelo es capaz de producir un personaje virtual que parece hablar de forma natural. Algunos sistemas incluso permiten elegir distintos idiomas, estilos de voz o tipos de avatar.

En el contexto educativo, estas herramientas pueden utilizarse para crear explicaciones breves, introducciones a temas o presentaciones audiovisuales, sin necesidad de grabar vídeos o disponer de equipamiento técnico específico. Esto facilita la producción de materiales visuales y permite explorar nuevas formas de comunicación digital en el aula.

Herramientas para generar avatares con IA

| Synthesia es una de las plataformas más conocidas para crear vídeos con avatares generados por IA. El usuario introduce un texto y el sistema genera automáticamente un vídeo en el que un avatar lo pronuncia con sincronización labial. La herramienta permite elegir diferentes personajes, idiomas y estilos de presentación, lo que la convierte en una opción frecuente para vídeos educativos o formativos. | |

|

Permite crear vídeos con avatares personalizables y ofrece funciones avanzadas como la traducción automática de vídeos a distintos idiomas manteniendo el movimiento de labios sincronizado. Esto puede resultar interesante en contextos educativos multilingües o en materiales destinados a diferentes públicos. |

|

|

D-ID permite animar una imagen para convertirla en un avatar que habla. El usuario puede subir una fotografía o ilustración y el sistema genera una animación facial que pronuncia el texto introducido. Esta herramienta se utiliza a menudo para crear narraciones visuales o presentaciones dinámicas. |

|

|

Colossyan es otra plataforma orientada a la creación de vídeos educativos mediante avatares. Permite transformar textos o guiones en presentaciones audiovisuales con personajes virtuales, lo que facilita la producción de contenidos formativos sin necesidad de grabación. |

Posibilidades en el aula

- Creación de explicaciones audiovisuales

- Simulación de personajes históricos. En materias como historia o literatura, los avatares pueden utilizarse para representar personajes que expliquen acontecimientos o narren hechos desde su perspectiva. Este tipo de actividades puede ayudar a trabajar contenidos de forma más dinámica y narrativa.

- Creación de contenidos educativos accesibles. Los avatares también pueden utilizarse para generar vídeos explicativos en distintos idiomas o con diferentes voces, lo que facilita la adaptación de materiales educativos a distintos contextos o necesidades.

Consideraciones éticas

Como ocurre con otras tecnologías de generación audiovisual, es importante utilizar los avatares con IA de forma responsable. Debe evitarse crear vídeos que representen personas reales sin su consentimiento, ya que esto puede vulnerar derechos de imagen o generar contenidos engañosos.

Trabajar estas cuestiones en el aula permite también reflexionar sobre fenómenos actuales como los deepfakes, ayudando al alumnado a desarrollar una actitud crítica frente a los contenidos digitales generados mediante IA.

Generación de música con IA

La generación de música mediante Inteligencia Artificial ha experimentado un avance muy significativo entre 2024 y 2026. Los modelos generativos actuales permiten crear contenido musical completo a partir de una descripción escrita o de algunos parámetros básicos, lo que ha ampliado notablemente las posibilidades de producción sonora en ámbitos creativos y educativos.

Hoy en día estas herramientas permiten generar música instrumental, canciones con letra o composiciones adaptadas a un estilo concreto o a una determinada emoción. Por ejemplo, un usuario puede pedir una pieza musical “con estilo épico para acompañar un vídeo sobre exploración espacial” o una canción “con estilo pop que explique un concepto científico”, y el sistema generará una composición coherente con esa descripción.

Desde el punto de vista educativo, estas tecnologías permiten explorar nuevas formas de crear contenido multimedia y también analizar cómo los modelos de IA interpretan instrucciones relacionadas con estilo, ritmo o emoción musical.

Herramientas

| Plataforma de composición musical asistida por IA que se utiliza especialmente para generar música instrumental de estilo cinematográfico o clásico. Se emplea con frecuencia para crear bandas sonoras o acompañamientos musicales. | |

| Se centra en la generación de música instrumental adaptada a distintos estados emocionales o tipos de contenido. El usuario puede seleccionar el tipo de ambiente que desea transmitir, como relajación, tensión o energía, y la herramienta genera una composición acorde. | |

| Herramienta orientada principalmente a la generación de música instrumental personalizable. Permite ajustar parámetros como duración, intensidad o estilo musical, lo que resulta útil para crear música de fondo para vídeos o presentaciones. | |

| Permite crear piezas que incluyen letra, voz e instrumentación a partir de una simple descripción escrita. El usuario puede definir el estilo musical o el tipo de canción que desea generar. Debido a su impacto en la industria musical, la plataforma ha estado también en el centro de debates y demandas relacionadas con derechos de autor y uso de datos para entrenamiento. |

Modelos abiertos de generación musical

Para quién quiera profundizar en el uso de estas herramientas, además de las plataformas comerciales, existen también modelos abiertos de generación musical que pueden encontrarse en repositorios como Hugging Face. Estos modelos permiten experimentar con la tecnología desde un punto de vista más técnico o educativo.

Normalmente se requiere cierto conocimiento técnico de lenguajes como python

|

Modelo desarrollado por Meta que permite generar música a partir de descripciones escritas. Puede producir fragmentos musicales en distintos estilos y es uno de los modelos abiertos más utilizados en investigación. |

|

| Modelo que genera música de forma continua utilizando una técnica inspirada en los modelos de difusión. Permite crear bucles musicales o pequeñas piezas sonoras que evolucionan progresivamente. |

Posibilidades en el aula

- Análisis musical. Explorar y analizar distintos estilos, observar cómo la IA interpreta descripciones relacionadas con ritmo, género o ambiente musical. Probar variaciones de una misma idea y analizar las diferencias.

- Trabajo colaborativo. Componer en grupo a partir de prompts y modificación de parámetros musicales a partir de esos prompts; debatir decisiones creativas (qué cambiar, por qué...); comparar resultados entre equipos.

- Composición musical asistida. Generar melodías, armonías o ritmos a partir de ideas simples. Trabajar la estructura y el estilo de la composición. Transformar una melodía, improvisar sobre bases generadas...

- Educación ética y crítica. Trabajo sobre los derechos de autor, el proceso creativo y el impacto en la profesión musical; análisis de modelos generativos a través de los modelos abiertos, analizando cómo funciona la generación musical mediante IA. Esto puede utilizarse en contextos educativos para comprender mejor los principios de los modelos generativos.

- Creación de bandas sonoras para proyectos. El alumnado puede generar música para acompañar vídeos, presentaciones o proyectos multimedia. Esto permite trabajar la relación entre sonido, emoción y narrativa.

Clonación de voz y síntesis avanzada

Uno de los avances más llamativos de la Inteligencia Artificial generativa en los últimos años es la capacidad de sintetizar voces humanas con gran realismo. Las tecnologías actuales permiten generar voz a partir de texto —lo que se conoce como text-to-speech (TTS)— y también clonar la voz de una persona concreta utilizando pequeñas muestras de audio.

Esto significa que un sistema puede aprender las características de una voz —entonación, ritmo, timbre o acento— y reproducirlas posteriormente para leer cualquier texto. En algunos casos bastan unos pocos segundos de grabación para crear un modelo capaz de imitar esa voz de forma bastante convincente.

En el ámbito educativo, estas tecnologías pueden utilizarse para generar narraciones, locuciones o explicaciones habladas que acompañen materiales didácticos. Por ejemplo, se pueden crear audioguías, narraciones de textos o voces para vídeos educativos. Sin embargo, al mismo tiempo plantean importantes cuestiones legales y éticas que es necesario abordar de forma crítica.

Herramientas de clonación y síntesis de voz

|

Permite generar narraciones realistas a partir de texto y también clonar voces mediante el entrenamiento con muestras de audio. La herramienta ofrece múltiples idiomas y estilos de voz, lo que la ha convertido en una de las referencias actuales en generación de voz con IA. |

|

|

PlayHT es otra plataforma orientada a la creación de voces sintéticas para contenidos audiovisuales. Permite generar narraciones con distintos estilos de voz y también crear clones de voz personalizados a partir de grabaciones. |

|

|

Resemble AI está orientada a la generación de voces sintéticas para aplicaciones multimedia, videojuegos o producción audiovisual. Permite generar voces con distintos estilos y emociones. |

|

| Existen modelos abiertos como OpenVoice que permiten experimentar con clonación de voz y síntesis de audio. Algunos de estos sistemas pueden encontrarse en repositorios de investigación y plataformas como Hugging Face, lo que permite explorar el funcionamiento técnico de estas tecnologías. |

Posibilidades en el aula

- Creación de narraciones para materiales educativos

- Producción de audioguías o podcasts educativos

- Adaptación lingüística de materiales. Las tecnologías de voz sintética permiten generar narraciones en distintos idiomas o acentos, lo que puede resultar útil en contextos educativos multilingües.

- Exploración tecnológica. En asignaturas relacionadas con tecnología o informática, estas herramientas permiten analizar cómo funcionan los sistemas de generación de voz y cómo los modelos aprenden características acústicas del habla humana.

Problemas legales y éticos

La clonación de voz plantea importantes cuestiones legales y éticas que deben tenerse en cuenta, especialmente en contextos educativos.

Uno de los principales problemas es el uso de la voz de una persona sin su consentimiento. La voz forma parte de la identidad personal, por lo que imitarla o reproducirla sin autorización puede vulnerar derechos de imagen o derechos de personalidad.

Además, estas tecnologías pueden utilizarse para crear contenidos falsos o manipulados, conocidos como deepfakes de voz. Por ejemplo, es posible generar grabaciones en las que parece que una persona ha dicho algo que en realidad nunca ha dicho. Esto puede utilizarse para desinformación, fraude o manipulación.

También existen cuestiones relacionadas con los derechos de autor y el uso de datos para entrenar los modelos. Algunos sistemas de clonación de voz han sido entrenados con grandes cantidades de grabaciones de audio, lo que ha generado debates sobre si esas voces se han utilizado con el consentimiento de sus propietarios.

Uso responsable en el ámbito educativo

Por estos motivos, cuando estas tecnologías se utilizan en el aula es importante acompañarlas de una reflexión crítica sobre su uso.

El alumnado debe comprender que:

no se deben clonar voces de personas reales sin su permiso

los contenidos generados por IA pueden ser manipulados o falsos

es necesario respetar los derechos de identidad y propiedad intelectual

Experimentación técnica y uso local

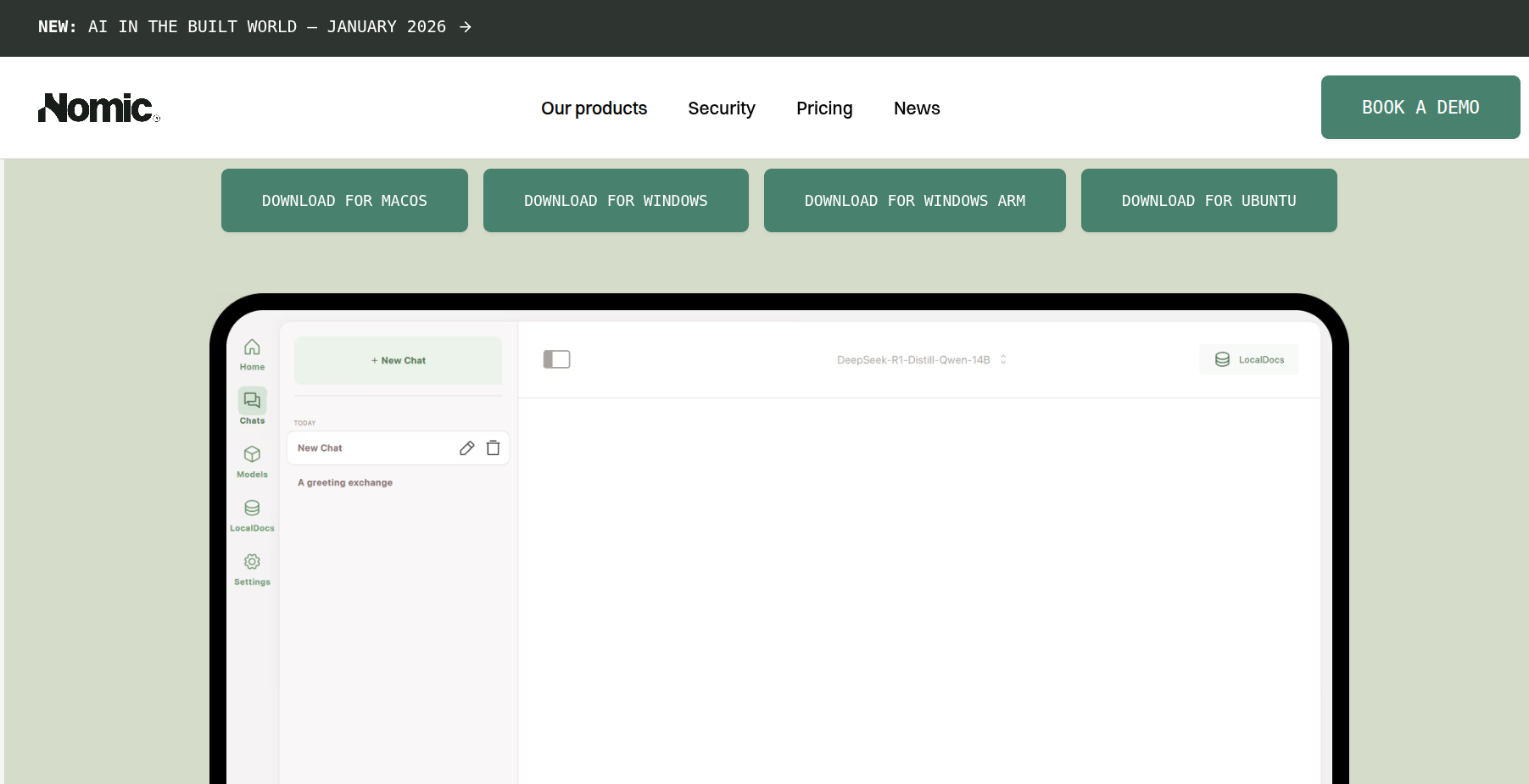

La existencia de modelos abiertos en plataformas como Hugging Face permite también trabajar con IA local, es decir, ejecutar modelos en un ordenador propio sin depender necesariamente de servicios comerciales en la nube.

Para ello existen numerosas herramientas como chatGPT4all o LMStudio muy intutitivas y con pocos requisitos técnicos

Pantalla principal de la web de chatgpt4all

Este tipo de experimentación puede ser especialmente interesante en contextos educativos relacionados con informática, inteligencia artificial o tecnología, ya que permite trabajar aspectos como:

-

el funcionamiento de los modelos generativos

-

la experimentación con parámetros de generación

-

la comprensión técnica de los sistemas de IA

De esta forma, la generación musical con IA no solo se convierte en una herramienta creativa, sino también en una oportunidad para comprender mejor cómo funcionan los modelos de inteligencia artificial que producen contenido digital.

Conclusiones finales: riesgos y uso responsable de la IA multimedia

El desarrollo reciente de la Inteligencia Artificial generativa ha ampliado enormemente las posibilidades de creación de contenidos digitales. Hoy es posible generar imágenes, vídeos, música, avatares o voces sintéticas a partir de simples instrucciones escritas. Estas herramientas facilitan la producción de recursos multimedia y abren nuevas oportunidades para la enseñanza, la creatividad y la experimentación tecnológica en el aula.

Sin embargo, cuando la IA trabaja con imagen, vídeo o voz, los riesgos asociados son potencialmente mayores que en el caso del texto. Estos formatos tienen un fuerte impacto emocional y una gran capacidad de persuasión, lo que hace que los contenidos generados puedan resultar especialmente convincentes incluso cuando no son reales.

Uno de los principales problemas es la aparición de los llamados deepfakes, es decir, contenidos audiovisuales generados o manipulados mediante IA que imitan la apariencia o la voz de personas reales. Estas tecnologías pueden utilizarse para crear vídeos o audios falsos que simulan declaraciones o situaciones que nunca han ocurrido.

Relacionado con esto aparece también el riesgo de suplantación de identidad, ya que los sistemas de clonación de voz o generación de avatares permiten recrear de forma bastante realista la apariencia o la voz de una persona. Si estas herramientas se utilizan sin consentimiento, pueden vulnerar derechos de imagen o generar situaciones de fraude o manipulación.

Otro aspecto importante es el relacionado con los derechos de autor. Muchas herramientas de generación de imágenes, música o vídeo han sido entrenadas con grandes conjuntos de datos que incluyen obras creativas existentes con copyright y sin autorización del autor. Esto ha abierto un debate legal sobre el uso de esos contenidos para entrenar modelos de inteligencia artificial y sobre la propiedad de los contenidos generados posteriormente.

Además, la facilidad con la que hoy se pueden generar imágenes o vídeos realistas plantea nuevos retos en relación con la manipulación informativa y la desinformación audiovisual. En un contexto donde las redes sociales difunden rápidamente contenidos visuales, la existencia de vídeos o audios falsos puede contribuir a la difusión de información engañosa o manipulada.

Por todo ello, el uso educativo de estas tecnologías debe ir acompañado de una reflexión crítica sobre sus implicaciones. La escuela tiene un papel importante en el desarrollo de una alfabetización digital avanzada, que permita al alumnado comprender cómo se generan estos contenidos y cuáles son sus posibles riesgos.

Una actividad interesante para trabajar estos aspectos en el aula consiste en analizar un vídeo generado mediante inteligencia artificial y debatir algunas preguntas clave. Por ejemplo, se puede plantear al alumnado si realmente es posible distinguir ese vídeo de uno grabado de forma real. También se pueden discutir las posibles implicaciones que tendría el uso de este tipo de tecnologías en ámbitos como la política, la comunicación o la información pública. Finalmente, puede ser útil reflexionar sobre qué tipo de normas o regulaciones podrían establecerse para limitar usos problemáticos de estas herramientas.

En definitiva, la IA generativa ofrece nuevas oportunidades para la creación de contenidos y para el aprendizaje, pero también plantea desafíos importantes. Integrar estas tecnologías en el ámbito educativo no solo implica aprender a utilizarlas, sino también comprender sus límites, analizar sus riesgos y desarrollar un pensamiento crítico sobre su impacto en la sociedad digital actual.

No comments to display

No comments to display