1.4 ¿La inteligencia artificial es inteligente?

«Los límites de mi lenguaje son los límites de mi mundo».

Ludwig Wittgenstein

Los ordenadores, y otros tipos de dispositivos electrónicos, llevan décadas realizando tareas que los humanos no somos capaces de realizar. La calculadora de bolsillo más básica es capaz de ejecutar una operación matemática que a cualquier humano le llevaría una cantidad considerable de tiempo (en el caso de que sea capaz de realizarla). Sin embargo, a nadie se le ocurre decir que una calculadora sea "inteligente", ni mucho menos que es más inteligente que un ser humano. Esta capacidad de utilizar algoritmos para realizar tareas mecánicas de forma precisa y fiable se extiende a otros muchos campos, desde la ingeniería hasta la elección de la próxima serie que veremos en nuestra plataforma de streaming. A nadie se le había ocurrido pensar hasta ahora, sin embargo, que una secuencia ordenada de pasos e instrucciones para realizar un cálculo pudiera «cobrar conciencia de repente», una posibilidad que sí concedemos a los últimos modelos de IA.

Antes de profundizar en este problema debemos preguntarnos qué es la inteligencia. El diccionario de la Real Academia Española de la Lengua define “inteligencia”, en su primera acepción, como la «Capacidad de entender y comprender». La segunda acepción ofrece una definición un poco distinta e identifica la inteligencia con la «Capacidad de resolver problemas», una definición que de algún modo se ciñe más a la etimología del término, relacionada con la idea de «elegir entre varias opciones». Podríamos pensar que una calculadora tiene la «capacidad de resolver problemas», siempre y cuando consideremos que una operación matemática es un problema en sí mismo (y lo es, sin duda, para muchas personas). El algoritmo de la plataforma audiovisual, por otra parte, ofrece la posibilidad de «elegir entre varias opciones», una capacidad, por otra parte, que podríamos llegar a atribuir a cualquier mecanismo de generación aleatoria de números, por ejemplo un dado. Pero tampoco diríamos que estas capacidades hacen que la calculadora o la plataforma sean «inteligentes», y es evidente que su mecanismo de funcionamiento es completamente distinto (para empezar, la calculadora no comete los errores de apreciación que tanto nos intrigan en la oferta «personalizada» de canciones o de películas).

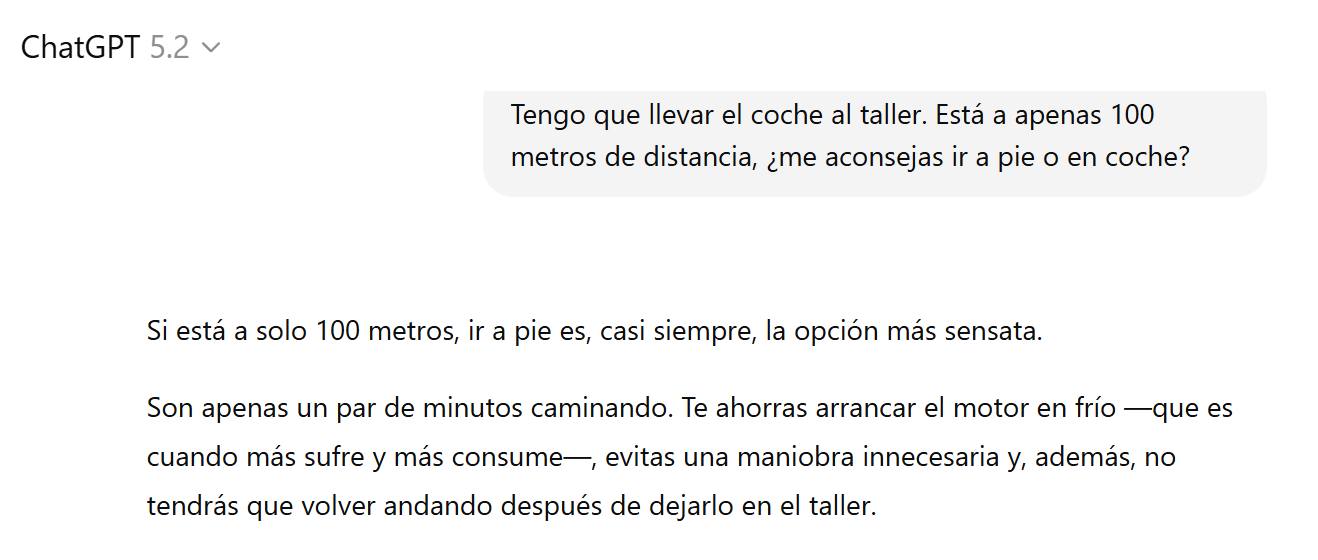

¿Qué sucede con los LMM? ¿Hasta qué punto podemos considerar que son «inteligentes»? Veamos un ejemplo en el que se hace una pregunta sencilla, de «sentido común», a una de las últimas versiones del chatbot más popular:

Como vemos, el LLM falla de forma estrepitosa (y cómica) en su respuesta. El modelo no es capaz de comprender que para llevar el coche al taller es necesario... llevar el coche al taller. El error no está en el algoritmo (aunque no hay duda de que en un futuro inmediato los modelos serán capaces de resolver este problema y otros similares con respuestas más satisfactorias), sino en nuestra percepción de lo que es capaz de hacer un chatbot. El asistente no es capaz de responder a la pregunta precisamente porque es una pregunta con una respuesta tan obvia que nadie la ha planteado nunca, y por lo tanto la opción correcta no aparece en los textos de entrenamiento.

La clave está en el lenguaje y nos remite de nuevo a la primera definición del diccionario de la Real Academia, esa que nos habla de la «capacidad de entender y comprender». Identificamos las ideas con su verbalización (como en la cita de Wittgenstein que abre este capítulo), y la capacidad de razonar con la simulación de razonamiento expresada por medio del lenguaje.

La lingüista Emily Bender, que dirige el Laboratorio de Lingüística Computacional de la universidad de Washington, acuñó el término "loros estocásticos" para referirse a los Grandes Modelos de Lenguaje, una expresión que ha tenido cierto éxito y que se sigue utilizando: al igual que los loros, los LLM utilizan palabras que no comprenden y, en el mejor de los casos, las utilizan para responder a estímulos de forma condicionada, sin entender la relación entre su producción lingüística y el evento que la provoca. La propuesta de Bender, y de los otros firmantes de este artículo, consiste en limitar la cantidad de datos que se utilizan para entrar a los modelos de lenguaje y cuidar más la calidad de la información en que se basan, con una fuerte supervisión humana.

Otra de los argumentos que se utilizan para demostrar que la IA no es capaz de "pensar" tiene que ver con sus limitaciones a la hora de detectar, comprender y generar humor. En una entrevista con el diario The Guardian, el profesor José Camacho Collados, responsable de un estudio sobre el modo en que la IA procesa los chistes, afirmó que “En general, los LLM tienden a memorizar lo que han aprendido durante su entrenamiento. Por ello, detectan bien los juegos de palabras ya existentes, pero eso no significa que realmente los comprendan”. Y continuó: “Hemos sido capaces de engañar a los LLM de forma sistemática modificando chistes existentes, eliminando el doble sentido que hacía que el juego de palabras original funcionara. En estos casos, los modelos asocian las frases con juegos de palabras previos e inventan razonamientos de todo tipo para justificar que se trata de un juego de palabras. En última instancia, hemos descubierto que su comprensión de los juegos de palabras es una ilusión.”

Uno de los intentos de desarrollar la IA generativa para que tenga una capacidad real de razonar, tal y como la entendemos los humanos, ha sido la creación de Grandes Modelos de Razonamiento o LRM (por sus siglas en inglés), sistemas programados para superar las limitaciones de los modelos puramente lingüísticos por medio de procedimientos computacionales distintos, capaces de revisar los pasos previos (un proceso que implica respuestas más lentas). Sin embargo, los resultados de estos modelos siguen siendo decepcionantes y un estudio publicado en noviembre de 2025 los comparó con los LMM tradicionales y descubrió que, de hecho, los LLM respondían mejor a tareas sencillas (se equivocaban menos) y que, aunque los LRM superaban a los LLM en tareas de complejidad media, ambos tipos de IA colapsaban (es decir, tenían una tasa nula de éxito) ante tareas complejas que exigían razonamientos con un número elevado de pasos.

Como docentes, nuestra obligación es crear oportunidades para que nuestro alumnado comprenda que la IA, al menos en su estado actual de desarrollo, no es capaz de llevar a cabo el proceso de razonamiento que asociamos con la inteligencia. En este curso veremos algunas actividades que permitirán abordar los LLM desde una perspectiva crítica.

No comments to display

No comments to display