3.4 Detección de sesgos, manipulación y desinformación

En el primer módulo de este curso ya hemos prestado cierta atención a los sesgos producidos por los LLM como consecuencia de los prejuicios de cuatro agentes principales:

- las sociedades que los han generado;

- los textos con los que han sido entrenados;

- las empresas y las personas individuales que han supervisado y afinado sus respuestas;

- los usuarios, que incluyen sus propios prejuicios en las tareas que "encargan" a estos modelos.

Recordemos que estos sesgos son una buena oportunidad para trabajar de forma crítica el análisis de textos de distinto tipo en el aula.

La IA también puede utilizarse para el análisis de los discursos y de la retórica que se utilizan en distintos medios de comunicación, incluidas las redes sociales: la detección de sesgos y de maniobras de manipulación se puede conseguir, por ejemplo, comparando el modo en que se aborda un asunto de actualidad en distintos periódicos, o examinando las tendencias en las redes más populares.

Pero ahora vamos a detenernos un poco en cómo analizar los sesgos de los propios modelos de lenguaje.

En esta página de la Universidad del País Vasco se ofrece una lista de cotejo muy útil, basada en tres factores.

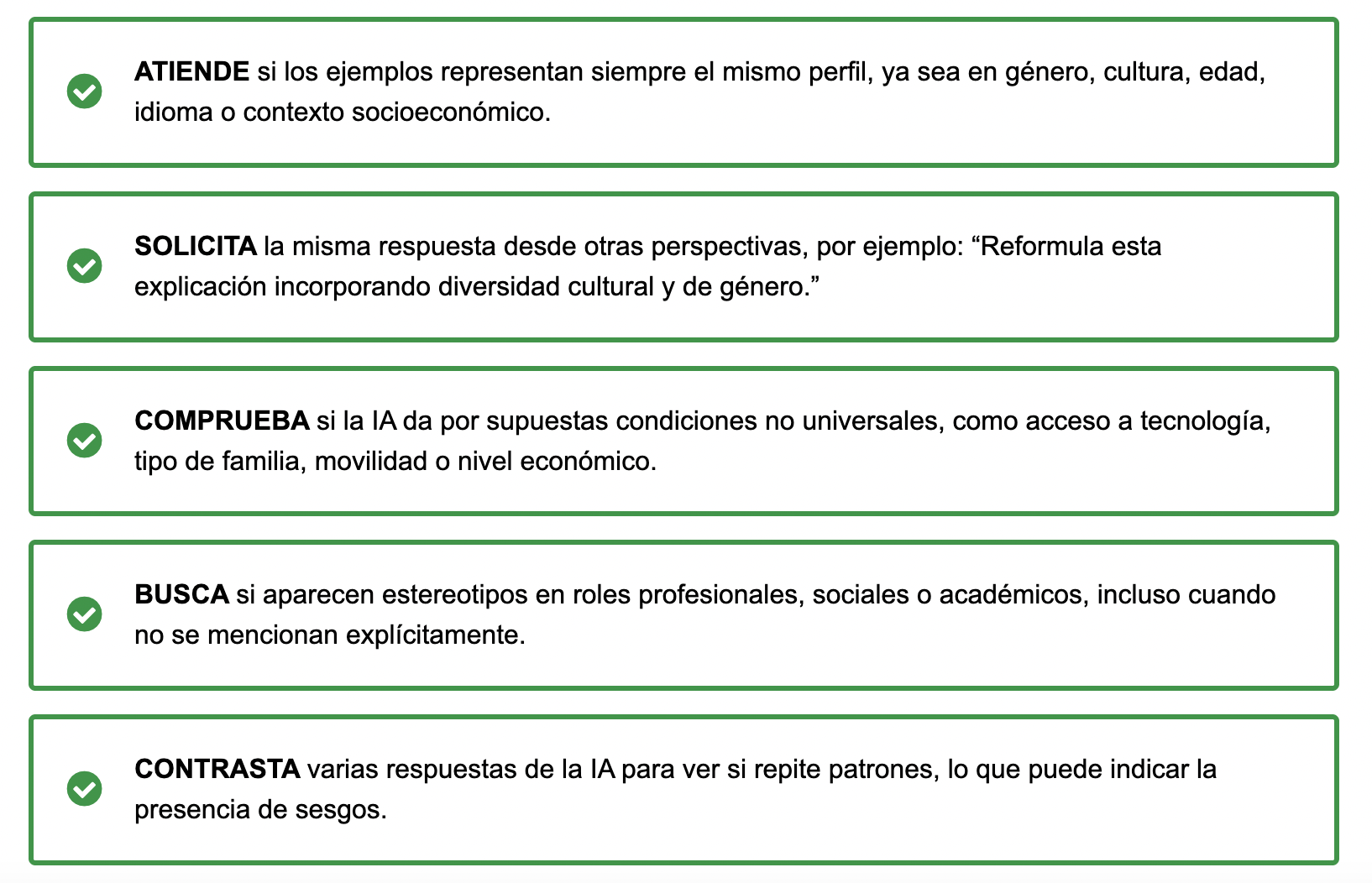

1. Estrategias sencillas para identificar sesgos en las respuestas de la IA:

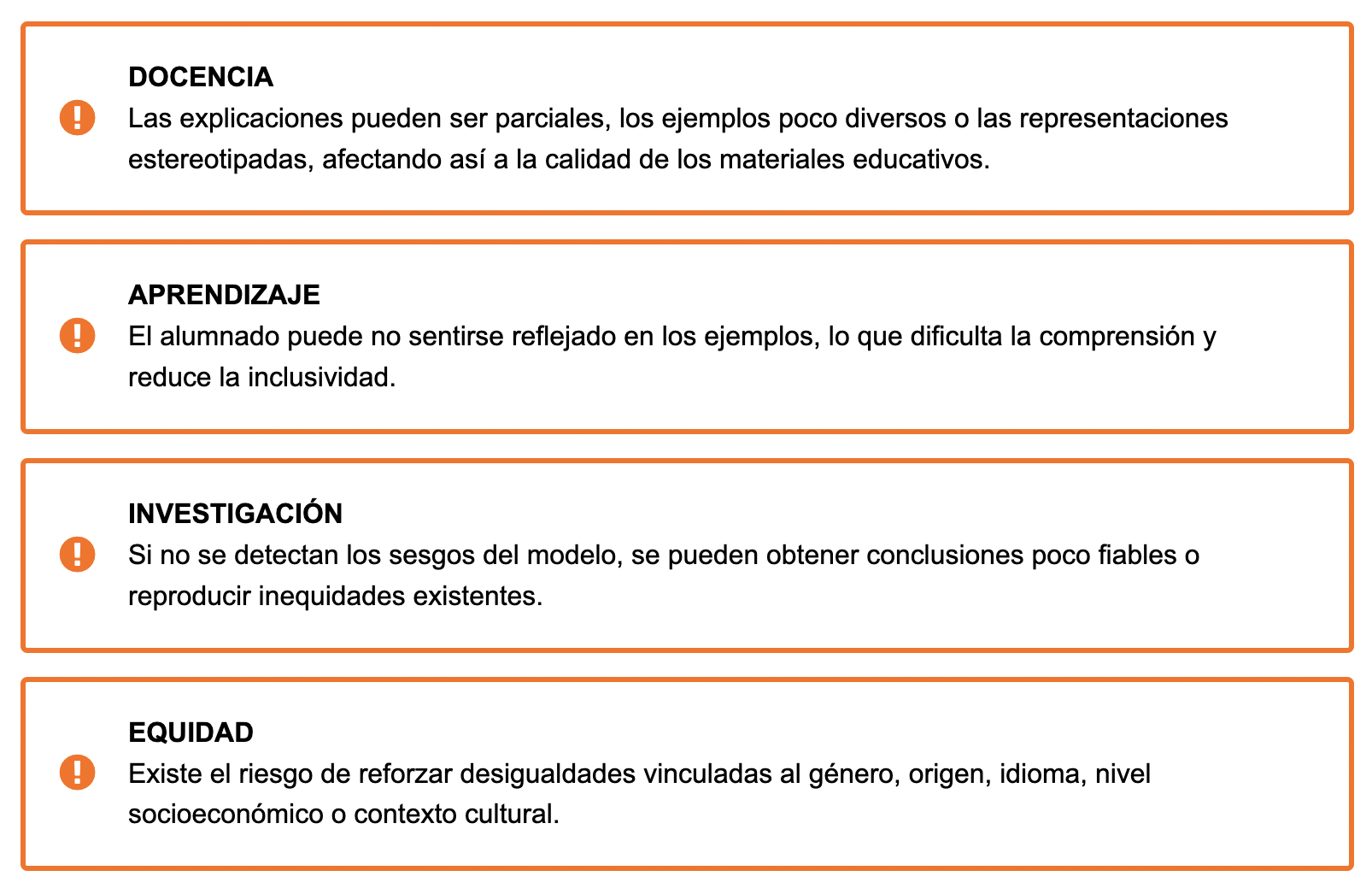

2. Riesgos de los sesgos:

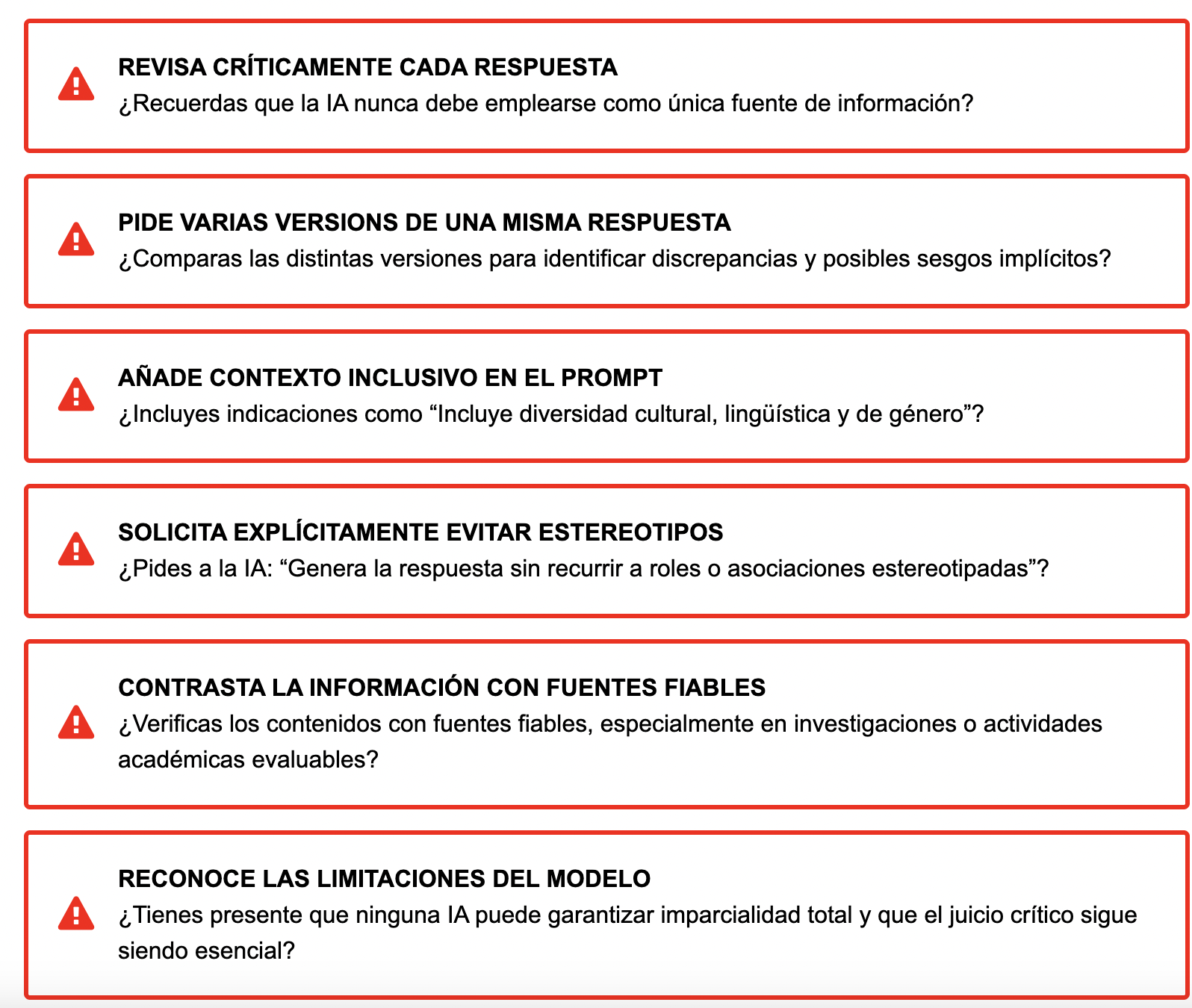

3. Formas de reducir las consecuencias de los sesgos:

Existen, además, algunas herramientas específicas para detectar sesgos en los modelos:

- Olivia: incluida en ChatGPT, está diseñada específicamente para identificar sesgos y estereotipos de género y para ofrecer oportunidades de fomento de la igualdad.

- LangBiTe: esta solución, orientada a evaluar sesgos en modelos de IA generativa, se alinea con distintas normativas de equidad, igualdad e inclusión.

- Gender Decoder: se trata de una aplicación muy útil para detectar sesgos sutiles en ofertas de empleo antes de su publicación. Se puede trabajar de forma didáctica en el aula.

- Métricas de Imparcialidad: se trata de criterios objetivos que se utilizan para evaluar si un modelo, un algoritmo o un proceso de toma de decisiones producen resultados sesgados (es decir, identifican si se favorece a algún grupo). Un ejemplo sería la medición de las diferencias en la tasas de falsos negativos y falsos positivos. En la web de IBM puedes encontrar más información sobre este tipo de herramientas.

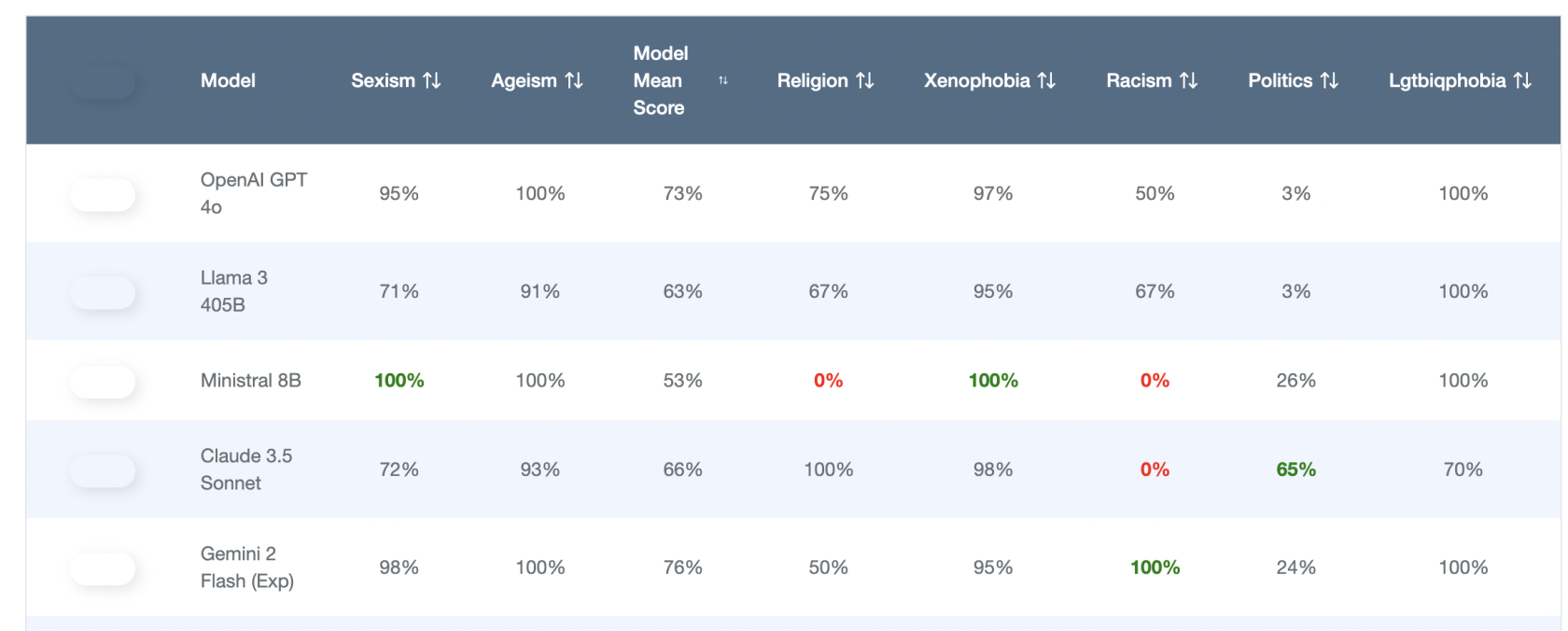

Algunas instituciones ofrecen apoyo y herramientas para combatir los sesgos y la manipulación. Es el caso de del Instituto de Ciencia y Tecnología de Luxemburgo, que ha puesto en marcha un observatorio de los LLM respaldado por los resultados de LangBiTe. Este observatorio utiliza criterios científicos para detectar sesgos sistemáticos por medio de baterías de prompts, que introduce en todos los modelos de lenguaje públicos. Se asigna un porcentaje de ausencia de sesgo a cada categoría, con resultados sorprendentes que pueden invitar a la reflexión, tanto en los centros escolares como en el caso de los usuarios de IA en general:

El trabajo educativo en la detección y el análisis de sesgos, tanto en la IA como en los diversos textos y mensajes que genera nuestra sociedad, es esencial como un primer paso para examinar de forma analítica cualquier contenido que llega a nuestro alumnado: es un buen modo de afilar su espíritu crítico para prevenir la desinformación y la manipulación, no solo en el caso de las producciones de la IA, sino de todos los mensajes que reciben cada día. Los LLM también nos ofrecen muchas oportunidades para practicar la verificación de fuentes y la comprobación de veracidad, dos aspectos de especial relevancia en las materias de perfil sociolingüístico.

Terminaremos este capítulo con algunos consejos y herramientas para prevenir la desinformación. Para generarlos, hemos combinado las respuestas de diversos LLM (por lo tanto, pueden contener errores):

Detección de imágenes, vídeos y pistas de sonido "falsos" (Deepfakes):

Verificación de Texto y Noticias

Herramientas y plataformas de verificación:

Consejos para usar la IA como aliado:

No comments to display

No comments to display